L’azienda OpenAI ha annunciato di aver raggiunto un fatturato annuo ricorrente di 10 miliardi di dollari, un traguardo significativo che sottolinea la crescente domanda di intelligenza artificiale nel mercato globale. Questo risultato è stato ottenuto in meno di tre anni dal lancio del suo popolare chatbot, ChatGPT, evidenziando la rapidità con cui l’IA sta diventando parte integrante sia del settore consumer che di quello aziendale.

Analisi delle Fonti di Reddito

Il fatturato di 10 miliardi di dollari include le vendite derivanti dai prodotti consumer, dai prodotti aziendali ChatGPT e dalle API (Application Programming Interface). È importante notare che questa cifra non comprende i ricavi derivanti dalle licenze concesse a Microsoft e da accordi una tantum di grande entità. Questo dettaglio fornisce una visione più chiara delle fonti di reddito organiche di OpenAI, basate principalmente sull’adozione e sull’utilizzo diretto dei suoi prodotti e servizi.

OpenAI serve attualmente oltre 500 milioni di utenti attivi settimanali e vanta 3 milioni di clienti aziendali paganti. Questo dato rappresenta un aumento del 50% rispetto ai 2 milioni di utenti paganti segnalati a febbraio 2025, dimostrando una crescita esponenziale della base clienti in un periodo di tempo relativamente breve.

Obiettivi Futuri e Sfide Finanziarie

Nonostante il successo attuale, OpenAI punta a raggiungere un fatturato di 125 miliardi di dollari entro il 2029. Questo obiettivo ambizioso riflette la fiducia dell’azienda nel potenziale di crescita del mercato dell’IA e nella sua capacità di capitalizzare su nuove opportunità. Tuttavia, per raggiungere tali traguardi, OpenAI deve affrontare sfide finanziarie significative.

L’azienda sta investendo pesantemente nell’assunzione di talenti e nella costruzione dell’infrastruttura necessaria per addestrare ed eseguire i suoi sistemi di IA. Queste spese operative ammontano a miliardi di dollari all’anno. Nel 2024, OpenAI ha registrato una perdita di circa 5 miliardi di dollari. Ad oggi, OpenAI non ha divulgato i suoi costi operativi né ha indicato se è vicina alla redditività.

Valutazione e Investimenti

Il raggiungimento di un fatturato annuo ricorrente di 10 miliardi di dollari ha un impatto significativo sulla valutazione di OpenAI. A marzo 2025, l’azienda ha chiuso un round di finanziamento da 40 miliardi di dollari, segnando il più grande accordo tecnologico privato mai registrato. Con le metriche attuali, OpenAI è valutata circa 30 volte il suo fatturato, il che evidenzia le elevate aspettative di crescita da parte dei suoi principali investitori.

OpenAI è sostenuta da importanti investitori come SoftBank, Microsoft, Coatue, Altimeter e Thrive. Questi investimenti forniscono all’azienda le risorse finanziarie necessarie per continuare a innovare e a espandersi nel mercato dell’IA.

Prospettive Future: Oltre ChatGPT

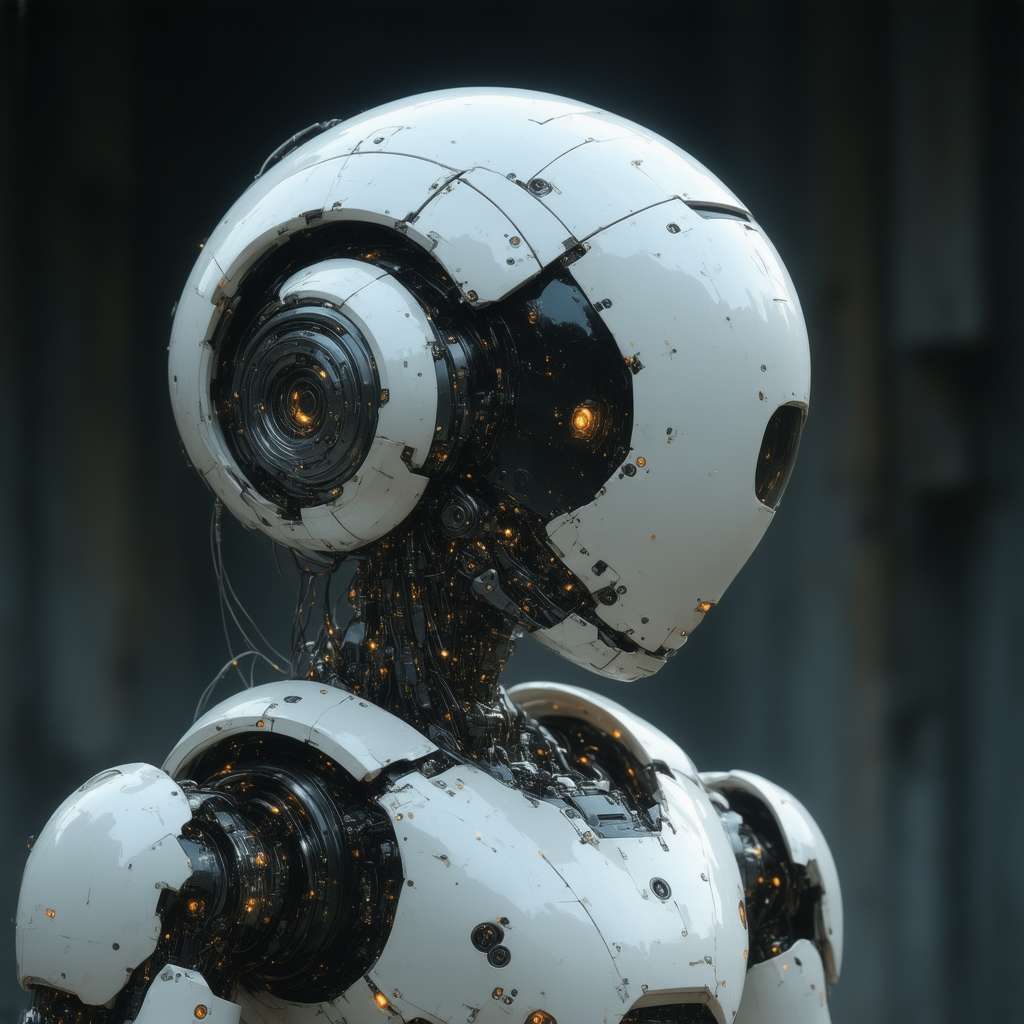

Oltre a ChatGPT, OpenAI sta esplorando nuove opportunità di crescita, tra cui lo sviluppo di dispositivi basati sull’IA. L’azienda ha collaborato con Jony Ive, ex chief design officer di Apple, per sviluppare 100 milioni di dispositivi AI, con un lancio previsto per la fine del 2026. Questa iniziativa rappresenta un’ulteriore diversificazione delle fonti di reddito di OpenAI e un’espansione nel mercato hardware.

Il Futuro Economico di OpenAI: Tra Crescita e Sostenibilità

Il percorso di OpenAI verso la redditività è ancora in divenire. Nonostante la rapida crescita del fatturato, l’azienda prevede di diventare cash-positive solo entro il 2029, con un fatturato previsto di 125 miliardi di dollari. I costi elevati associati ai data center e alle GPU (Graphics Processing Units) rappresentano una sfida significativa per la redditività di OpenAI.

La capacità di OpenAI di bilanciare la crescita rapida con la sostenibilità finanziaria sarà fondamentale per il suo successo a lungo termine. L’azienda dovrà continuare a innovare e a espandersi in nuovi mercati, gestendo al contempo i costi operativi e garantendo un flusso di cassa positivo.

Amici, riflettiamo un attimo su cosa significa tutto questo. OpenAI, con la sua crescita esponenziale, ci mostra quanto l’intelligenza artificiale stia diventando pervasiva. Ma cosa c’è dietro a tutto questo successo? Un concetto fondamentale è il machine learning, ovvero la capacità di un sistema di apprendere dai dati senza essere esplicitamente programmato. ChatGPT, ad esempio, è stato addestrato su enormi quantità di testo per poter generare risposte coerenti e pertinenti.

E se volessimo spingerci oltre? Potremmo parlare di transfer learning, una tecnica avanzata che permette di utilizzare un modello addestrato per un compito specifico e adattarlo a un compito diverso ma correlato. Immaginate di addestrare un modello per riconoscere immagini di gatti e poi utilizzarlo, con qualche modifica, per riconoscere immagini di cani. Questo non solo accelera il processo di apprendimento, ma permette anche di ottenere risultati migliori con meno dati.

La domanda che sorge spontanea è: come possiamo sfruttare al meglio queste tecnologie per migliorare la nostra vita e il nostro lavoro? E quali sono i rischi da considerare? La risposta, come spesso accade, non è semplice, ma è fondamentale continuare a esplorare e a sperimentare per comprendere appieno il potenziale dell’intelligenza artificiale.