L’intelligenza artificiale sta trasformando il mondo, aprendo scenari inediti in diversi settori, dalla sanità alla finanza. La sua diffusione capillare solleva questioni etiche urgenti: come assicurare che gli algoritmi siano equi, trasparenti e responsabili? Una risposta possibile è l’integrazione dell’Ia con la tecnologia blockchain, creando sistemi decentralizzati che promuovano fiducia e trasparenza.

La blockchain, con la sua natura immutabile e decentralizzata, offre un potenziale unico per affrontare le sfide etiche dell’Ia. In particolare, può migliorare la trasparenza degli algoritmi, consentendo agli utenti di comprendere come vengono prese le decisioni e come vengono utilizzati i loro dati. Inoltre, la blockchain può accrescere l’accountability, facilitando l’identificazione e la correzione di errori o pregiudizi.

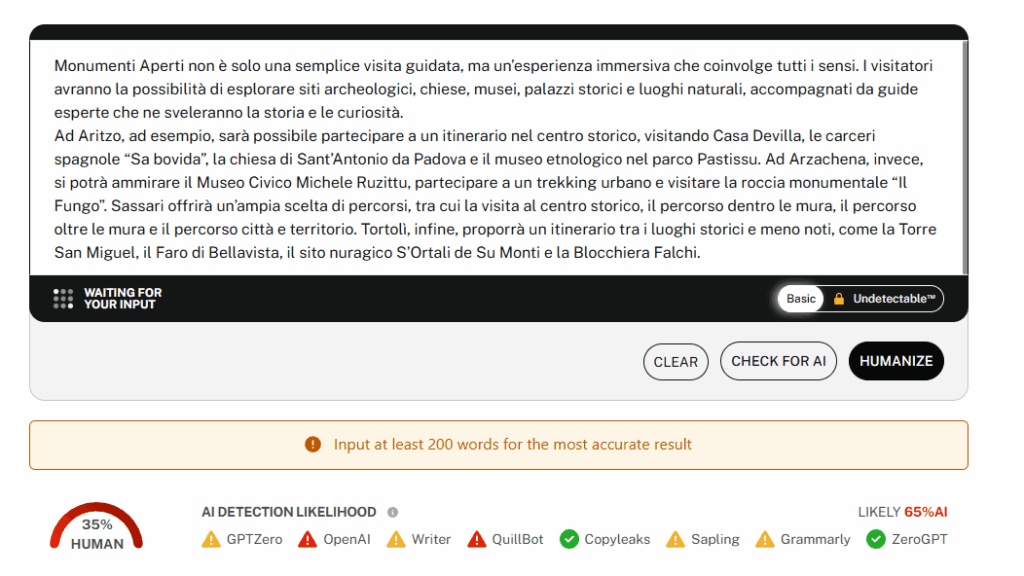

Come la blockchain può incrementare l’etica dell’ia

La blockchain ha la capacità di trasformare il panorama etico dell’intelligenza artificiale agendo su molteplici livelli. Innanzitutto, la sua natura di registro distribuito e immutabile permette di registrare in modo trasparente ogni interazione e processo decisionale di un sistema di Ia. Questa trasparenza radicale consente agli utenti di verificare il modo in cui i loro dati vengono impiegati e come gli algoritmi giungono alle loro conclusioni. Immaginiamo, ad esempio, un sistema di Ia utilizzato in ambito sanitario: ogni diagnosi, ogni raccomandazione terapeutica, ogni decisione presa dall’algoritmo potrebbe essere registrata sulla blockchain, insieme ai dati che l’hanno motivata. In questo modo, il paziente avrebbe la possibilità di comprendere appieno il ragionamento dietro la decisione medica e, se necessario, di contestarla. Questo meccanismo non solo incrementa la fiducia nel sistema, ma permette anche di individuare eventuali errori o anomalie, favorendo un miglioramento continuo e una maggiore accountability.

Oltre alla trasparenza, la blockchain gioca un ruolo cruciale nell’accountability. La sua capacità di tracciare l’origine dei dati utilizzati per addestrare gli algoritmi di Ia è fondamentale per identificare e correggere eventuali pregiudizi che potrebbero insinuarsi nel processo di apprendimento. Come sottolineato da più parti, la qualità e l’affidabilità di un algoritmo di Ia dipendono direttamente dalla qualità e dall’affidabilità dei dati con cui è stato addestrato. Se i dati sono distorti, incompleti o manipolati, l’Ia ne risulterà inevitabilmente compromessa, producendo risultati iniqui o discriminatori. La blockchain, grazie alla sua capacità di registrare in modo immutabile la provenienza e la storia dei dati, permette di ricostruire l’intero processo di addestramento dell’algoritmo, individuando eventuali fonti di bias e correggendole tempestivamente. In questo modo, si può garantire che l’Ia operi in modo equo e imparziale, senza perpetuare o amplificare le disuguaglianze esistenti.

La decentralizzazione, un altro pilastro della tecnologia blockchain, contribuisce ulteriormente a rafforzare l’etica dell’Ia. La blockchain permette di creare sistemi di Ia decentralizzati, in cui il controllo degli algoritmi non è concentrato nelle mani di un’unica entità. Questa distribuzione del potere riduce drasticamente il rischio di manipolazioni e abusi, promuovendo una maggiore equità e partecipazione. In un sistema centralizzato, un’unica organizzazione detiene il controllo completo sull’algoritmo e sui dati, potendo potenzialmente utilizzarli per scopi non etici o per favorire i propri interessi. In un sistema decentralizzato, invece, il controllo è distribuito tra una molteplicità di attori, ognuno dei quali ha la possibilità di monitorare e validare il funzionamento dell’algoritmo. Questo meccanismo di controllo distribuito rende molto più difficile la manipolazione del sistema e garantisce che l’Ia operi in modo trasparente e responsabile.

Infine, la blockchain incrementa l’auditabilità dei sistemi di Ia. Ogni transazione, ogni decisione, ogni interazione registrata sulla blockchain è verificabile in modo indipendente da chiunque. Questa trasparenza radicale facilita l’audit degli algoritmi di Ia, consentendo di verificare che siano conformi agli standard etici e legali. Inoltre, l’Ia stessa può essere impiegata per auditare le blockchain, creando smart contract in grado di validare la sicurezza e l’integrità dell’ecosistema. Questa sinergia tra Ia e blockchain crea un circolo virtuoso di trasparenza e responsabilità, in cui i sistemi di Ia sono costantemente monitorati e valutati per garantire che operino in modo etico e conforme alle normative.

Nel contesto delle attività di audit è fondamentale il concetto di “Explainable AI“. La blockchain può contribuire a risolvere la questione della “Explainable AI” assicurando l’immutabilità dei dati utilizzati per il training e facilitando l’individuazione di deep fake.

Progetti concreti e visioni future

L’integrazione tra Ia e blockchain per promuovere l’etica non è solo un’idea teorica, ma si sta concretizzando in diversi progetti innovativi in tutto il mondo. Un esempio particolarmente interessante è il progetto PARS (Piattaforma Aperta per la Ricerca in Sanità), un’iniziativa italiana che mira a creare un mercato di dati sanitari etico e responsabile utilizzando la blockchain. Il progetto coinvolge diversi attori, tra cui data owner (i pazienti, che controllano i propri dati), data provider (strutture sanitarie che raccolgono e organizzano i dati) e data processor (enti di ricerca che analizzano i dati). PARS utilizza la blockchain e ambienti di esecuzione sicuri (Trusted Execution Environment, TEE) per garantire la privacy dei dati. I pazienti possono vendere il diritto di utilizzare i propri dati per la ricerca, senza rinunciare al controllo su di essi e ricevendo una remunerazione per il loro contributo. Questo modello innovativo promuove la condivisione dei dati sanitari in modo sicuro e trasparente, accelerando la ricerca medica e migliorando la cura dei pazienti. Il progetto adotta un modello decentralizzato in cui i diritti di utilizzo dei dati possono essere concessi senza trasferire la proprietà dei dati. Secondo i protagonisti del progetto, PARS mira a liberare il potenziale dei dati sanitari nel pieno rispetto della privacy e di favorire la nascita di un nuovo modello economico con una ripartizione dei proventi automatica, incontrovertibile e trasparente.

Un altro esempio degno di nota è BurstIQ, una piattaforma che utilizza la blockchain per gestire i dati dei pazienti in modo sicuro e conforme alle normative. BurstIQ consente ai pazienti di avere il controllo completo sui propri dati sanitari, decidendo a chi concedere l’accesso e per quali finalità. La piattaforma utilizza la blockchain per registrare in modo immutabile ogni interazione con i dati, garantendo la trasparenza e l’auditabilità del sistema. BurstIQ ha stretto partnership con diverse organizzazioni sanitarie per implementare soluzioni basate sulla blockchain per la gestione dei dati dei pazienti, la ricerca clinica e la prevenzione delle frodi.

Questi progetti rappresentano solo un piccolo assaggio del potenziale dell’integrazione tra Ia e blockchain per promuovere l’etica. Molti altri progetti sono in fase di sviluppo in diversi settori, dalla finanza alla logistica, dalla governance alla protezione dell’ambiente. L’obiettivo comune è quello di creare sistemi di Ia più trasparenti, responsabili ed equi, in cui gli utenti abbiano il controllo sui propri dati e possano partecipare attivamente al processo decisionale.

Le visioni future sull’integrazione tra Ia e blockchain sono estremamente promettenti. Molti esperti ritengono che questa combinazione tecnologica possa rivoluzionare il modo in cui sviluppiamo, implementiamo e monitoriamo gli algoritmi di Ia, aprendo la strada a un futuro più equo, trasparente e responsabile. Tuttavia, è importante affrontare le sfide che ancora ostacolano l’adozione su larga scala di questi sistemi, come la scalabilità, la privacy e la complessità tecnica.

Sfide e opportunità all’orizzonte

L’adozione della blockchain per l’etica dell’Ia è un percorso costellato di sfide, ma anche ricco di opportunità. La scalabilità rappresenta una delle principali criticità. Le blockchain, soprattutto quelle pubbliche, possono avere difficoltà a gestire un elevato numero di transazioni, il che potrebbe limitare l’utilizzo di sistemi di Ia decentralizzati in applicazioni che richiedono un’alta velocità di elaborazione. La privacy è un’altra questione cruciale. Sebbene la blockchain garantisca la trasparenza delle transazioni, è necessario proteggere la riservatezza dei dati personali degli utenti. Sono state sviluppate diverse tecniche per preservare la privacy sulla blockchain, come le prove a conoscenza zero e le transazioni confidenziali, ma è necessario continuare a ricercare soluzioni innovative per garantire la protezione dei dati sensibili. La complessità tecnica rappresenta un ulteriore ostacolo. La blockchain è una tecnologia relativamente nuova e complessa, che richiede competenze specialistiche per essere implementata e gestita correttamente. È necessario formare professionisti qualificati in grado di progettare, sviluppare e mantenere sistemi di Ia decentralizzati basati sulla blockchain.

Nonostante queste sfide, le opportunità offerte dall’integrazione tra Ia e blockchain sono enormi. La blockchain potrebbe rivoluzionare il modo in cui sviluppiamo, implementiamo e monitoriamo gli algoritmi di Ia, aprendo la strada a un futuro più equo, trasparente e responsabile. Come evidenziato da più parti, la blockchain può contribuire a risolvere la questione della Explainable AI, assicurando l’immutabilità dei dati utilizzati per il training e facilitando l’individuazione di deep fake. Tuttavia, è fondamentale affrontare il rischio di pregiudizi nei dati e negli algoritmi. La blockchain può contribuire a mitigare questi rischi, garantendo la trasparenza e l’auditabilità dei dati e degli algoritmi, ma è necessario un impegno costante per identificare e correggere i bias.

Inoltre, l’adozione di standard e regolamenti chiari è fondamentale per promuovere l’integrazione tra Ia e blockchain. È necessario definire standard etici e legali per lo sviluppo e l’utilizzo di sistemi di Ia decentralizzati, garantendo la protezione dei diritti degli utenti e la prevenzione di abusi. È inoltre necessario promuovere la collaborazione tra governi, aziende e ricercatori per sviluppare soluzioni innovative che affrontino le sfide tecniche e normative.

In definitiva, l’integrazione tra Ia e blockchain rappresenta una grande opportunità per creare un futuro più equo, trasparente e responsabile. Tuttavia, è necessario affrontare le sfide con un approccio olistico, che tenga conto degli aspetti tecnici, etici e sociali. Solo in questo modo potremo sfruttare appieno il potenziale di queste tecnologie e costruire un mondo in cui l’Ia sia al servizio dell’umanità.

Un futuro etico per l’intelligenza artificiale

L’intelligenza artificiale decentralizzata rappresenta un cambio di paradigma cruciale nel panorama digitale odierno. Promuovendo la trasparenza, la governance etica e un maggiore controllo da parte degli utenti, questo approccio potrebbe non solo migliorare la fiducia nel settore tecnologico, ma anche garantire una maggiore equità per le generazioni future. In un mondo in cui la tecnologia continua a progredire, abbracciare e sostenere soluzioni decentralizzate potrebbe aprire la strada a un futuro più inclusivo e innovativo per tutti. Tuttavia, è necessario affrontare le sfide legate alla scalabilità, alla privacy e alla complessità tecnica, e garantire che questi sistemi siano conformi alle leggi e ai regolamenti vigenti.

La blockchain, in sintesi, può permettere di creare un sistema di intelligenza artificiale distribuita e trasparente, che sia capace di auto-verificarsi e correggersi, e soprattutto che permetta la rimozione dei pregiudizi. Altrettanto rilevante è la possibilità di creare un mercato di dati che permetta di remunerare gli utenti e proteggerli al contempo. Tutto ciò è possibile grazie alle caratteristiche uniche della blockchain, che unisce trasparenza, sicurezza e decentralizzazione.

Approfondiamo un concetto base, che ci aiuta a capire meglio tutto ciò: l’algoritmo. Un algoritmo, in termini semplici, è una sequenza di istruzioni che un computer esegue per risolvere un problema. Nel contesto dell’intelligenza artificiale, gli algoritmi vengono utilizzati per addestrare i modelli di apprendimento automatico. Un esempio di algoritmo è la regressione lineare.

Parlando invece di qualcosa di più avanzato, possiamo citare le reti neurali convoluzionali (CNN). Queste reti sono particolarmente adatte per l’elaborazione di immagini e video, e vengono utilizzate in molte applicazioni di intelligenza artificiale, come il riconoscimento facciale e la guida autonoma. La loro capacità di imparare automaticamente le caratteristiche più importanti dei dati le rende estremamente potenti e versatili.

Quello che emerge è che, per orientarsi in questo futuro, è necessaria una riflessione continua. Dobbiamo chiederci costantemente se la direzione che stiamo prendendo sia quella giusta, se stiamo tenendo conto di tutti i fattori in gioco, se stiamo proteggendo i diritti di tutti gli individui. Solo in questo modo potremo costruire un futuro in cui l’intelligenza artificiale sia una forza positiva per l’umanità.