Un Ponte tra Tecnologia e Società

L’Etica dell’IA e il Divario Globale: Un Ponte tra Tecnologia e Società

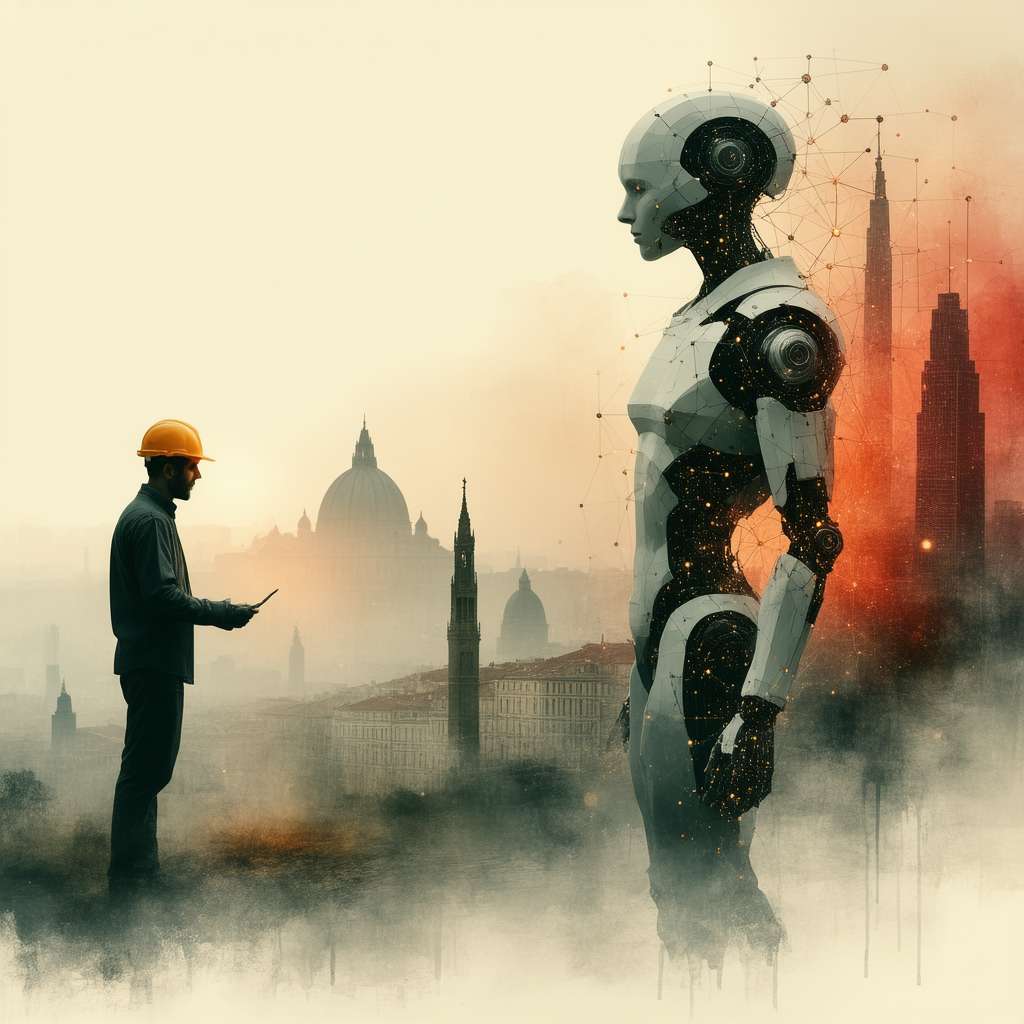

Nel panorama tecnologico odierno, l’intelligenza artificiale (IA) si erge come una forza trasformativa, permeando settori che vanno dalla medicina all’istruzione, dall’economia alla cultura. Tuttavia, questa ondata di progresso tecnologico porta con sé un rischio latente: l’esacerbazione delle disuguaglianze globali. Mentre le nazioni sviluppate cavalcano l’onda dell’innovazione, i paesi in via di sviluppo rischiano di essere lasciati indietro, creando un divario profondo nell’accesso, nell’utilizzo e nei benefici dell’IA. È in questo scenario che la “Raccomandazione sull’Etica dell’IA” dell’UNESCO assume un ruolo cruciale, fungendo da guida per un futuro in cui l’IA sia un motore di inclusione, equità e sviluppo sostenibile.

Il Divario Globale Nell’ia: Una Realtà Multifaceted

Il divario globale nell’IA si manifesta in diverse dimensioni, ciascuna con le proprie sfide e implicazioni. Innanzitutto, esiste un divario tecnologico tangibile. Le nazioni industrializzate, con le loro infrastrutture digitali all’avanguardia, le risorse di calcolo avanzate e un ecosistema di ricerca e sviluppo consolidato, godono di un vantaggio competitivo significativo. Al contrario, i paesi in via di sviluppo spesso lottano con risorse limitate, infrastrutture obsolete e una carenza di competenze specialistiche necessarie per sfruttare appieno il potenziale dell’IA.

Questo squilibrio tecnologico si traduce in un divario sociale altrettanto preoccupante. Nelle economie sviluppate, l’IA genera nuove opportunità di lavoro, migliora l’efficienza dei servizi pubblici e offre soluzioni innovative per sfide complesse. Tuttavia, nei paesi in via di sviluppo, l’automazione guidata dall’IA potrebbe portare alla perdita di posti di lavoro, all’ampliamento delle disuguaglianze di reddito e all’esclusione di intere comunità dai benefici della trasformazione digitale. È essenziale riconoscere che l’IA non è neutrale; la sua implementazione e il suo impatto sono profondamente influenzati dal contesto sociale, economico e culturale in cui viene utilizzata.

La questione della proprietà e del controllo dei dati aggiunge un’ulteriore dimensione a questo divario. Le aziende tecnologiche con sede nei paesi sviluppati spesso raccolgono ed elaborano enormi quantità di dati provenienti dai paesi in via di sviluppo, utilizzando queste informazioni per sviluppare prodotti e servizi che generano profitti principalmente per le economie avanzate. Questo flusso di dati transfrontaliero solleva preoccupazioni sulla sovranità dei dati, sulla privacy e sulla possibilità di sfruttamento. Senza adeguate salvaguardie, i paesi in via di sviluppo rischiano di diventare semplici fornitori di dati, perdendo il controllo sul loro patrimonio digitale e sui benefici derivanti dal suo utilizzo. È cruciale stabilire meccanismi di governance dei dati equi e trasparenti, che consentano ai paesi in via di sviluppo di proteggere i propri interessi e di partecipare attivamente all’economia dei dati globale.

Il digital divide, un problema persistente che ostacola lo sviluppo equo dell’IA, si manifesta nella disuguaglianza di accesso a internet e alle tecnologie digitali. Molte comunità nei paesi in via di sviluppo, in particolare nelle aree rurali e remote, rimangono escluse dalla rete digitale, limitando la loro capacità di beneficiare delle opportunità offerte dall’IA. Superare questo divario richiede investimenti significativi in infrastrutture, connettività e alfabetizzazione digitale, garantendo che tutti abbiano la possibilità di partecipare alla società digitale.

Per esempio, nel settore agricolo, l’IA può ottimizzare l’uso delle risorse, migliorare la resa dei raccolti e prevedere le infestazioni di parassiti, aumentando la sicurezza alimentare e riducendo l’impatto ambientale. Tuttavia, se i piccoli agricoltori non hanno accesso a internet, smartphone o formazione adeguata, rischiano di essere esclusi da questi benefici, ampliando ulteriormente il divario tra agricoltura tradizionale e agricoltura di precisione.

Allo stesso modo, nel settore sanitario, l’IA può migliorare la diagnosi delle malattie, personalizzare i trattamenti e monitorare la salute dei pazienti a distanza. Tuttavia, se le comunità rurali non hanno accesso a infrastrutture sanitarie adeguate o a personale medico qualificato, l’IA rischia di diventare uno strumento che avvantaggia solo le aree urbane e le popolazioni più privilegiate. È fondamentale adattare le soluzioni di IA alle esigenze specifiche dei paesi in via di sviluppo, tenendo conto delle loro risorse limitate, delle loro sfide uniche e delle loro priorità di sviluppo.

Il Ruolo Centrale Della Raccomandazione Unesco Sull’etica Dell’ia

In questo contesto di crescenti disuguaglianze, la “Raccomandazione sull’Etica dell’IA” dell’UNESCO emerge come una bussola, guidando lo sviluppo e l’implementazione dell’IA verso un futuro più equo e inclusivo. Adottata nel novembre 2021, questa raccomandazione rappresenta il primo quadro normativo globale sull’etica dell’IA, fornendo un insieme di principi e valori guida per i governi, le aziende e le organizzazioni della società civile.

La Raccomandazione UNESCO si fonda su quattro pilastri fondamentali:

- Rispetto dei diritti umani e delle libertà fondamentali: L’IA deve essere sviluppata e utilizzata nel rispetto della dignità umana, della privacy, della libertà di espressione e di altri diritti fondamentali. È essenziale proteggere le persone dalla discriminazione, dalla sorveglianza di massa e da altre forme di abuso che potrebbero derivare dall’uso improprio dell’IA.

- Inclusione e diversità: L’IA deve essere accessibile a tutti, indipendentemente dalla loro origine, genere, età o condizione socio-economica. È fondamentale promuovere la diversità nella progettazione, nello sviluppo e nell’implementazione dell’IA, garantendo che le diverse prospettive siano prese in considerazione.

- Sostenibilità: L’IA deve essere utilizzata per promuovere lo sviluppo sostenibile, affrontare le sfide globali come il cambiamento climatico e la povertà e proteggere l’ambiente. È essenziale valutare l’impatto ambientale dell’IA, ridurre il consumo di energia e promuovere l’uso di fonti rinnovabili.

- Trasparenza e responsabilità: I processi decisionali dell’IA devono essere trasparenti e comprensibili, in modo che le persone possano comprendere come vengono prese le decisioni che le riguardano. Gli sviluppatori e gli utenti dell’IA devono essere responsabili delle conseguenze del loro lavoro, garantendo che l’IA sia utilizzata in modo etico e responsabile.

La raccomandazione sottolinea l’importanza della cooperazione internazionale, esortando i paesi sviluppati e in via di sviluppo a collaborare per condividere conoscenze, risorse e competenze nel campo dell’IA. Questa collaborazione dovrebbe includere la creazione di standard comuni, la promozione della ricerca e dello sviluppo congiunti e il sostegno ai paesi in via di sviluppo nell’adozione di tecnologie di IA appropriate. La raccomandazione evidenzia anche la necessità di rafforzare la governance dell’IA a livello nazionale e internazionale, istituendo meccanismi di controllo, valutazione e responsabilità per garantire che l’IA sia utilizzata in modo etico e responsabile. Questo potrebbe includere la creazione di agenzie di regolamentazione, la definizione di codici di condotta e l’istituzione di meccanismi di ricorso per le persone che sono state danneggiate dall’IA.

Inoltre, la raccomandazione riconosce l’importanza dell’educazione e della sensibilizzazione, incoraggiando i governi e le istituzioni educative a promuovere l’alfabetizzazione all’IA, a formare esperti di IA e a sensibilizzare il pubblico sui benefici e sui rischi dell’IA. Questo dovrebbe includere l’insegnamento dei principi etici dell’IA, la promozione del pensiero critico e lo sviluppo di competenze che consentano alle persone di interagire in modo efficace con i sistemi di IA.

Un aspetto particolarmente rilevante della Raccomandazione UNESCO è la sua enfasi sulla protezione dei dati e sulla privacy. La raccomandazione sollecita le aziende tecnologiche e i governi a garantire agli individui un maggiore controllo sui propri dati personali, assicurando trasparenza e controllo. Gli individui dovrebbero avere il diritto di accedere, modificare e cancellare i propri dati personali, e i sistemi di IA non dovrebbero essere utilizzati per la sorveglianza di massa o per il social scoring. Questa enfasi sulla protezione dei dati è particolarmente importante nei paesi in via di sviluppo, dove le leggi sulla privacy potrebbero essere meno sviluppate e le persone potrebbero essere più vulnerabili allo sfruttamento dei dati.

Infine, la Raccomandazione UNESCO riconosce l’importanza di affrontare le implicazioni etiche dell’IA per l’ambiente. La raccomandazione esorta i governi a valutare l’impatto ambientale dei sistemi di IA, a ridurre il consumo di energia e a promuovere l’uso di fonti rinnovabili. Inoltre, la raccomandazione incoraggia gli AI actors a utilizzare l’IA per affrontare le sfide ambientali come il cambiamento climatico, la perdita di biodiversità e l’inquinamento. Questo potrebbe includere lo sviluppo di sistemi di IA per monitorare l’ambiente, ottimizzare l’uso delle risorse e prevedere i disastri naturali.

Promuovere L’inclusione Attraverso La Formazione E Lo Sviluppo Di Infrastrutture

Per colmare efficacemente il divario globale nell’IA, è imperativo intraprendere azioni concrete in tre aree chiave: formazione, infrastrutture e accessibilità.

Investire nella formazione è fondamentale per sviluppare competenze in IA nei paesi in via di sviluppo. Questo include la creazione di programmi educativi che forniscano agli studenti le conoscenze e le competenze necessarie per progettare, sviluppare e utilizzare sistemi di IA. È altrettanto importante formare i professionisti che lavorano in settori come l’agricoltura, la sanità e l’istruzione, in modo che possano utilizzare l’IA per migliorare il loro lavoro e fornire servizi migliori. La formazione dovrebbe essere accessibile a tutti, indipendentemente dal loro genere, età o condizione socio-economica. Ciò potrebbe richiedere la fornitura di borse di studio, programmi di tutoraggio e risorse online gratuite. È inoltre importante adattare i programmi di formazione alle esigenze specifiche dei paesi in via di sviluppo, tenendo conto delle loro culture, delle loro lingue e delle loro priorità di sviluppo.

Parallelamente alla formazione, è necessario creare infrastrutture digitali adeguate nei paesi in via di sviluppo. Questo include l’accesso a internet a banda larga, a risorse di calcolo ad alte prestazioni e a piattaforme di dati affidabili. Senza queste infrastrutture, i paesi in via di sviluppo non saranno in grado di partecipare pienamente all’economia dell’IA. La creazione di infrastrutture digitali richiede investimenti significativi da parte dei governi, delle aziende e delle organizzazioni internazionali. È anche importante promuovere la concorrenza nel settore delle telecomunicazioni, in modo da ridurre i costi e aumentare l’accesso a internet.

Infine, è essenziale promuovere lo sviluppo di applicazioni di IA accessibili e adatte alle esigenze dei paesi in via di sviluppo. Questo significa creare applicazioni che siano facili da usare, a basso costo e in grado di risolvere problemi specifici che affliggono questi paesi. Ad esempio, l’IA potrebbe essere utilizzata per migliorare la diagnosi delle malattie, ottimizzare la produzione agricola, fornire servizi finanziari alle persone non bancarizzate o prevedere i disastri naturali. È importante coinvolgere le comunità locali nella progettazione e nello sviluppo di queste applicazioni, in modo da garantire che siano adatte alle loro esigenze e che siano utilizzate in modo etico e responsabile.

Questi sforzi devono essere supportati da politiche che promuovano l’innovazione responsabile dell’IA e che proteggano i diritti dei cittadini. Queste politiche dovrebbero includere la definizione di standard etici, la creazione di meccanismi di controllo e valutazione e l’istituzione di meccanismi di ricorso per le persone che sono state danneggiate dall’IA. È anche importante promuovere la trasparenza nei processi decisionali dell’IA, in modo che le persone possano comprendere come vengono prese le decisioni che le riguardano.

Un esempio concreto di successo è rappresentato da alcuni progetti in Africa, dove l’IA viene utilizzata per migliorare la diagnosi delle malattie attraverso sistemi di imaging medico assistiti dall’IA, che consentono di individuare precocemente patologie come la tubercolosi e il cancro al seno, aumentando le possibilità di successo del trattamento. Un altro esempio è l’utilizzo dell’IA per ottimizzare la produzione agricola, fornendo agli agricoltori informazioni in tempo reale sulle condizioni del suolo, sulle previsioni meteorologiche e sulle infestazioni di parassiti, consentendo loro di prendere decisioni più informate e di aumentare la resa dei raccolti. L’IA viene anche utilizzata per fornire servizi finanziari alle persone non bancarizzate, attraverso applicazioni mobili che offrono microcredito, assicurazioni e altri servizi finanziari a basso costo.

Tuttavia, è importante riconoscere che questi progetti spesso incontrano ostacoli significativi. La mancanza di dati di qualità è un problema comune, in quanto i sistemi di IA richiedono grandi quantità di dati per essere addestrati e per funzionare in modo efficace. La limitata capacità tecnica è un altro ostacolo, in quanto i paesi in via di sviluppo spesso non dispongono del personale qualificato necessario per progettare, sviluppare e mantenere sistemi di IA. La mancanza di finanziamenti sostenibili è anche un problema, in quanto molti progetti di IA dipendono da finanziamenti esterni che non sono sempre garantiti a lungo termine. Per superare questi ostacoli, è necessario un impegno coordinato da parte dei governi, delle aziende, delle organizzazioni della società civile e della comunità accademica. Questo impegno dovrebbe includere investimenti in dati, capacità tecniche e finanziamenti sostenibili.

Un Futuro In Cui L’ia Sia Un Bene Comune

Guardando avanti, l’imperativo è chiaro: l’IA deve essere sviluppata e utilizzata come un bene comune, accessibile a tutti e in grado di promuovere il progresso umano in modo equo e sostenibile. Questo richiede un cambiamento di mentalità, passando da un approccio incentrato sulla tecnologia a un approccio incentrato sull’uomo. L’IA non deve essere vista come un fine a sé stessa, ma come uno strumento per affrontare le sfide globali, migliorare la qualità della vita e promuovere la giustizia sociale.

Per raggiungere questo obiettivo, è necessario un impegno costante e collaborativo da parte di tutti gli attori coinvolti. I governi devono adottare politiche che promuovano l’innovazione responsabile dell’IA, che proteggano i diritti dei cittadini e che garantiscano che l’IA sia utilizzata in modo etico e responsabile. Le aziende devono sviluppare e implementare sistemi di IA che siano trasparenti, responsabili e rispettosi dei diritti umani. Le organizzazioni della società civile devono svolgere un ruolo di controllo, monitorando l’impatto dell’IA sulla società e sensibilizzando il pubblico sui suoi benefici e sui suoi rischi. La comunità accademica deve continuare a svolgere ricerche sull’etica dell’IA, sviluppando nuovi strumenti e metodi per garantire che l’IA sia utilizzata in modo responsabile.

È essenziale promuovere un dialogo aperto e inclusivo sull’IA, coinvolgendo tutti gli stakeholder e tenendo conto delle diverse prospettive. Questo dialogo dovrebbe affrontare questioni come la privacy, la sicurezza, la responsabilità, la trasparenza e l’equità. Dovrebbe anche esplorare le implicazioni dell’IA per il futuro del lavoro, dell’istruzione, della sanità e di altri settori.

Infine, è importante riconoscere che l’IA è solo uno strumento e che il suo impatto sulla società dipenderà da come lo utilizziamo. Sta a noi garantire che l’IA sia utilizzata per costruire un futuro migliore per tutti.

Oggi, 30 ottobre 2025, mentre l’IA continua a evolversi e a trasformare il nostro mondo, la “Raccomandazione sull’Etica dell’IA” dell’UNESCO rimane una guida fondamentale, un promemoria costante del nostro dovere di garantire che questa potente tecnologia sia utilizzata per il bene dell’umanità.

Parliamoci chiaro, l’intelligenza artificiale è un campo vastissimo. Per capire meglio di cosa stiamo parlando, pensa all’apprendimento automatico (Machine Learning): è come insegnare a un bambino a distinguere un cane da un gatto mostrandogli tante foto. Più esempi vede, più diventa bravo a riconoscere le differenze. Ora immagina di applicare questo concetto a problemi complessi come la diagnosi medica o la previsione del mercato azionario.

E se volessimo andare oltre? L’apprendimento per rinforzo (Reinforcement Learning) è un approccio avanzato. Immagina di addestrare un robot a camminare: ad ogni passo giusto gli dai una “ricompensa”, ad ogni passo sbagliato una “penalità”. Dopo tanti tentativi, il robot impara a camminare da solo, senza che tu gli abbia detto esattamente come fare. Allo stesso modo, potremmo usare l’apprendimento per rinforzo per creare sistemi di IA che prendano decisioni complesse in ambienti incerti, come la gestione del traffico urbano o la progettazione di nuovi farmaci.

Ma fermiamoci un attimo a riflettere. L’IA è uno strumento potente, ma è pur sempre uno strumento. Il suo valore dipende da come lo usiamo. Dobbiamo assicurarci che sia accessibile a tutti, che sia utilizzata in modo responsabile e che non amplifichi le disuguaglianze esistenti. Il futuro dell’IA è nelle nostre mani.