—–

L’Arizona e la Rivoluzione Educativa

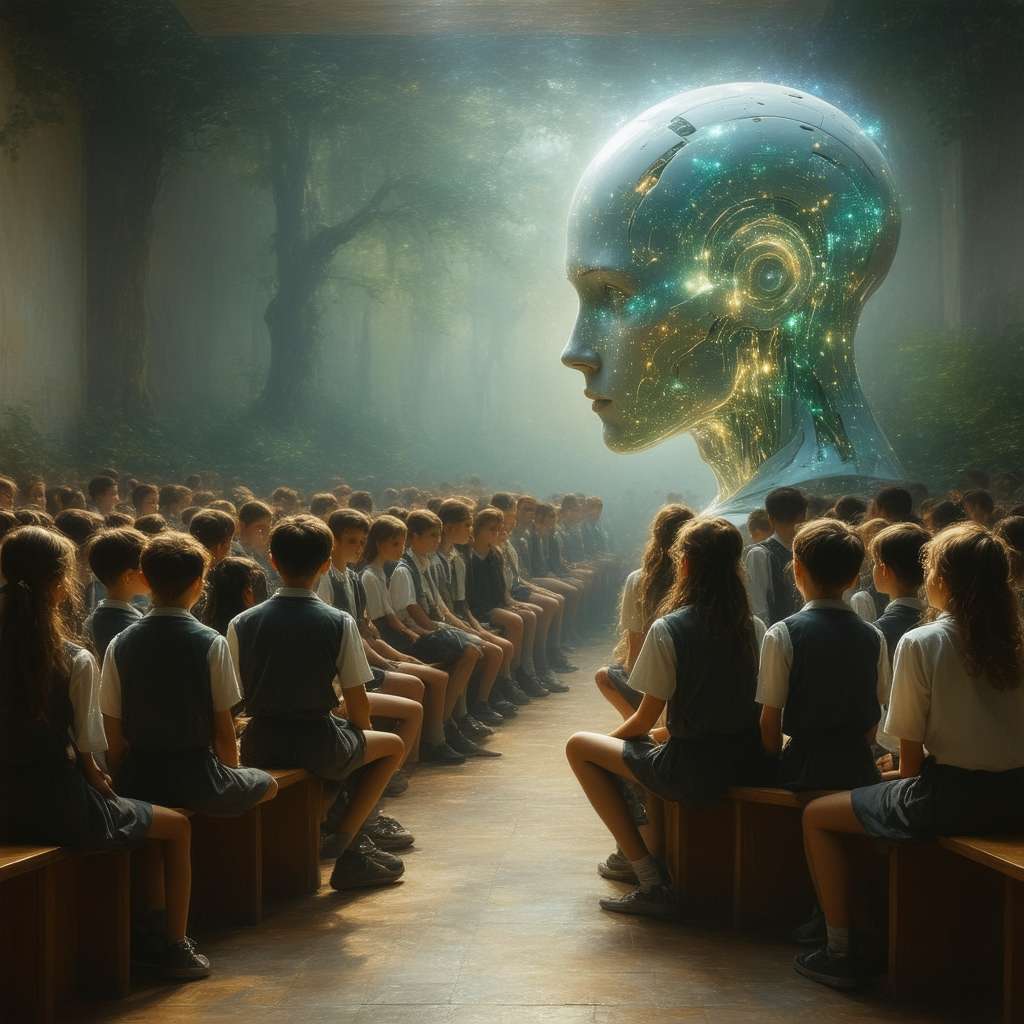

La recente approvazione della Unbound Academy, una scuola online che utilizza in modo totale l’intelligenza artificiale (AI), segna un momento significativo nell’ambito educativo dell’Arizona. Questa iniziativa rivoluzionaria mette in discussione le convenzioni pedagogiche classiche e si prefigge l’obiettivo ambizioso di rinnovare profondamente la modalità d’insegnamento. La Unbound Academy, infatti, non ha pari nel contesto globale delle istituzioni scolastiche; abbandona del tutto il consueto format delle lezioni in aula per proporre un sistema completamente digitale. L’utilizzo dell’AI consente una personalizzazione elevata del curriculum accademico, capace di rispondere con flessibilità ai ritmi individuali e alle necessità peculiari degli studenti. Così facendo, offre la possibilità d’apprendere intensivamente in sole due ore giornaliere mantenendo però elevati standard qualitativi nei contenuti proposti.

Unbound Academy: Interattività e Life Skills

Le peculiarità distintive della Unbound Academy comprendono avanzati sistemi di interazione che si adattano alle competenze degli allievi, proponendo sfide graduali in linea con il loro progresso. La supervisione da parte di professionisti, chiamati “guide esperte”, è assicurata, monitorando i miglioramenti e fornendo supporto nei momenti più critici. Un ulteriore elemento di forza è l’accesso universale, grazie a una piattaforma online utilizzabile in qualsiasi luogo, annullando così qualsiasi confine geografico. Una caratteristica speciale è l’enfasi posta sulle “life skills”, capacità pratiche fondamentali per preparare gli studenti a confrontarsi con la vita quotidiana. Accanto alle classiche materie scolastiche viene data rilevante attenzione a tematiche come la gestione delle finanze personali, l’arte del public speaking e il problem solving. Tale focalizzazione rappresenta un distacco significativo dal tradizionale metodo educativo, spesso messo in discussione per la limitata applicazione pratica delle nozioni insegnate.

I Vantaggi e le Sfide dell’AI nell’Istruzione

L’utilizzo dell’AI nel campo dell’istruzione offre molti benefici, ma pone anche quesiti significativi. La possibilità di un apprendimento personalizzato consente a ciascun alunno di sviluppare un percorso su misura e la concentrazione sui programmi riduce le ridondanze temporali. La capacità di accesso globale appare come un altro beneficio, favorendo l’opportunità di partecipare alle lezioni da qualsiasi luogo. Tuttavia, la qualità della supervisione umana si baserà sull’abilità delle “guide esperte” nel compensare le carenze dell’AI. È altresì cruciale assicurare che tutti gli studenti possano accedere alle risorse tecnologiche necessarie per prevenire ineguaglianze.

Un Nuovo Paradigma per l’Istruzione Globale

La proposta avanzata da Unbound Academy ha la potenzialità di fungere da catalizzatore per una trasformazione profonda dei modelli didattici globali. È tuttavia imperativo considerare con attenzione le conseguenze che derivano dall’adozione esclusiva dell’AI in questo contesto educativo. Solo garantendo un’adeguata sinergia tra progressi tecnologici ed intervento umano si potranno sfruttare a pieno le opportunità offerte da questa svolta formativa. La tecnologia dell’intelligenza artificiale consente lo sviluppo di sistemi educativi su misura, promuovendo una maggiore inclusività nell’accesso all’istruzione per ogni discente, senza distinzione alcuna legata alle origini socio-culturali. Nonostante ciò, appare cruciale investire nella coltivazione e nel potenziamento delle competenze emergenti; infine l’intelligenza emotiva, così come il pensiero creativo, continuano a contraddistinguere l’esperienza umana in modo irrinunciabile.

In conclusione, l’introduzione dell’intelligenza artificiale nell’istruzione rappresenta una sfida e un’opportunità senza precedenti. Nel campo dell’intelligenza artificiale, una nozione fondamentale da considerare è quella del machine learning, un processo mediante il quale i sistemi hanno la capacità di apprendere ed evolversi autonomamente basandosi sulle esperienze acquisite. Questa tecnologia costituisce il fondamento per la personalizzazione dell’apprendimento offerta da Unbound Academy. In una dimensione più sofisticata, troviamo il deep learning, che sfrutta le potenzialità delle reti neurali artificiali per elaborare enormi volumi di dati e formulare previsioni o prendere decisioni complesse. Mentre ci si sofferma su tali progressi tecnologici, risulta essenziale esplorare in che modo l’AI possa amplificare la qualità dell’esperienza formativa, senza però scordarsi mai dell’importanza della componente umana e dell’empatia nel percorso educativo.

—–