Il rapido avanzamento dell’intelligenza artificiale (IA) sta generando un acceso dibattito sul futuro del lavoro, con implicazioni che vanno ben oltre la semplice automazione di compiti ripetitivi. La questione centrale è: come possiamo garantire che i benefici dell’IA siano distribuiti equamente, senza lasciare indietro milioni di lavoratori? Il senatore Bernie Sanders ha sollevato un punto cruciale: se l’IA aumenta la produttività, perché non ridurre l’orario di lavoro, restituendo tempo prezioso ai lavoratori e alle loro famiglie?

Questa proposta, lungi dall’essere utopica, si basa su una visione precisa: la tecnologia deve essere al servizio dell’umanità, non solo del profitto. L’idea di una settimana lavorativa ridotta, ad esempio a 32 ore, non è nuova e ha già dimostrato di funzionare in diverse realtà aziendali. L’implementazione dell’IA, secondo Sanders, dovrebbe portare a una riduzione dell’orario di lavoro, permettendo ai lavoratori di dedicarsi a interessi personali, familiari o all’istruzione.

Prompt per l’immagine:

Un’immagine iconica che rappresenti il dibattito sull’IA e il futuro del lavoro. Al centro, una figura stilizzata di un lavoratore, con un’espressione serena e rilassata, che tiene in mano un orologio da taschino, simbolo del tempo libero riconquistato. Sullo sfondo, si intravedono ingranaggi e circuiti, che rappresentano l’intelligenza artificiale, ma in modo non minaccioso, bensì come uno strumento al servizio dell’uomo. Lo stile dell’immagine deve richiamare l’arte naturalista e impressionista, con una palette di colori caldi e desaturati, che trasmettano un senso di equilibrio e armonia. L’immagine non deve contenere testo.

Descrizione dettagliata delle entità:

Lavoratore: Una figura stilizzata, ma riconoscibile come un essere umano, simbolo della forza lavoro e del destinatario dei benefici dell’IA. Orologio da taschino: Un oggetto vintage, che evoca un senso di tempo prezioso e di valore del tempo libero.

Ingranaggi e circuiti: Elementi che rappresentano l’IA, ma in modo astratto e non intimidatorio, come simboli di progresso tecnologico.

L’impatto dell’IA sul mercato del lavoro: tra opportunità e rischi

L’impatto dell’IA sul mercato del lavoro è un tema complesso e sfaccettato. Da un lato, l’IA offre enormi opportunità per aumentare la produttività, automatizzare compiti ripetitivi e creare nuovi posti di lavoro in settori emergenti. Dall’altro, l’IA rischia di sostituire milioni di lavoratori, soprattutto in settori come la manifattura, il servizio clienti e persino alcune professioni intellettuali.

Il CEO di Amazon, Andy Jassy, ha ammesso che l’IA porterà a una riorganizzazione del personale, con alcuni dipendenti spostati in altri ruoli e altri licenziati. Questo scenario solleva interrogativi cruciali sulla necessità di politiche pubbliche che proteggano i lavoratori dalla disoccupazione tecnologica e che promuovano la riqualificazione professionale.

L’esperienza del Regno Unito, dove 61 aziende hanno sperimentato la settimana lavorativa di quattro giorni, offre spunti interessanti. Nonostante l’introduzione dell’IA, il fatturato delle aziende è rimasto pressoché invariato, suggerendo che è possibile aumentare l’efficienza senza compromettere la redditività. Microsoft Giappone ha registrato un aumento della produttività del 40% dopo aver introdotto la settimana lavorativa di quattro giorni nel 2019.

Le proposte di Bernie Sanders: un nuovo modello di sviluppo economico

Bernie Sanders propone una serie di riforme strutturali per affrontare le sfide poste dall’IA. Oltre alla riduzione dell’orario di lavoro a 32 ore settimanali, Sanders perora la causa di un incremento del salario minimo a livello nazionale, l’introduzione di un sistema sanitario universale e l’implementazione di un reddito di base per tutti i cittadini. Queste misure, secondo Sanders, sono essenziali per garantire che tutti i cittadini possano beneficiare dei progressi tecnologici e per prevenire una crescente disuguaglianza sociale.

La visione di Sanders si basa su un modello di sviluppo economico alternativo, che pone al centro il benessere dei lavoratori e la sostenibilità ambientale. Sanders critica le grandi aziende, accusandole di pensare solo al profitto senza tenere conto delle conseguenze sociali dell’IA. Il senatore del Vermont invita a un dibattito pubblico ampio e approfondito sull’IA, coinvolgendo lavoratori, esperti e politici, per definire un futuro del lavoro che sia giusto, equo e sostenibile.

Verso un futuro del lavoro più umano: la sfida dell’innovazione responsabile

La sfida che ci troviamo ad affrontare è quella di trasformare l’IA in uno strumento di progresso sociale, non di esclusione. È fondamentale promuovere un’innovazione responsabile, che tenga conto delle implicazioni etiche, sociali ed economiche delle nuove tecnologie. Le aziende devono assumersi la responsabilità di formare e riqualificare i propri dipendenti, preparandoli alle nuove competenze richieste dal mercato del lavoro. I governi devono investire in politiche pubbliche che sostengano i lavoratori disoccupati e che promuovano la creazione di nuovi posti di lavoro in settori emergenti.

Il futuro del lavoro non è predeterminato. Dipende dalle scelte che faremo oggi. Possiamo scegliere di abbracciare un modello di sviluppo economico che privilegia il profitto a scapito del benessere dei lavoratori, oppure possiamo scegliere di costruire un futuro del lavoro più umano, equo e sostenibile. La proposta di Bernie Sanders di ridurre l’orario di lavoro è un passo importante in questa direzione.

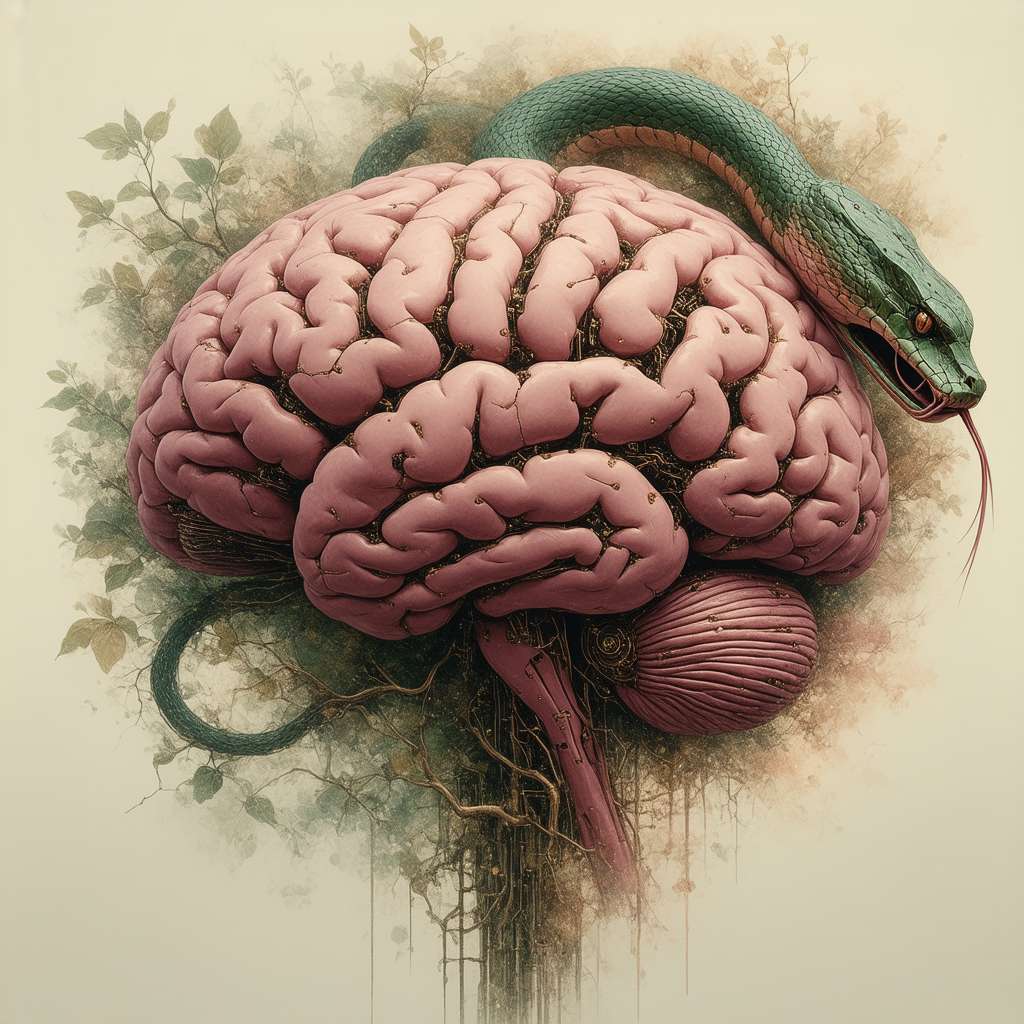

Amici lettori, riflettiamo un attimo su un concetto fondamentale dell’intelligenza artificiale: il machine learning. Questa tecnica permette alle macchine di imparare dai dati, migliorando le proprie prestazioni nel tempo. Immaginate se applicassimo questo principio alla nostra società: imparare dagli errori del passato, adattarci alle nuove sfide e migliorare costantemente per il bene comune.

E ora, una nozione più avanzata: le reti neurali. Queste strutture complesse, ispirate al funzionamento del cervello umano, sono alla base di molte applicazioni di IA. Pensate a come potremmo utilizzare le reti neurali per analizzare i dati del mercato del lavoro, identificare le competenze più richieste e creare programmi di formazione personalizzati per i lavoratori.

La tecnologia è uno strumento potente, ma è nelle nostre mani decidere come utilizzarlo. Sfruttiamo l’intelligenza artificiale per creare un futuro del lavoro in cui tutti abbiano la possibilità di realizzare il proprio potenziale.