L’evoluzione del settore turistico è sempre più influenzata dall’adozione di tecnologie avanzate, con l’intelligenza artificiale (IA) che emerge come un elemento centrale. Recenti eventi e iniziative in Italia hanno messo in luce come l’IA stia trasformando l’industria dell’ospitalità, migliorando l’efficienza operativa e l’esperienza del cliente. A Ischia, il #ILoveIschiaLab di Federalberghi, con il patrocinio di EBTC, ha organizzato un ciclo di incontri per formare i professionisti del turismo sull’uso dell’IA. Questi eventi, che si svolgono presso il Museo Diocesano MUDIS, offrono un’opportunità unica per esplorare le applicazioni pratiche dell’IA nel settore alberghiero, con esperti come Simona Ali e Luca Damiani di Booking.com che discutono delle tendenze emergenti.

Innovazione Friulana e l’IA nel Turismo

Il Friuli-Venezia Giulia si distingue come un centro di innovazione nel campo dell’intelligenza artificiale applicata al turismo. Durante la Borsa Internazionale del Turismo (BIT) di Milano, sono stati presentati progetti all’avanguardia, tra cui chatbot intelligenti sviluppati presso il Parco Scientifico e Tecnologico Luigi Danieli di Udine. Questi strumenti sono progettati per offrire esperienze personalizzate ai visitatori, adattando contenuti e interfacce in tempo reale. Un esempio significativo è il chatbot creato per la città di Genova, che sarà operativo su VisitGenoa.it nel 2025. Questo assistente virtuale fornirà supporto interattivo, itinerari personalizzati e consigli basati sugli interessi individuali, contribuendo a una crescita del turismo che ha visto un aumento del 4% dei pernottamenti nel 2024.

BTO 2024: Un Ponte tra Digitale e Umano

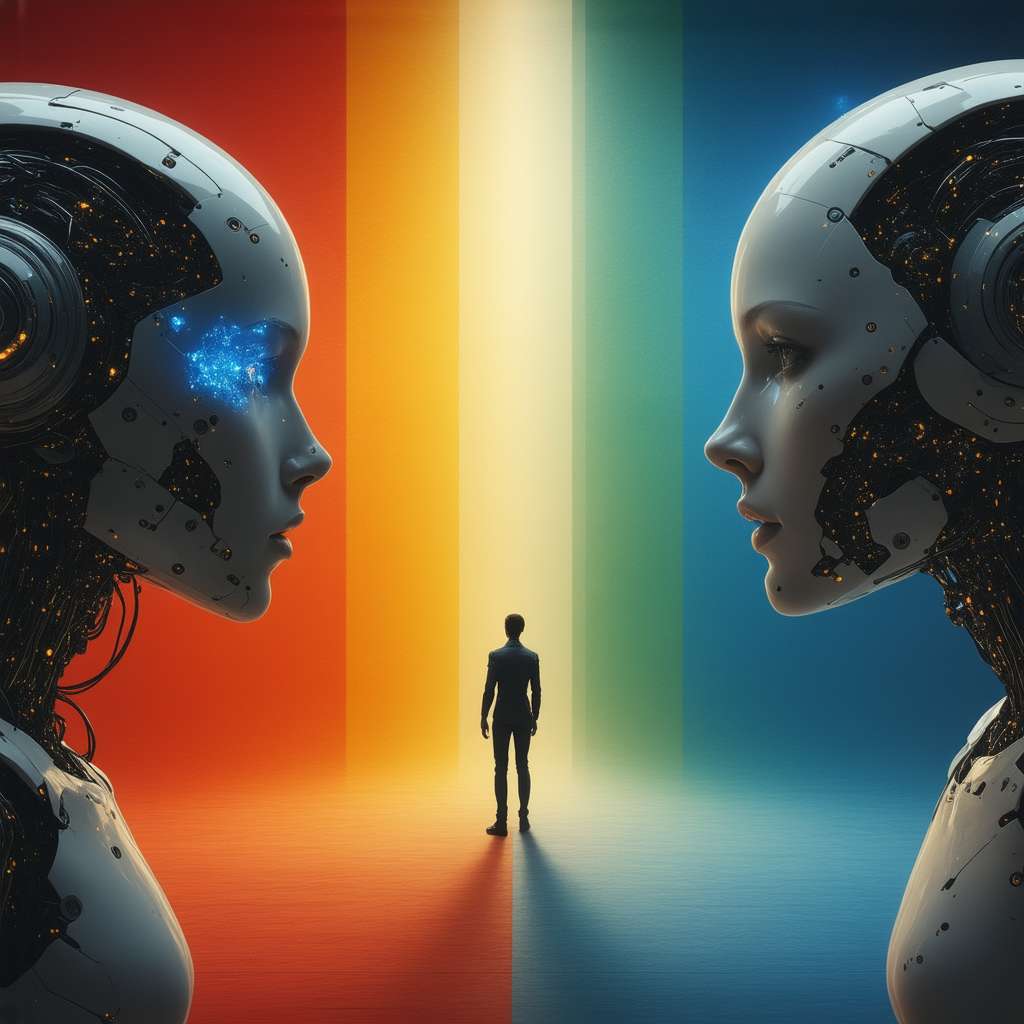

L’edizione 2024 di BTO – Be Travel Onlife, tenutasi a Firenze, ha esplorato il tema “BALANCE: AI Confluence in Travel”, concentrandosi sull’integrazione tra intelligenza artificiale e valore umano nel turismo. L’evento ha sottolineato come l’IA possa essere vista non come una minaccia, ma come un’opportunità per migliorare le relazioni umane e l’autenticità delle esperienze turistiche. In questo contesto, EDI Confcommercio ha organizzato un panel su “Strumenti di Assessment per l’AI nell’Ospitalità”, evidenziando come l’IA stia rivoluzionando prenotazioni, protezione dei dati e analisi predittive. Quest’iniziativa rientra nel programma chiamato Tuscany X.0, finalizzato a incentivare il progresso tecnologico e l’innovazione nel settore.

Conclusioni: L’IA come Motore di Innovazione

L’intelligenza artificiale rappresenta una risorsa inestimabile per il settore turistico, offrendo strumenti per ottimizzare i processi e personalizzare l’esperienza del cliente. L’adozione di queste tecnologie non solo migliora l’efficienza operativa, ma consente anche di creare esperienze più coinvolgenti e su misura per i turisti. Tuttavia, è fondamentale bilanciare l’innovazione tecnologica con il mantenimento del contatto umano, che rimane un elemento essenziale del turismo.

In un contesto in cui l’intelligenza artificiale diventa sempre più pervasiva, è utile comprendere il concetto di machine learning, che permette ai sistemi di apprendere dai dati e migliorare le proprie prestazioni nel tempo. Questo approccio è alla base di molte applicazioni turistiche, come i chatbot e le analisi predittive. Un altro concetto avanzato è quello dei sistemi di raccomandazione, che utilizzano algoritmi complessi per suggerire contenuti personalizzati agli utenti, migliorando l’esperienza complessiva.

Riflettendo su queste innovazioni, emerge l’importanza di un approccio equilibrato che integri tecnologia e umanità, garantendo che il progresso non comprometta l’autenticità e la qualità delle esperienze turistiche.