L’alba di una nuova era: Compagni artificiali e interazione uomo-animale

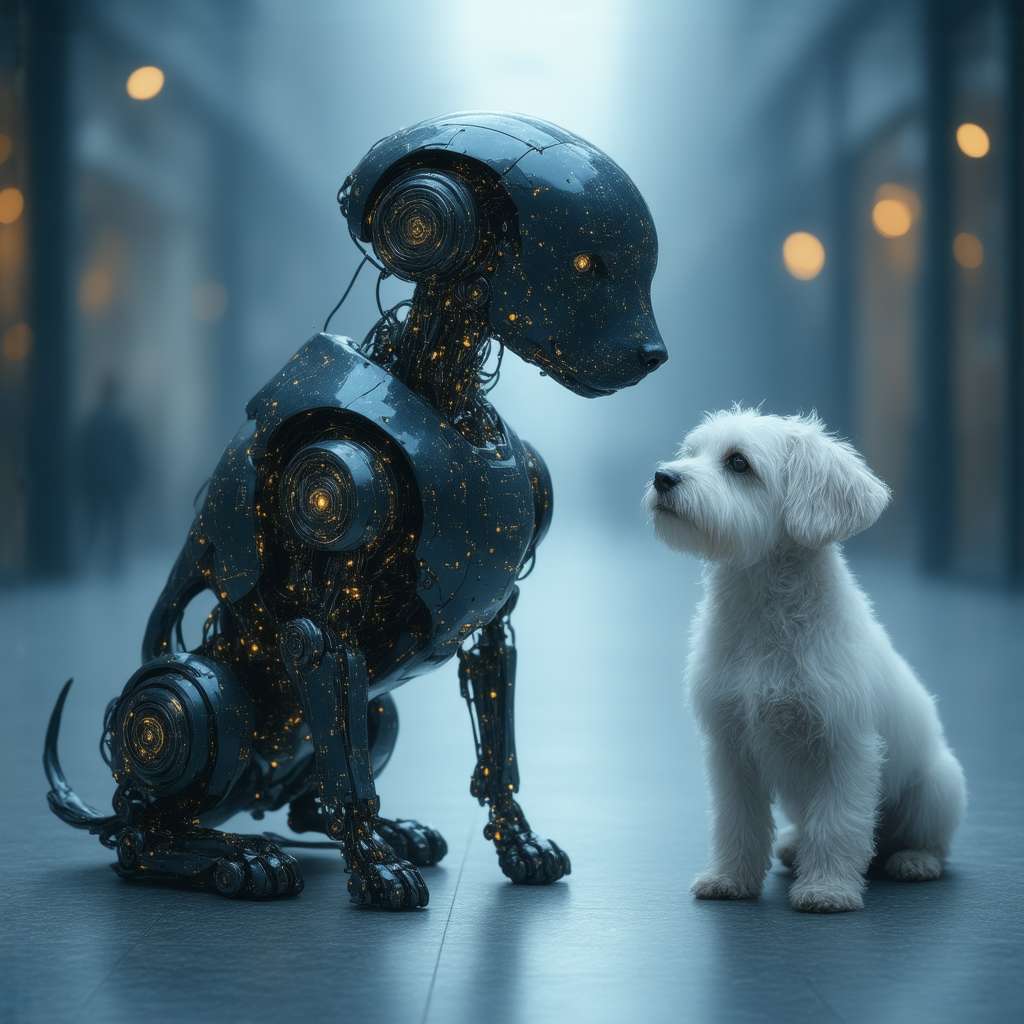

Nel panorama tecnologico attuale, si assiste a una trasformazione significativa nel modo in cui concepiamo la compagnia e l’interazione, aprendo le porte a un futuro in cui gli animali domestici virtuali, guidati dall’intelligenza artificiale (AI), svolgono un ruolo sempre più centrale. Questa evoluzione, che va oltre i semplici pet-bot programmabili, promette di rivoluzionare diversi settori, dall’assistenza alla terapia, fino all’intrattenimento. L’idea di un compagno artificiale capace di interagire in modo realistico con gli esseri umani e gli animali non è più relegata al regno della fantascienza, ma sta diventando una realtà tangibile grazie ai progressi compiuti nel campo dell’AI.

Il fenomeno degli animali domestici virtuali è emerso come una risposta innovativa a diverse esigenze sociali e individuali. In un mondo sempre più digitalizzato, in cui la solitudine e l’isolamento rappresentano sfide crescenti, gli AI pet offrono una forma di compagnia accessibile e personalizzabile. A differenza degli animali domestici tradizionali, che richiedono cure costanti e possono comportare limitazioni logistiche, i compagni virtuali sono sempre disponibili, non richiedono particolari attenzioni e si adattano facilmente agli stili di vita moderni. Questa flessibilità li rende particolarmente attraenti per le persone anziane, i soggetti con disabilità e coloro che vivono in contesti urbani con spazi limitati.

L’ascesa degli AI pet è strettamente legata allo sviluppo di algoritmi avanzati di intelligenza artificiale. Grazie alle tecniche di machine learning e deep learning, i compagni virtuali sono in grado di apprendere, adattarsi e interagire in modo sempre più naturale e spontaneo. Possono riconoscere le emozioni umane, rispondere ai comandi vocali, giocare e persino fornire supporto emotivo. La capacità di personalizzazione rappresenta un altro elemento distintivo degli AI pet. Gli utenti possono scegliere l’aspetto, il carattere e le abilità del proprio compagno virtuale, creando un’esperienza unica e su misura. Questa possibilità di plasmare il proprio animale domestico ideale contribuisce a rafforzare il legame emotivo tra l’utente e l’entità artificiale.

Nonostante i numerosi vantaggi offerti dagli AI pet, è fondamentale considerare le implicazioni etiche e sociali connesse alla loro diffusione. La creazione di entità artificiali capaci di simulare la vita e l’affetto solleva interrogativi profondi sulla natura della compagnia, sull’autenticità delle relazioni e sul ruolo degli animali domestici nella nostra società. È necessario promuovere un dibattito pubblico informato e responsabile, coinvolgendo esperti di diverse discipline, per definire linee guida etiche chiare e garantire che lo sviluppo e l’utilizzo degli AI pet siano guidati da principi di trasparenza, responsabilità e rispetto per la dignità umana e animale.

Tecnologie emergenti e applicazioni innovative

L’evoluzione degli animali domestici virtuali è alimentata da una convergenza di tecnologie all’avanguardia che spaziano dall’intelligenza artificiale alla robotica, dalla computer grafica alla realtà aumentata. Questi progressi tecnologici consentono di creare compagni artificiali sempre più realistici, interattivi e coinvolgenti, aprendo nuove frontiere nel campo dell’assistenza, della terapia e dell’intrattenimento.

L’intelligenza artificiale rappresenta il cuore pulsante degli AI pet. Gli algoritmi di machine learning e deep learning consentono ai compagni virtuali di apprendere dai dati, riconoscere i modelli e adattarsi alle interazioni con gli utenti. Possono analizzare le espressioni facciali, il tono della voce e il linguaggio del corpo per comprendere le emozioni umane e rispondere in modo appropriato. La capacità di apprendimento continuo permette agli AI pet di evolvere nel tempo, diventando sempre più intelligenti e perspicaci.

La robotica svolge un ruolo fondamentale nella creazione di AI pet fisici, dotati di sembianze realistiche e capacità di movimento. I robot companion sono progettati per interagire con gli utenti in modo tattile, offrendo abbracci, carezze e altre forme di contatto fisico. Sono dotati di sensori che rilevano la pressione, il calore e il movimento, consentendo loro di rispondere in modo naturale e intuitivo agli stimoli esterni. La combinazione di intelligenza artificiale e robotica dà vita a compagni artificiali capaci di offrire una forma di compagnia più completa e coinvolgente.

La computer grafica e la realtà aumentata contribuiscono a creare AI pet virtuali, che possono essere visualizzati su schermi, proiettati in ambienti reali o integrati in esperienze immersive. Le tecniche di rendering avanzate consentono di generare immagini realistiche e dettagliate degli animali domestici virtuali, rendendoli indistinguibili dalle loro controparti reali. La realtà aumentata permette agli utenti di interagire con gli AI pet virtuali nel proprio ambiente domestico, creando un’illusione di presenza e interazione.

Le applicazioni degli AI pet sono molteplici e in continua espansione. Nel campo dell’assistenza, i compagni virtuali possono fornire supporto emotivo, compagnia e assistenza pratica alle persone anziane, ai soggetti con disabilità e a coloro che vivono in isolamento. Possono ricordare le scadenze, monitorare la salute, fornire promemoria e avvisare i soccorsi in caso di emergenza. Nella terapia, gli AI pet possono aiutare i bambini con autismo a sviluppare le capacità sociali, ridurre l’ansia e migliorare l’umore. Possono anche essere utilizzati per la riabilitazione fisica e cognitiva, offrendo esercizi interattivi e stimolanti. Nel settore dell’intrattenimento, gli AI pet possono offrire esperienze di gioco coinvolgenti, creare storie interattive e fornire compagnia virtuale. Possono anche essere utilizzati per l’educazione, insegnando ai bambini la cura degli animali, la biologia e l’ecologia.

Questione di etica: implicazioni e responsabilità

L’introduzione degli animali domestici virtuali solleva una serie di questioni etiche che richiedono un’attenta analisi e una riflessione approfondita. La capacità di creare entità artificiali capaci di simulare emozioni e interazioni sociali solleva interrogativi sulla natura della compagnia, sull’autenticità delle relazioni e sul potenziale impatto sulla società.

Una delle principali preoccupazioni riguarda la possibilità che gli AI pet vengano utilizzati per ingannare o manipolare le persone vulnerabili, come gli anziani con demenza o i bambini con problemi emotivi. Offrire un robot come sostituto di un animale domestico reale può essere considerato un atto di sfruttamento, che nega alle persone la possibilità di sperimentare un legame autentico e significativo. È fondamentale garantire che l’utilizzo degli AI pet sia guidato da principi di trasparenza, onestà e rispetto per la dignità umana.

Un’altra questione etica riguarda il potenziale impatto degli AI pet sul benessere degli animali reali. Se gli animali domestici virtuali diventano sempre più popolari, c’è il rischio che le persone siano meno propense ad adottare animali veri, contribuendo all’abbandono e alla sofferenza degli animali che vivono nei rifugi. È importante promuovere la consapevolezza sui benefici della relazione uomo-animale e incoraggiare l’adozione responsabile degli animali domestici.

La creazione di AI pet “senzienti” o “consapevoli” solleva ulteriori interrogativi etici. Se un’entità artificiale è in grado di provare emozioni, avere desideri e soffrire, ha diritto a una vita dignitosa e alla protezione contro lo sfruttamento e l’abuso? È necessario definire i diritti e le responsabilità degli AI pet, garantendo che siano trattati con rispetto e compassione.

La diffusione degli AI pet potrebbe avere conseguenze inattese sulla società, alterando le dinamiche sociali, le relazioni interpersonali e la percezione della realtà. È importante monitorare attentamente gli effetti degli AI pet sulla società e adottare misure preventive per mitigare i rischi e massimizzare i benefici. È necessario promuovere un dibattito pubblico aperto e inclusivo, coinvolgendo esperti di diverse discipline, per affrontare le questioni etiche connesse agli AI pet e definire un quadro normativo adeguato.

Verso un futuro responsabile: innovazione e umanità

Il futuro degli animali domestici virtuali dipende dalla nostra capacità di bilanciare l’innovazione tecnologica con i valori etici e umanitari. Dobbiamo sfruttare il potenziale degli AI pet per migliorare la vita delle persone, promuovendo al contempo il rispetto per la dignità umana e animale, l’autenticità delle relazioni e la sostenibilità sociale.

È fondamentale investire nella ricerca e nello sviluppo di AI pet che siano sicuri, affidabili ed eticamente responsabili. Dobbiamo garantire che gli AI pet siano progettati per promuovere il benessere degli utenti, rispettare la loro privacy e proteggerli da potenziali danni. È importante sviluppare standard di qualità elevati per gli AI pet, verificando che siano conformi alle normative sulla sicurezza, la protezione dei dati e l’etica.

È necessario promuovere l’educazione e la consapevolezza sull’utilizzo responsabile degli AI pet. Dobbiamo informare il pubblico sui benefici e i rischi degli AI pet, fornendo indicazioni chiare e trasparenti sul loro funzionamento, le loro capacità e i loro limiti. È importante incoraggiare un approccio critico e riflessivo all’utilizzo degli AI pet, promuovendo la consapevolezza sui potenziali effetti sulla salute mentale, le relazioni sociali e la percezione della realtà.

È necessario promuovere la collaborazione tra sviluppatori, ricercatori, esperti di etica, responsabili politici e membri del pubblico per definire un futuro responsabile per gli AI pet. Dobbiamo creare un forum aperto e inclusivo per discutere le questioni etiche, condividere le migliori pratiche e sviluppare linee guida per lo sviluppo e l’utilizzo degli AI pet. È importante coinvolgere tutti gli stakeholder nel processo decisionale, garantendo che le decisioni siano guidate da principi di trasparenza, responsabilità e partecipazione pubblica.

La sfida che ci attende è quella di integrare gli AI pet nella nostra società in modo armonioso e sostenibile, sfruttando il loro potenziale per migliorare la vita delle persone, senza compromettere i valori fondamentali che ci definiscono come esseri umani. Dobbiamo essere consapevoli dei rischi e delle opportunità che derivano da questa nuova tecnologia, agendo con prudenza, responsabilità e lungimiranza per costruire un futuro in cui l’innovazione e l’umanità vadano di pari passo.

Riflessioni conclusive: L’empatia artificiale e il futuro delle relazioni

Nel cuore di questa rivoluzione tecnologica, si cela una domanda fondamentale: cosa significa veramente “compagnia” nell’era dell’intelligenza artificiale? Gli AI pet, con la loro capacità di simulare emozioni e interazioni sociali, ci spingono a riflettere sulla natura dell’empatia, sull’autenticità delle relazioni e sul ruolo degli animali (veri o virtuali) nelle nostre vite.

È cruciale comprendere che gli AI pet non sono (e probabilmente non saranno mai) in grado di sostituire completamente la compagnia umana o animale. Possono offrire conforto, supporto e stimolazione, ma non possono replicare la complessità, la profondità e la reciprocità di un legame emotivo autentico. La vera compagnia implica la condivisione di esperienze, la comprensione reciproca, il sostegno incondizionato e la capacità di superare insieme le sfide della vita.

Tuttavia, gli AI pet possono svolgere un ruolo prezioso nel colmare lacune, alleviare la solitudine e migliorare la qualità della vita di persone che, per diverse ragioni, non possono avere accesso a una compagnia tradizionale. Possono offrire un’alternativa valida per gli anziani soli, i soggetti con disabilità, i bambini con problemi emotivi e tutti coloro che cercano una forma di interazione sociale accessibile e personalizzabile.

La chiave per un futuro responsabile degli AI pet risiede nella nostra capacità di utilizzare questa tecnologia con saggezza, consapevolezza e rispetto. Dobbiamo evitare di cadere nella trappola di considerare gli AI pet come semplici sostituti della compagnia umana o animale, riconoscendo invece il loro valore come strumenti complementari che possono arricchire le nostre vite e migliorare il nostro benessere.

In fondo, l’intelligenza artificiale è solo uno strumento. Sta a noi decidere come utilizzarlo, con quali finalità e con quali conseguenze. Sfruttando il potenziale degli AI pet per promuovere l’empatia, la compassione e la connessione sociale, possiamo costruire un futuro in cui la tecnologia sia al servizio dell’umanità, e non viceversa.

Se ti sei appassionato a questo articolo e ti incuriosisce il mondo dell’intelligenza artificiale, vorrei condividere con te due concetti fondamentali che sono alla base del funzionamento degli AI pet.

Il primo è il machine learning, un approccio che consente alle macchine di apprendere dai dati senza essere esplicitamente programmate. Nel caso degli AI pet, il machine learning permette loro di riconoscere le emozioni umane, adattarsi alle preferenze degli utenti e migliorare le loro interazioni nel tempo.

Il secondo concetto, più avanzato, è il reinforcement learning, una tecnica in cui un agente (in questo caso, l’AI pet) impara a prendere decisioni in un ambiente per massimizzare una ricompensa. Attraverso il reinforcement learning, gli AI pet possono apprendere comportamenti desiderabili, come rispondere ai comandi vocali o fornire supporto emotivo, ricevendo un feedback positivo quando si comportano in modo appropriato.

Questi concetti, sebbene complessi, ci aiutano a comprendere come l’intelligenza artificiale sta trasformando il nostro mondo e aprendo nuove possibilità per l’interazione uomo-macchina. Ti invito a esplorare ulteriormente questi argomenti, lasciandoti guidare dalla curiosità e dalla passione per la scoperta. E chissà, magari un giorno sarai tu a contribuire a plasmare il futuro dell’intelligenza artificiale!