Bias Algoritmici: la Prossima Sfida dell’Intelligenza Artificiale?

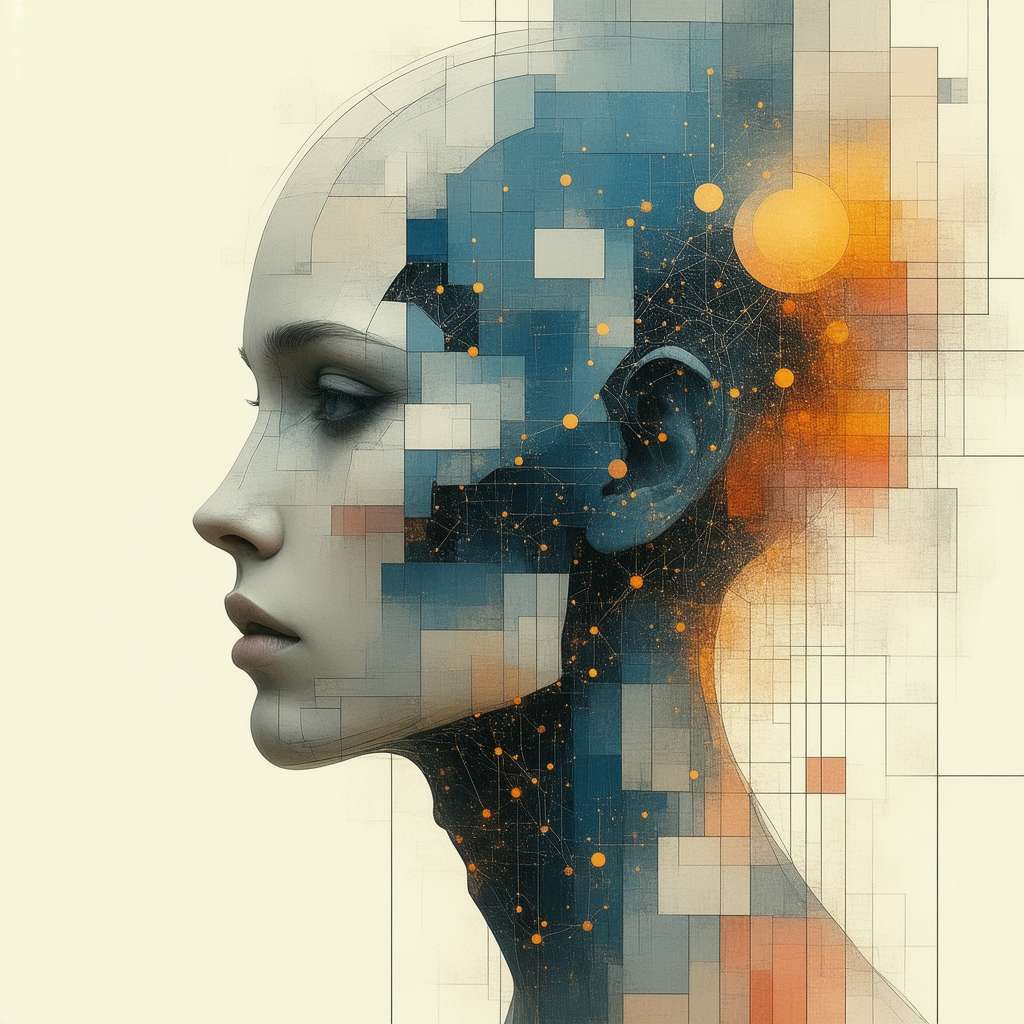

Nel panorama tecnologico del 2025, l’intelligenza artificiale (IA) si configura come un motore di trasformazione senza precedenti, promettendo di rivoluzionare settori nevralgici della nostra società, dalla giustizia penale all’assistenza sanitaria, fino all’istruzione. Tuttavia, questa avanzata porta con sé una zona d’ombra: i bias algoritmici. Questi pregiudizi, spesso celati e non intenzionali, insiti negli algoritmi di IA, rischiano di perpetuare discriminazioni e ingiustizie nei confronti di specifici gruppi sociali, minando i principi cardine di equità e pari opportunità su cui si fonda il nostro vivere civile.

L’ombra silente delle decisioni algoritmiche

Pensiamo a uno scenario in cui ci troviamo davanti a un sistema concepito per misurare il rischio di recidiva nell’ambito della giustizia penale. Se questo sistema utilizza dati provenienti da fonti viziate diventa problematico poiché penalizza ingiustamente alcuni gruppi etnici. Prendiamo ad esempio una situazione analoga nel campo medico: qui potremmo imbatterci in algoritmi progettati con campioni poco rappresentativi della popolazione reale; tale approccio porta spesso alla produzione di risultati inaccurati specialmente nei casi delle donne o degli individui con origini diverse. Tali situazioni sono ben lontane dal rimanere teorie astratte; esse evidenziano sfide tangibili già documentate riguardanti i bias presenti nei sistemi algoritmici. Nello specifico contesto statunitense emerge l’esempio significativo legato all’algoritmo sanitario che impiega i costi sanitari come parametri decisionali relativamente alle necessità dei pazienti: tale strategia finisce col penalizzare i pazienti neri offrendo loro minori prestazioni sanitarie dovute alle storiche disparità esistenti all’interno del sistema sanitario statunitense.

Tali distorsioni involontarie negli algoritmi producono inevitabilmente una frammentazione dell’accesso alle cure necessarie, e contribuendo al mantenimento non solo delle disuguaglianze ma anche

di vere e proprie ingiustizie sociali.

La genesi dei bias in questione si configura come un fenomeno complesso e multifattoriale. Per prima cosa, le fonti dati impiegate nell’addestramento degli algoritmi frequentemente rispecchiano i pregiudizi radicati all’interno della società. Quando un algoritmo si basa su set informativi dove le arrestazioni legate a determinati crimini coinvolgono in modo sproporzionato individui appartenenti a minoranze etniche, c’è un alto rischio che lo stesso algoritmo impari ad ereditare e persino ad accrescere tale disuguaglianza. Inoltre, le decisioni operative intraprese dagli ingegneri durante la progettazione degli algoritmi possono subire l’influenza inconscia delle loro convinzioni personali. L’insufficienza della diversità nei gruppi che si dedicano allo sviluppo dell’intelligenza artificiale non fa altro che esacerbare questa problematica; così facendo si giunge a concepire soluzioni poco attente alle necessità e ai punti di vista differenti provenienti dalla vasta gamma demografica della popolazione globale. Un esempio significativo in tal senso riguarda il funzionamento dei sistemi dedicati al riconoscimento facciale: questi strumenti tendono spesso ad avere performance inferiori nel riconoscere il viso delle persone con pelle scura, poiché principalmente formati su database contenenti fotografie prevalentemente attribuibili a individui di etnia caucasica.

La differenza nell’accuratezza dei sistemi può generare ripercussioni considerevoli in svariati ambiti, quali il controllo degli accessi ai luoghi pubblici o privati, la sorveglianza, nonché nelle attività delle forze dell’ordine.

I bias insiti negli algoritmi hanno effetti estremamente dannosi sulle persone coinvolte. Decisioni preconfezionate tramite programmi informatici distorti rischiano infatti non solo di escludere da opportunità professionali, ma anche di limitare gravemente l’accesso a servizi medici indispensabili e di intaccare potenzialmente i risultati nei procedimenti legali. Purtroppo queste ingiustizie vengono frequentemente occultate dalla complessità intrinseca agli algoritmi stessi e dall’opacità con cui operano i sistemi d’intelligenza artificiale. Determinare chi debba rispondere per tali problematiche è estremamente difficile: tra produttori software, fornitori d’informazioni e le stesse istituzioni che utilizzano le tecnologie basate sugli algoritmi risulta spesso impossibile imputarne un’unica responsabilità.

Pensiamo al settore lavorativo, dove gli strumenti algoritmici impiegati nella selezione dei candidati potrebbero danneggiare le candidate donne se addestrati su dataset storici contenenti una netta prevalenza maschile per determinate posizioni lavorative. Nel contesto della finanza, si osserva come gli algoritmi destinati alla valutazione del rischio creditizio possano ostacolare l’accesso ai prestiti per individui appartenenti a specifiche minoranze etniche, contribuendo così alla perpetuazione di disuguaglianze economiche consolidate. Analogamente, nel campo dell’assicurazione, tali algoritmi impiegati per determinare il costo dei premi possono escludere certe categorie di persone basandosi sul loro codice postale o sullo stato della loro salute, facendo leva su correlazioni statistiche che rivelano e amplificano le già presenti disuguaglianze sociali. Questi casi mettono in luce chiaramente come i pregiudizi insiti negli algoritmi abbiano effetti tangibili e deleteri sulla vita quotidiana degli individui, restringendo le opportunità disponibili e rinforzando pratiche discriminatorie.

Strategie legali e la responsabilità condivisa

Contrastare le decisioni algoritmiche discriminatorie è una sfida complessa, ma non insormontabile. Tra le strategie legali percorribili, vi sono:

- Dimostrare la discriminazione: Presentare evidenze statistiche che dimostrino come l’algoritmo abbia un impatto sproporzionato su un determinato gruppo protetto dalla legge.

- Richiedere trasparenza: Sollecitare l’accesso al codice sorgente e ai dati di addestramento dell’algoritmo, al fine di identificare potenziali fonti di bias.

- Agire per negligenza: Argomentare che i progettisti e gli sviluppatori dell’algoritmo non hanno adottato misure ragionevoli per prevenire la discriminazione.

Un caso emblematico in Italia è rappresentato dall’ordinanza del 2020 del Tribunale di Bologna, che ha accolto il ricorso di alcune associazioni sindacali contro una società di food delivery. Il tribunale ha ritenuto discriminatorio il sistema di gestione delle prenotazioni dei turni dei riders*, basato sull’algoritmo “Frank”, poiché penalizzava indistintamente sia i *riders che non avevano partecipato al turno per negligenza, sia quelli che non avevano potuto presenziare a causa dell’esercizio del diritto di sciopero.

Il pronunciamento legale rappresenta un fondamentale punto di riferimento nella battaglia contro le discriminazioni insite negli algoritmi applicati al settore lavorativo.

Nondimeno, come richiamato da autorità rinomate nel panorama della protezione dei dati personali, risulta imprescindibile intervenire in fase preliminare, rivisitando le policies aziendali che normano l’uso delle piattaforme; tali disposizioni presentano spesso valutazioni capaci di alimentare discriminazioni. I doveri nel contrasto ai pregiudizi algoritmici sono ripartiti tra vari soggetti: dagli sviluppatori di intelligenza artificiale ai fornitori delle informazioni necessarie per il suo funzionamento; dalle imprese che adottano queste tecnologie ai legislatori e alla comunità sociale. È solo mediante un approccio integrato e cooperativo che riusciremo ad affrontare con successo questa problematica complessa.

L’Artificial intelligence act: una risposta europea?

In risposta alla rilevanza crescente dell’intelligenza artificiale, nonché ai suoi annessi rischi d’uso, l’Unione Europea ha attuato il proprio Artificial Intelligence Act, un provvedimento legislativo dettagliato concepito per regolare tanto lo sviluppo quanto il rilascio dell’IA nell’ambito europeo. Questo atto si fonda su una metodologia imperniata sul concetto di rischio; pertanto classifica gli strumenti basati su IA nelle varie categorie secondo il grado del rischio connesso al loro impiego. Gli strumenti giudicati come aventi un livello elevato d’impatto – inclusi quelli utilizzabili nei campi della giustizia legale così come nella sanità e nell’ambito educativo – devono osservare obblighi normativi molto severi miranti alla garanzia della sicurezza degli utenti oltre alla trasparenza operativa e all’eliminazione delle discriminazioni.

Diverse misure sono incorporate nel suddetto AI Act; tra queste spicca il divieto assoluto riguardo alla messa in commercio dei sistemi classificabili come assolutamente indegni – tale categoria include quelle tecnologie capaci non solo di influenzare le scelte individuali ma anche facilitare meccanismi di sorveglianza collettiva. Parallelamente è richiesto a coloro che progettano soluzioni basate sull’intelligenza artificiale ad alta criticità di eseguire analisi preliminari sugli effetti sui diritti civili necessari per localizzare e attenuare gli eventuali dannosi effetti sulle libertà pubbliche.

L’articolo 13 dell’AI Act sancisce il principio della “trasparenza adeguata”, imponendo ai fornitori di sistemi di IA ad alto rischio di fornire informazioni chiare e comprensibili sulle caratteristiche, le capacità e i limiti del sistema, al fine di consentire agli utenti di prendere decisioni informate.

Nonostante rappresenti un passo avanti significativo nella regolamentazione dell’IA, l’AI Act è stato oggetto di alcune critiche. Alcuni esperti sostengono che la normativa si limiti a definire principi generali, senza fornire strumenti specifici per contrastare efficacemente la discriminazione algoritmica. Inoltre, l’AI Act non fa esplicito riferimento alle direttive europee in materia di diritto antidiscriminatorio, sollevando interrogativi sulla sua capacità di affrontare in modo esaustivo il problema dei bias algoritmici. Sarà fondamentale monitorare attentamente l’attuazione dell’AI Act e valutare la sua efficacia nel garantire un’IA etica, responsabile e inclusiva.

La legislazione italiana si discosta nettamente rispetto ad altre nazioni europee in quanto non presenta attualmente una regolamentazione sistematica sulle decisioni automatizzate. In tale ambito, la giurisprudenza svolge un ruolo imprescindibile nel cercare di riempire vuoti normativi e nell’offrire un’interpretazione rigorosa dei principi generali del diritto che rispetti le caratteristiche distintive dei sistemi di intelligenza artificiale. Le deliberazioni emesse dalle corti italiane riflettono i valori fissati sia a livello nazionale che sovranazionale e sanciscono il diritto degli individui ad essere informati sulla logica presente nelle pratiche decisionali automatizzate. Nonostante ciò, rimangono sfide considerevoli dovute alla complessità degli algoritmi utilizzati e alle difficoltà intrinseche nel garantire una reale trasparenza senza ledere la tutela dei segreti aziendali.

Un futuro consapevole: etica, ricerca e impegno civile

L’affrontamento della complessa problematica rappresentata dai bias negli algoritmi necessita di una serie articolata d’interventi mirati su molteplici aspetti. Prima fra tutte, l’urgenza di sviluppare standard etici stringenti in relazione alla creazione e all’attuazione dei sistemi d’intelligenza artificiale; questo approccio dev’essere ancorato a principi quali l’‘etica’, l’‘accountability’, nonché a metodologie chiare permettendo trasparenza nel funzionamento degli stessi strumenti tecnologici utilizzati. Sarà quindi indispensabile istituire procedure adeguate tese ad eseguire audits sistematicamente ai fini dell’individuazione precoce delle anomalie cognitive presenti nei modelli utilizzati — un passo cruciale affinché si eviti il verificarsi di eventuali dannosi impatti collaterali.

Risulta altresì prioritario canalizzare risorse significative verso lo studio approfondito delle strategie attuabili con l’obiettivo primario della riduzione significativa dei pregiudizi intrinseci sia nei dataset utilizzati sia negli stessi codici sorgente degli algoritmi costituenti tali sistemi intelligenti.

- Soprattutto da considerarsi essenziale il principio della varietà compositiva:

- nel contesto operativo occorre nutrirsi del contributo proveniente da diverse esperienze socio-culturali affinché questi software risultino davvero inclusivi, ascoltando ogni voce rilevante presente nel tessuto sociale quotidiano;

- D’altro canto, attivarsi verso misure legali protettive diventa altrettanto fondamentale; riconoscere dignità giuridica alle segnalazioni effettuate dagli individui in virtù del determinarsi conseguenze svantaggiose derivanti da scelte operate mediante processi decisionali automatizzati.

A tal fine è imperativo facilitare meccanismi concreti attraverso cui questi soggetti possano far valere i propri diritti».

Si rende necessaria l’implementazione di meccanismi di ricorso che siano accessibili a tutti, insieme alla preparazione adeguata per giudici e avvocati riguardo alle peculiari dinamiche dei bias insiti negli algoritmi. In tale contesto, risulta imperativo sensibilizzare il pubblico rispetto ai rischi connessi ai bias degli algoritmi; questo passaggio è essenziale non solo per incentivare discussioni illuminate ma anche per promuovere una gestione responsabile dell’intelligenza artificiale. È quindi prioritario fornire ai cittadini gli strumenti necessari per comprendere il funzionamento degli algoritmi ed analizzare i possibili effetti su diverse sfere della propria esistenza; ciò permetterebbe loro di adottare decisioni consapevoli in merito all’impiego delle tecnologie AI.

Nell’opinione della co-fondatrice dell’European Research Council Helga Nowotny, diventa imprescindibile stabilire criteri condivisi su cosa sia socialmente accettabile oltre a definizioni legali appropriate; in mancanza ci si espone al rischio concreto di una gestione disordinata delle nuove tecnologie. La complessità della questione legata ai bias degli algoritmi esige una collaborazione tra discipline diverse: specialisti in informatica affiancati da giuristi, sociologi ed eticisti oltre a membri attivi della società civile saranno fondamentali nel fronteggiare questa sfida. La chiave per assicurare che l’IA diventi un autentico veicolo di progresso per la società è racchiusa nella necessità di un sforzo collettivo. Solo così potremo evitare che essa si trasformi in una causa di disparità crescenti.

Oltre l’algoritmo: la responsabilità umana

L’era dell’intelligenza artificiale, pur promettendo efficienza e innovazione, ci pone di fronte a interrogativi etici fondamentali. La questione dei bias algoritmici non è semplicemente un problema tecnico da risolvere con correzioni al codice o con set di dati più ampi e diversificati. È, piuttosto, un sintomo di una problematica più profonda, radicata nei pregiudizi e nelle disuguaglianze che pervadono la nostra società. Gli algoritmi, in fondo, sono solo specchi che riflettono la realtà che li circonda, amplificandone sia le virtù che i vizi. Pertanto, la vera sfida non è solo quella di “ripulire” gli algoritmi dai bias, ma di affrontare le cause profonde di tali pregiudizi nella nostra società. Ciò richiede un impegno costante per la promozione dell’equità, della diversità e dell’inclusione in tutti gli ambiti della vita sociale, dall’istruzione al mondo del lavoro, fino alla politica.

In questo contesto, la responsabilità umana assume un’importanza cruciale. È imperativo che gli attori principali nel settore dell’Intelligenza Artificiale — inclusi sviluppatori, fornitori di dati, aziende che implementano tali sistemi oltre ai legislatori — abbiano piena consapevolezza del significativo potere nelle loro mani nonché delle ripercussioni insite nelle loro scelte decisionali. Deve esserci un impulso verso l’adozione culturale della responsabilità, dove tutti coloro che partecipano allo sviluppo o all’applicazione dell’IA sentono la necessità inderogabile di rispondere delle proprie azioni garantendo una pratica etica nei processi coinvolti. All’interno di questo contesto, la questione della trasparenza emerge come fondamentale: è vitale che gli algoritmi siano progettati in modo tale da risultare chiari al pubblico per poter monitorarne il funzionamento ed evidenziare eventuali pregiudizi insiti nei medesimi modelli decisionali. Inoltre, deve esistere un sistema definito atto a delineare con precisione la accountability, ovvero criteri inequivocabili per chiarire chi sia ritenuto responsabile qualora si dovessero verificare effetti negativi derivanti da scelte basate su informazioni algoritmiche errate o fuorvianti. Infine, va considerata con urgenza anche la dimensione relativa alla protezione dei dati personali; i set informativi utilizzati nella fase formativa degli algoritmi devono essere raccolti in conformità alle norme vigenti – rendendosi trasparentemente visibili nel processo – affinché possa garantirsi anche qui il rispetto della privacy individuale.

A questo punto è fondamentale considerare come i bias degli algoritmi rappresentino una questione cruciale riguardante l’impatto dell’intelligenza artificiale sulla nostra collettività e sulla direzione futura che intendiamo intraprendere. Desideriamo vivere in una realtà dove l’IA diventa veicolo delle attuali differenze sociali, oppure preferiremmo perseguire una strada in cui essa possa divenire uno strumento comune per il progressivo avanzamento collettivo? Il successo nell’affrontare questo dilemma spetta solo a noi stessi; sta nel nostro impegno volto ad approcciare la problematica legata ai bias con piena sensibilità sociale, serietà morale ed anche coscienza civica.

Cari amici, proviamo ad analizzare più attentamente il tema qui trattato. Un algoritmo può essere definito come una serie strutturata di istruzioni elaborate da un computer al fine di risolvere determinati quesiti o compiere specifiche operazioni pratiche. Nell’ambito dell’intelligenza artificiale si avvalgono degli algoritmi per formare i sistemi così da apprendere dai set informativi disponibili e formulare scelte appropriate. Tuttavia, se i suddetti dati sono viziati da discrasie già presenti all’interno della società stessa, non raramente succede che gli algoritmi finiscano col favorire tali discriminazioni infondendo risultati distorti nelle loro elaborazioni finali; ciò rappresenta precisamente il cuore del dibattito sui bias negli strumenti algoritmici.

Un concetto più avanzato, ma cruciale per affrontare il tema dei bias, è quello dell’Explainable AI (XAI). L’XAI si concentra sullo sviluppo di tecniche che rendano i processi decisionali dei sistemi di IA più trasparenti e comprensibili. In altre parole, l’XAI mira a “spiegare” perché un sistema di IA ha preso una determinata decisione, consentendo agli utenti di identificare potenziali fonti di bias e di correggerle. L’XAI rappresenta un campo di ricerca promettente per affrontare la sfida dei bias algoritmici e garantire un’IA più etica e responsabile. Riflettiamoci: in un mondo sempre più governato da algoritmi, la nostra capacità di comprendere e controllare tali algoritmi diventa una questione di giustizia e democrazia.