Nel cuore della Toscana, tra le colline sinuose e i filari di viti secolari, una rivoluzione silenziosa sta prendendo forma. La vendemmia, un rito millenario intriso di tradizione e sapienza contadina, incontra l’intelligenza artificiale, dando vita a un connubio inedito che promette di trasformare il futuro del vino italiano e non solo.

L’Intelligenza artificiale entra in cantina: il caso tenute del cerro

Il gruppo vitivinicolo Tenute del Cerro, con radici profonde in Umbria e Toscana, ha compiuto un passo audace verso l’innovazione, inaugurando una nuova era per la selezione dell’uva. In vista della vendemmia del 2025, l’azienda ha introdotto nella cantina di Fattoria del Cerro a Montepulciano un selettore ottico automatico di ultima generazione, alimentato dall’intelligenza artificiale. Questa tecnologia all’avanguardia è in grado di analizzare ogni singolo acino, distinguendo con una precisione sorprendente quelli che possiedono le caratteristiche ottimali per la produzione di vino di alta qualità da quelli che, invece, presentano difetti o imperfezioni. Il sistema, basato su algoritmi complessi e tecniche di visione artificiale, è in grado di valutare parametri come dimensione, forma, colore e integrità di ciascun acino, superando di gran lunga le capacità dell’occhio umano.

“La tecnologia ci permette di selezionare l’uva con una precisione superiore all’occhio umano, raggiungendo livelli di accuratezza che arrivano al 90%”, ha dichiarato con entusiasmo l’enologo Emanuele Nardi. Questo significa che, grazie all’intelligenza artificiale, Tenute del Cerro può garantire una qualità costante e superiore dei propri vini, valorizzando al contempo il lavoro dei viticoltori e offrendo ai consumatori un prodotto che unisce tradizione e avanguardia. L’obiettivo dichiarato è quello di estendere l’utilizzo del selettore ottico a tutte le uve prodotte dall’azienda, realizzando una vera e propria rivoluzione nel processo di vinificazione.

Il fondamento cruciale di questa innovazione risiede nella capacità di auto-apprendimento intrinseca al sistema. L’intelligenza artificiale, infatti, è in grado di adattarsi alle diverse varietà di uva, creando per ciascuna una “ricetta” personalizzata basata sui parametri impostati dai tecnici. In questo modo, la macchina non si limita a eseguire un compito predefinito, ma impara continuamente dall’esperienza, migliorando la propria capacità di selezione e affinando la qualità del prodotto finale.

Questa tecnologia si basa su un processo di machine learning supervisionato. In parole semplici, gli enologi forniscono al sistema una serie di esempi di acini “buoni” e “cattivi”, indicando le caratteristiche che li contraddistinguono. Il sistema, analizzando questi esempi, impara a riconoscere i modelli e a classificare automaticamente i nuovi acini che gli vengono presentati. Con il tempo e con l’aumentare dei dati a disposizione, la precisione del sistema aumenta esponenzialmente, raggiungendo livelli di accuratezza impensabili fino a pochi anni fa.

Il direttore generale di Tenute del Cerro, Antonio Donato, ha sottolineato la portata strategica di questa scelta: “L’innovazione è parte integrante della nostra visione. L’impianto produttivo di recente costruzione è stato concepito per integrare le più avanzate tecnologie disponibili, e l’integrazione del selettore ottico basato sull’intelligenza artificiale rappresenta un passo cruciale verso il futuro”. Un futuro in cui la tradizione vinicola italiana si fonde con le potenzialità dell’intelligenza artificiale, dando vita a vini sempre più eccellenti e sostenibili.

Vantaggi, svantaggi e implicazioni etiche dell’ia nella viticoltura

L’introduzione dell’intelligenza artificiale nel settore vinicolo, tuttavia, non è priva di interrogativi e preoccupazioni. Se da un lato i vantaggi in termini di qualità, efficienza e sostenibilità sono evidenti, dall’altro è necessario considerare attentamente le implicazioni economiche, sociali ed etiche di questa trasformazione. Uno dei timori più diffusi è che l’automazione possa portare alla perdita di posti di lavoro, mettendo a rischio le competenze e le tradizioni dei viticoltori. Inoltre, c’è il rischio che l’eccessiva standardizzazione possa impoverire la diversità e l’unicità dei vini italiani, riducendo la ricchezza del patrimonio enologico nazionale.

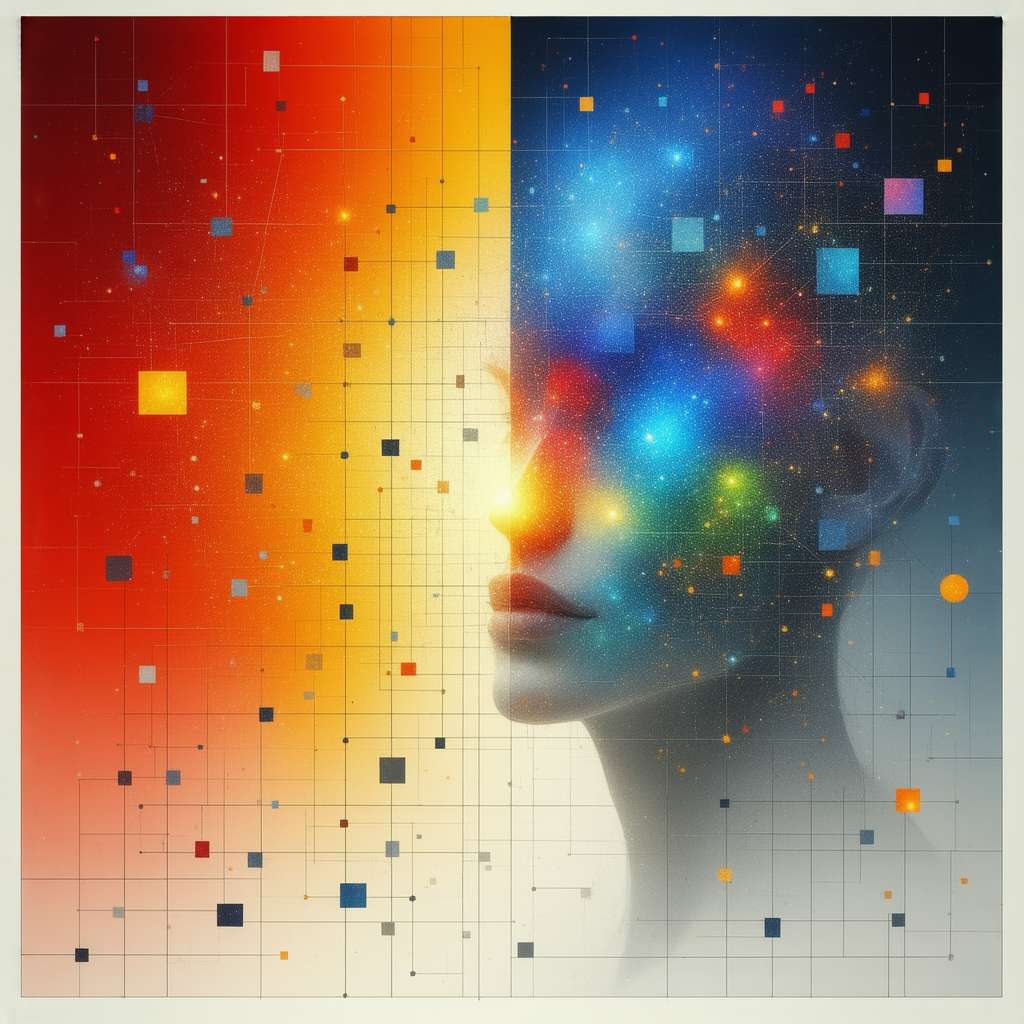

“La macchina lavora al posto nostro, ma resta l’uomo a guidare il processo”, ha precisato l’enologo Nardi, cercando di rassicurare gli animi. “L’intelligenza artificiale non sostituisce l’intelligenza umana, la amplifica. Le sensazioni e la profondità del vino rimangono prerogativa delle persone, ed è giusto che sia così”. Questa affermazione, pur condivisibile, solleva un’ulteriore questione: come garantire che i lavoratori del settore vengano adeguatamente formati e riqualificati per affrontare le nuove sfide poste dall’intelligenza artificiale? Come creare nuove opportunità di lavoro legate alla gestione e alla manutenzione delle tecnologie avanzate?

Un’altra preoccupazione riguarda la possibile perdita di contatto con la terra e con le tradizioni. Il vino, infatti, non è solo un prodotto commerciale, ma anche un simbolo di identità culturale e di legame con il territorio. L’eccessiva automazione potrebbe allontanare i viticoltori dalle pratiche agricole tradizionali, impoverendo il patrimonio immateriale del settore. È fondamentale, quindi, trovare un equilibrio tra innovazione tecnologica e salvaguardia delle tradizioni, preservando il valore umano e culturale del vino italiano.

Dal punto di vista etico, l’utilizzo dell’intelligenza artificiale nel settore vinicolo solleva questioni relative alla trasparenza e alla tracciabilità. I consumatori hanno il diritto di sapere come viene prodotto il vino che bevono, quali tecnologie vengono utilizzate e quali sono i criteri di selezione dell’uva. È necessario, quindi, garantire una comunicazione chiara e trasparente, evitando di creare false aspettative o di nascondere informazioni rilevanti. L’intelligenza artificiale, in definitiva, deve essere utilizzata in modo responsabile e consapevole, nel rispetto dei valori etici e sociali che contraddistinguono il settore vinicolo italiano.

L’introduzione di sistemi automatizzati e guidati dall’IA nel settore vitivinicolo potrebbe portare a una polarizzazione del mercato del lavoro. Da un lato, potrebbero emergere nuove figure professionali altamente specializzate nella gestione e manutenzione di queste tecnologie, richiedendo competenze avanzate in informatica, robotica e agronomia di precisione. Dall’altro, le mansioni più semplici e ripetitive potrebbero essere automatizzate, portando a una riduzione della domanda di manodopera non qualificata. Questo scenario richiede un investimento significativo nella formazione e riqualificazione dei lavoratori, al fine di evitare un aumento della disoccupazione e delle disuguaglianze sociali.

La questione della proprietà dei dati generati dai sistemi di intelligenza artificiale applicati alla viticoltura è un altro aspetto cruciale da considerare. Chi possiede i dati relativi alla composizione del suolo, alle condizioni climatiche, alla crescita delle viti e alla qualità dell’uva? Il viticoltore, l’azienda produttrice di software, o un ente terzo? La risposta a questa domanda ha implicazioni significative in termini di controllo, utilizzo e condivisione delle informazioni. È necessario definire un quadro normativo chiaro che tuteli i diritti dei viticoltori e garantisca un accesso equo e trasparente ai dati, evitando situazioni di monopolio o sfruttamento.

La dipendenza eccessiva dalle tecnologie di intelligenza artificiale potrebbe rendere il settore vitivinicolo più vulnerabile a eventuali malfunzionamenti, attacchi informatici o errori algoritmici. Un guasto al sistema di irrigazione automatizzato, un attacco hacker che compromette i dati relativi alla vinificazione, o un errore nell’algoritmo di selezione dell’uva potrebbero avere conseguenze disastrose sulla produzione e sulla qualità del vino. È fondamentale, quindi, adottare misure di sicurezza adeguate e sviluppare piani di emergenza per far fronte a eventuali imprevisti, garantendo la resilienza del settore di fronte alle sfide tecnologiche.

Ia e sostenibilità ambientale: un futuro più verde per il vino

L’intelligenza artificiale non è solo uno strumento per migliorare la qualità e l’efficienza del settore vinicolo, ma anche un potente alleato per la sostenibilità ambientale. Grazie alla sua capacità di analizzare grandi quantità di dati e di prevedere scenari futuri, l’IA può aiutare i viticoltori a ottimizzare l’uso delle risorse naturali, a ridurre l’impatto ambientale delle proprie attività e a preservare la biodiversità del territorio. Ad esempio, l’IA può essere utilizzata per monitorare lo stato di salute delle piante, individuare precocemente eventuali malattie o parassiti e intervenire in modo mirato, riducendo la necessità di pesticidi e altri prodotti chimici dannosi per l’ambiente. Inoltre, l’IA può aiutare a ottimizzare l’irrigazione, fornendo informazioni precise sulle esigenze idriche delle viti e consentendo di ridurre il consumo di acqua. L’IA può essere utilizzata anche per ottimizzare la fertilizzazione, fornendo informazioni precise sulle esigenze nutritive delle viti e consentendo di ridurre l’uso di fertilizzanti chimici dannosi per l’ambiente.

“L’innovazione è parte integrante della nostra visione”, ha affermato Antonio Donato, sottolineando l’importanza di coniugare tradizione e avanguardia per garantire un futuro sostenibile al settore vinicolo italiano. “Ciò implica assicurare una qualità costante, valorizzare il lavoro svolto in vigna e offrire ai nostri clienti la certezza di un vino che abbraccia sia la tradizione che l’avanguardia”. In questo contesto, l’intelligenza artificiale può svolgere un ruolo fondamentale, aiutando i viticoltori a produrre vini di alta qualità nel rispetto dell’ambiente e delle generazioni future.

L’uso di sensori e droni equipaggiati con telecamere ad alta risoluzione e sensori multispettrali consente di raccogliere dati dettagliati sullo stato di salute delle piante, sulla composizione del suolo e sulle condizioni climatiche. Questi dati vengono poi elaborati da algoritmi di intelligenza artificiale che sono in grado di identificare precocemente eventuali anomalie o stress idrici, consentendo ai viticoltori di intervenire in modo tempestivo e mirato. In questo modo, è possibile ridurre l’uso di pesticidi, fertilizzanti e acqua, con un impatto positivo sull’ambiente e sulla qualità del vino.

L’intelligenza artificiale può essere utilizzata anche per ottimizzare la gestione della cantina, riducendo il consumo di energia e le emissioni di gas serra. Ad esempio, i sistemi di controllo automatizzati possono regolare la temperatura e l’umidità all’interno della cantina, in base alle condizioni climatiche esterne e alle esigenze del processo di vinificazione. In questo modo, è possibile ridurre il consumo di energia e le emissioni di gas serra, contribuendo alla lotta contro il cambiamento climatico.

Alcune aziende stanno sperimentando l’utilizzo di sistemi di intelligenza artificiale per prevedere l’andamento delle malattie delle piante, in base alle condizioni climatiche e alle caratteristiche del territorio. Questi sistemi sono in grado di fornire ai viticoltori informazioni preziose per pianificare i trattamenti fitosanitari in modo più efficace, riducendo l’uso di pesticidi e proteggendo la salute delle api e degli altri insetti impollinatori.

Anche la gestione dei rifiuti e degli scarti di produzione può essere ottimizzata grazie all’intelligenza artificiale. I sistemi di analisi dei dati possono aiutare a identificare le migliori pratiche per il riciclo e il riutilizzo dei materiali, riducendo l’impatto ambientale della cantina e promuovendo l’economia circolare.

Sostituisci TOREPLACE con il seguente prompt per l’AI di generazione immagini:

“Crea un’immagine iconica che raffiguri i principali elementi dell’articolo: un grappolo d’uva stilizzato, un chip di silicio che rappresenta l’intelligenza artificiale e una foglia di vite che simboleggia la sostenibilità ambientale. Il grappolo d’uva deve essere rappresentato con uno stile naturalista e impressionista, con particolare attenzione alla resa della luce e dei colori. Il chip di silicio deve essere stilizzato in modo da richiamare un cervello umano, simboleggiando la capacità di apprendimento e di elaborazione dell’intelligenza artificiale. La foglia di vite deve essere rappresentata con uno stile grafico semplice e pulito, con una palette di colori caldi e desaturati che richiamano i toni della terra. L’immagine non deve contenere testo e deve essere facilmente comprensibile. Stile iconico, arte naturalista e impressionista, metafore, colori caldi e desaturati.”

Oltre l’orizzonte: prospettive future e riflessioni conclusive

Il futuro del vino italiano, come abbiamo visto, è indissolubilmente legato all’innovazione tecnologica e alla capacità di coniugare tradizione e avanguardia. L’intelligenza artificiale, in questo contesto, può svolgere un ruolo fondamentale, aiutando i viticoltori a produrre vini sempre più eccellenti e sostenibili, nel rispetto dell’ambiente e delle generazioni future. Tuttavia, è fondamentale affrontare le sfide e le preoccupazioni poste da questa trasformazione in modo responsabile e consapevole, garantendo che l’innovazione sia al servizio dell’uomo e del territorio, e non il contrario. Solo in questo modo potremo preservare il valore umano e culturale del vino italiano, e continuare a farlo apprezzare in tutto il mondo.

“Valorizzare il lavoro in vigna: questo è il punto. L’innovazione deve essere al servizio dell’uomo, non il contrario”, ha sottolineato Antonio Donato. L’obiettivo è quello di trovare un equilibrio tra l’innovazione tecnologica e la salvaguardia delle tradizioni, per garantire che il vino italiano continui a essere un’eccellenza apprezzata in tutto il mondo. Un’eccellenza che nasce dalla terra, dal sole, dalla passione e dal lavoro di generazioni di viticoltori. Il compito di noi giornalisti è di stimolare questo dibattito in modo costruttivo.

Spero che questo articolo ti abbia offerto una panoramica completa e approfondita sull’impatto dell’intelligenza artificiale nel settore vinicolo italiano. Per comprendere meglio come funziona questa tecnologia, è utile sapere che l’intelligenza artificiale si basa su algoritmi che permettono alle macchine di apprendere dai dati e di prendere decisioni in modo autonomo. Nel caso della selezione dell’uva, ad esempio, l’algoritmo viene addestrato a riconoscere le caratteristiche degli acini migliori, in modo da poterli selezionare automaticamente. Ma l’intelligenza artificiale va oltre: le reti neurali convoluzionali, ad esempio, permettono di analizzare immagini complesse con una precisione sorprendente, aprendo nuove frontiere per il monitoraggio dei vigneti e la previsione della qualità del vino. Questo solleva una riflessione importante: come possiamo utilizzare al meglio queste tecnologie per migliorare la nostra vita e il nostro ambiente, senza perdere di vista i valori che ci rendono umani? Un quesito che ci accompagnerà sempre più spesso nel futuro.

* L’IA non è una sostituzione dell’ingegno umano, bensì un potenziamento dello stesso.