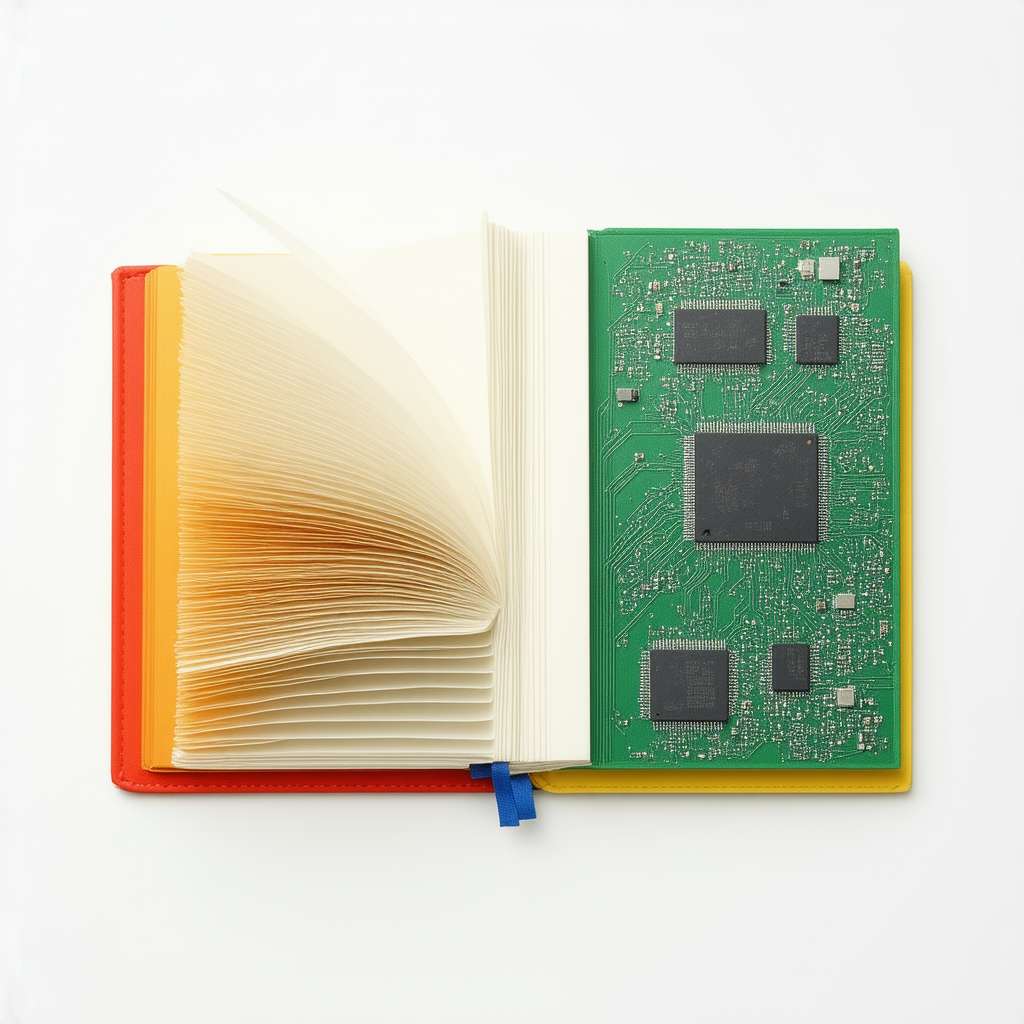

L’Ascesa di NotebookLM: Un Innovativo Modello per l’Istruzione e l’Amministrazione dei Dati

All’interno del dinamico scenario dell’intelligenza artificiale contemporanea emerge una proposta rivoluzionaria capace di impattare significativamente sul nostro approccio alle informazioni: NotebookLM sviluppato da Google. Tale strumento rappresenta un’assistente altamente adattabile concepito per facilitare studenti, ricercatori e professionisti nella manipolazione e nell’analisi massiccia dei dati. Contrariamente alle intelligenze artificiali generiche nel loro utilizzo comune, NotebookLM evidenzia una spiccata abilità nell’agire in ambiti definiti con precisione; offre così analisi dettagliate sui documenti che l’utente decide di immettere.

Il funzionamento di NotebookLM si fonda su Gemini 2.0 Flash Thinking. Questo sofisticato modello impiega la strategia nota come Chain of Thought per assicurarsi che le risposte fornite siano sia precise sia chiare nel loro svolgimento logico. Inoltre, grazie alla sua struttura multimodale è capace non solo di interagire con testi scritti ma anche con contenuti visivi e uditivi quali video o immagini audio; ciò consente funzioni utilissime come trascrizioni testuali automatizzate ed elaborazioni riassuntive oltre a traduzioni multilingue efficaci. Si presenta all’utente l’opportunità di esplorare i file inviati, consentendogli di porre interrogativi mirati, scoprire relazioni tra i diversi dati e ottenere una visione più profonda dei temi discussi.

Funzionalità e Limitazioni: Un’Analisi Dettagliata

Affinché si possano esplorare completamente le capacità offerte da NotebookLM, è imperativo caricare documentazione idonea alla piattaforma. Essa supporta contenuti elaborati tramite Google (inclusi ma non limitati a testi, fogli elettronici ed elaborazioni visive), insieme ai file testuali e alle trascrizioni provenienti da video pubblicamente accessibili su YouTube. L’adeguamento gratuito all’interno dell’ambito NotebookLM comporta restrizioni sull’impiego: il numero massimo ammissibile è fissato a 50 fonti per ciascun notebook; ogni fonte può contenere al massimo fino a 500.000 parole; sono permessi altresì solo 50 quesiti giornalieri attraverso la chat e un limite pari a tre creazioni quotidiane in formato audio. Al contrario, il piano Plus — soggetto al pagamento — amplia tali restrizioni incrementando le caratteristiche disponibili tra cui spicca l’opzione per condividere i notebook mantenendo riservate le sorgenti originali e inoltre l’opportunità d’interrogare mentre si ascoltano delle sintesi sonore.

L’interfaccia utente disponibile su NotebookLM, concepita per essere altamente fruibile, si struttura attorno a tre colonne distinte: Origini, Chat, Studio. Nella sezione intitolata Origini gli utenti possono governare le fonti precaricate decidendo quali includere o escludere dal processo informativo; nel compartimento dedicato alla Chat vengono messi in campo strumenti orientati alla creazione visiva sotto forma di mappe mentali oltre che facilitatori della presa appunti; infine, nel segmento Studio sorge l’opportunità d’ottenere sintetizzatori vocalizzati su misura ad hoc. Un aspetto da evidenziare consiste nel fatto che NotebookLM, pur non potendo essere assimilato a un risolutore simbolico quale Wolfram Alpha, possiede tuttavia la capacità di affrontare equazioni e chiarire principi matematici se accompagnato dalle fonti corrette. È fondamentale esercitare cautela con le traduzioni, specialmente quando si tratta di lingue classiche come il latino e il greco; infatti, i modelli linguistici potrebbero mostrare diverse limitazioni.

NotebookLM su Dispositivi Mobili: Un’Esperienza in Evoluzione

NotebookLM è accessibile anche su piattaforme mobili attraverso applicazioni dedicate per Android e iOS. È importante sottolineare che le versioni attualmente disponibili delle applicazioni presentano una serie di vincoli rispetto alla loro controparte web; tra queste restrizioni vi sono l’impossibilità di generare mappe mentali, una limitata integrazione con i documenti Google e la mancanza della funzionalità audio overview nelle lingue al di fuori dell’inglese. Pur affrontando tali inconvenienti, l’app mobile fornisce un’esperienza utente significativamente ottimizzata, consentendo agli utenti il salvataggio immediato dei contenuti provenienti da altre applicazioni attraverso il sistema operativo Android o iOS. Gli sviluppatori si sono impegnati a potenziare ulteriormente questo strumento nei prossimi aggiornamenti, promettendo così un’app sempre più completa ed efficiente nel prossimo futuro.

Oltre l’Assistenza: Un Nuovo Approccio allo Studio e alla Ricerca

NotebookLM segna una nuova fase nell’ambito degli strumenti dedicati all’apprendimento e alla ricerca accademica. La sua abilità nel sintetizzare, organizzare e analizzare ampie moli d’informazioni lo classifica come un ausilio prezioso per studenti, ricercatori ed esperti professionali intenzionati a migliorare la propria produttività lavorativa. Ciononostante, è cruciale adottare un approccio consapevole e critico nell’impiego di NotebookLM; è essenziale procedere a una verifica costante dell’affidabilità delle informazioni presentate dall’IA affinché queste siano combinate efficacemente con le proprie capacità individuali. L’intelligenza artificiale deve essere considerata come uno strumento complementare al ragionamento umano piuttosto che come suo sostituto; essa offre opportunità inedite per esplorare vari aspetti della conoscenza umana.

Il Futuro dell’Apprendimento: Verso un’Intelligenza Aumentata

L’emergere di strumenti quali NotebookLM invita a riflessioni profonde riguardo al destino dell’apprendimento e della ricerca. Come influenzerà l’intelligenza artificiale la nostra modalità di acquisizione e uso delle informazioni? Quali abilità diventeranno essenziali nell’affrontare una realtà sempre più permeata dalla tecnologia automatizzata? Trovare risposte a tali quesiti implica imparare ad amalgamare l’IA con le nostre facoltà cognitive, creando una forma d’intelligenza aumentata capace di prepararci ad affrontare gli sviluppi futuri attraverso innovazione e accresciuta consapevolezza.

Caro lettore, al fine di afferrare integralmente come opera NotebookLM, si rende necessaria la presentazione del concetto cardine inerente all’intelligenza artificiale: il Natural Language Processing (NLP). Questo settore specifico dell’IA mira a dotare i computer della facoltà necessaria per decifrare, analizzare ed elaborare efficacemente il linguaggio umano. Attraverso la potenza del NLP, NotebookLM è capace non solo di esaminare i documenti forniti dall’utente ma anche di individuare contenuti significativi, rispondendo così alle richieste formulate con precisione e attinenza. Una nozione più sofisticata che può essere applicata nel contesto di NotebookLM è rappresentata dal Transfer Learning. Questa metodologia permette a un modello d’intelligenza artificiale già addestrato su ampie collezioni testuali di lingua naturale di essere riorientato verso compiti peculiari utilizzando set di dati significativamente ridotti. In particolare, per quanto concerne NotebookLM, il sistema Gemini 2.0 Flash Thinking ha completato una fase preliminare d’addestramento impiegando volumi straordinari di testo prima che venisse perfezionato nella sua abilità di comprendere e sintetizzare documenti particolari forniti dagli utenti. Invito alla meditazione: nell’attuale periodo caratterizzato dalla disponibilità infinita di informazioni, si rivela sempre più essenziale la facoltà tanto dell’elaborazione quanto della sintesi dei dati stessi. Gli strumenti come NotebookLM sono capaci di assisterci nella gestione del surplus informativo permettendoci così di indirizzare la nostra attenzione verso ciò che risulta davvero pertinente; tuttavia, resta imprescindibile l’emergenza del pensiero critico associata ad abilità analitiche autonome affinché non si giunga alla condizione passiva degli operatori meccanici degli algoritmi stessi. È imperativo considerare l’intelligenza artificiale quale mezzo volto al supporto umano piuttosto che come semplice surrogato delle nostre facoltà cognitive.