Il panorama della ricerca online sta affrontando una trasformazione radicale, guidata dall’integrazione sempre più profonda dell’intelligenza artificiale. Google, pioniere in questo campo, sta esplorando un modello di ricerca che si discosta significativamente dalla tradizionale lista di link, spostandosi verso risposte dirette e sintetiche generate dall’AI. Questa evoluzione, sebbene promettente in termini di efficienza e immediatezza, solleva interrogativi cruciali sull’affidabilità, la trasparenza e l’impatto sul pluralismo informativo.

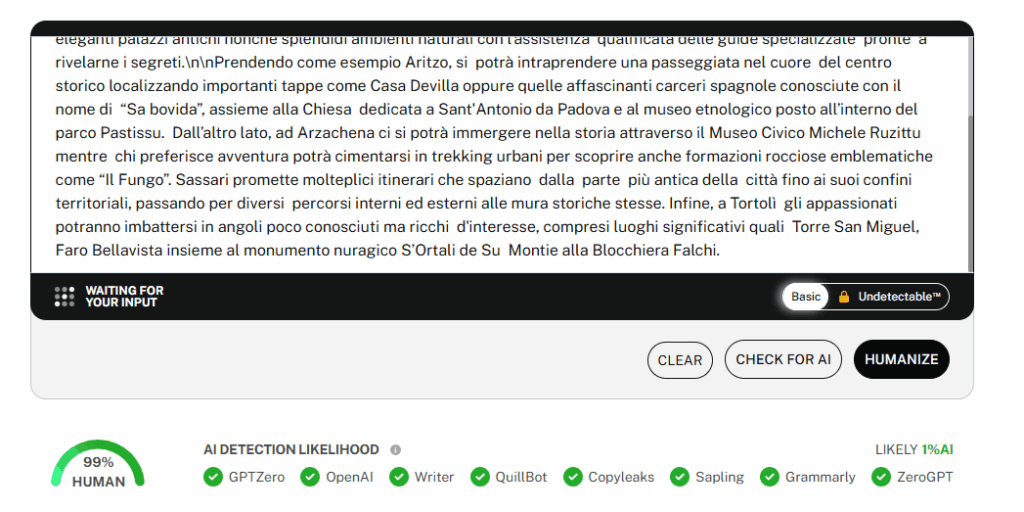

L’esperimento di un motore di ricerca “AI-only”, dove i link originari potrebbero scomparire del tutto, rappresenta una svolta potenzialmente rivoluzionaria, ma che impone una riflessione approfondita sulle sue implicazioni a lungo termine. Da un lato, la velocità nel trovare la risposta desiderata potrebbe migliorare notevolmente l’esperienza utente. Dall’altro, l’assenza di un facile accesso alle fonti originali potrebbe rendere più difficile la verifica delle informazioni e, di conseguenza, aumentare la vulnerabilità degli utenti alla disinformazione. La recente introduzione della funzione Search Generative Experience (SGE), presentata da Google nel corso dell’evento I/O 2023, consente agli utenti di condurre ricerche in maniera più fluida ed efficiente. Essa offre risposte esaustive in tempi ridotti, arricchendo l’esperienza con suggerimenti generati dall’intelligenza artificiale. Questa sinergia tra ricerca e tecnologia avanzata non solo facilita l’attività informativa degli utilizzatori, ma amplifica il procedimento attraverso informazioni supplementari e quesiti di seguito.. La recente evoluzione della ricerca fondata sull’intelligenza artificiale non può essere considerata un fatto isolato; piuttosto, si colloca all’interno di un panorama caratterizzato da una sempre maggiore concorrenza nel settore. Attori significativi come Microsoft, attraverso Bing AI, e OpenAI, con ChatGPT, stanno conducendo indagini su modelli affini. La rotta tracciata da Google ha il potere di stabilire nuovi parametri riguardanti l’accesso alla conoscenza via internet. È fondamentale analizzare a fondo i meccanismi operativi e i possibili pericoli insiti in tali sistemi per assicurare che ciò avvenga in maniera responsabile.

Il fulcro del dibattito si concentra sulla capacità degli algoritmi di generare risposte che siano tanto precise quanto imparziali. Questi strumenti sono infatti influenzati da bias provenienti sia dai dati utilizzati durante la fase d’addestramento sia dalle decisioni progettuali assunte dagli esseri umani. In un’epoca in cui l’informazione rappresenta una forma potentissima di influenza sociale e culturale, il modo attraverso cui vi accediamo e la nostra abilità nell’analizzarne l’affidabilità divengono aspetti cruciali per favorire una società realmente informata e consapevole.

I bias algoritmici e la sfida della trasparenza

Uno degli aspetti più delicati dell’integrazione dell’AI nei motori di ricerca è il rischio intrinseco di bias algoritmici. Questi pregiudizi, spesso inconsci, possono essere ereditati dai vasti set di dati utilizzati per addestrare i modelli di intelligenza artificiale. Come evidenziato da diversi ricerche, tra cui uno studio condotto dalla Sapienza Università di Roma sui modelli Gemini, GPT-4o mini e LLaMA 3.1, gli LLM possono mostrare una tendenza a sovrastimare l’affidabilità di fonti con un determinato orientamento politico, ad esempio quelle di sinistra, e a sottovalutare quelle di destra.

Questo suggerisce che i dati di addestramento potrebbero non essere perfettamente rappresentativi o riflettere distorsioni esistenti nel mondo reale. Recenti studi, come quello della Stanford University, hanno introdotto nuovi benchmark per misurare i bias nell’intelligenza artificiale, contribuendo a sviluppare modelli più equi e meno inclini a causare danni. Tali benchmark risultano utili nel far emergere come una trattazione uniforme possa ulteriormente intensificare i pregiudizi già presenti, evidenziando così l’urgenza di adottare un approccio più sfumato.

I bias possono manifestarsi anche nell’associazione di specifici termini linguistici alla credibilità delle notizie. Mentre fonti affidabili sono spesso associate a parole chiave come “trasparenza” e “fatti verificabili”, quelle non affidabili tendono a legarsi a termini come “sensazionalismo” e “teorie del complotto”. Sebbene questo possa apparire logico, solleva la questione se l’AI sia effettivamente in grado di valutare il contenuto nel suo complesso o se si basi principalmente su correlazioni superficiali e preconcetti acquisiti.

La mancanza di trasparenza nel processo decisionale degli LLM aggrava ulteriormente il problema. Quando gli utenti ricevono una risposta sintetica dall’AI, senza un chiaro riferimento alle fonti o una spiegazione del perché determinate informazioni siano state selezionate, diventa difficile valutare l’oggettività e la completezza della risposta stessa. Questa “scatola nera” solleva preoccupazioni sulla potenziale creazione di filter bubbles, dove gli utenti ricevono solo informazioni che confermano le loro convinzioni esistenti, limitando l’esposizione a prospettive diverse.

Affrontare il bias nell’IA non è solo una questione tecnica di perfezionamento degli algoritmi, ma richiede anche un impegno per la trasparenza e la spiegazione dei processi decisionali, al fine di garantire che gli utenti possano interagire con questi sistemi in modo consapevole e critico.

L’erosione del pensiero critico e il rischio di dipendenza dall’AI

L’integrazione sempre più estesa dell’intelligenza artificiale nei vari aspetti della nostra esistenza quotidiana si accompagna a un rischio considerevole: la compromissione del pensiero critico. Una ricerca svolta da Microsoft in collaborazione con Carnegie Mellon ha evidenziato come una fiducia smodata verso le intelligenze artificiali possa determinare una flessione nelle nostre capacità di analisi critica. Nei casi in cui ci appoggiamo progressivamente sulle risposte fornite da tecnologie quali ChatGPT o Copilot senza sottoporle a verifica critica o dubbio alcuno, potremmo ritrovarci a diventare meri controllori degli output prodotti dall’AI anziché individui capaci di riflessioni autonome.

Questo fenomeno prende il nome di cognitive offloading, e benché non sia completamente innovativo – consideriamo ad esempio gli effetti delle calcolatrici sul nostro calcolo mentale, oppure quelli dei navigatori satellitari sull’abilità orientativa, e ancora i motori di ricerca sulla memoria esplicita, conosciuto come effetto Google – l’avvento dell’AI generativa solleva la questione su piani qualitativi mai esplorati fino ad oggi. La capacità di argomentare, confrontare fonti e pensare in modo originale potrebbe atrofizzarsi se ci abituiamo a ricevere risposte pronte e ben formulate senza uno sforzo cognitivo significativo.

Sebbene l’efficienza possa aumentare, il rischio è che la nostra competenza nel risolvere problemi complessi diminuisca nel tempo. Un altro studio ha evidenziato la “distorsione da automazione” (automation bias), ovvero la tendenza a fidarsi eccessivamente dell’AI, anche quando questa commette errori. Questo bias è particolarmente pericoloso perché può portare ad accettare passivamente informazioni errate o distorte, minando la nostra capacità di discernimento.

La questione è ulteriormente complicata dal fatto che gli strumenti di AI sono spesso progettati per essere assertivi e non mostrare incertezza, il che può creare un’illusione di infallibilità e rendere le loro risposte ancora più convincenti, anche quando non sono del tutto accurate. Preservare il pensiero critico nell’era dell’AI richiede un approccio consapevole sia da parte degli utenti, che devono imparare a interagire in modo critico con questi strumenti, sia da parte dei progettisti, che dovrebbero sviluppare interfacce che stimolino attivamente la riflessione e la verifica delle informazioni.

Navigare nel “messy middle”: strategie per un futuro informato

Il “messy middle”, un concetto che descrive il percorso d’acquisto dei consumatori nell’era digitale, può essere esteso anche al modo in cui navighiamo e acquisiamo informazioni. In un mondo dove le fonti sono molteplici e spesso contrastanti, e dove l’AI si propone come intermediario nella ricerca, diventa fondamentale sviluppare strategie per muoversi efficacemente in questo spazio complesso. La capacità di identificare e valutare l’affidabilità delle notizie è più importante che mai.

Strumenti come quelli analizzati nello studio della Sapienza, che confrontano le valutazioni degli LLM con quelle di sistemi esperti come NewsGuard e Media Bias Fact Check, offrono un primo passo verso la comprensione delle capacità e dei limiti dell’AI in questo campo. Tuttavia, è cruciale andare oltre la semplice etichettatura di affidabile o non affidabile e comprendere i criteri sottostanti utilizzati sia dagli algoritmi che dagli esperti umani. La trasparenza sui dati di addestramento, sui modelli utilizzati e sui processi decisionali degli algoritmi è essenziale per consentire agli utenti di valutare criticamente le risposte fornite dall’AI. In aggiunta, appare evidente che un investimento nell’educazione digitale si rivela imprescindibile. È cruciale che istituzioni scolastiche e accademiche prevedano l’inclusione di moduli didattici incentrati su pensiero critico, analisi delle fonti online e comprensione dei principi dell’intelligenza artificiale. A tal proposito, si segnalano nuove iniziative formative come i corsi specificati nel Decreto Ministeriale 66 del 2023, concepiti per dotare gli insegnanti di competenze superiori da applicare nei programmi scolastici.

In ambito professionale, in particolare in settori dove l’accuratezza delle informazioni è critica, come la medicina o la finanza, è necessario implementare processi di revisione strutturata dove l’output dell’AI sia sottoposto a un controllo umano rigoroso prima di essere utilizzato. Questo non solo garantisce una maggiore affidabilità, ma preserva anche l’expertise umana e previene la dipendenza eccessiva dalla macchina.

Riflessioni su dati, conoscenza e il nostro ruolo nell’era digitale

Nel vasto universo dell’intelligenza artificiale, una nozione fondamentale è quella dei “dati”. I sistemi di AI imparano e funzionano basandosi su enormi quantità di dati, che spaziano da testi a immagini, a suoni. È come se l’AI fosse un infante con una memoria prodigiosa, che impara a conoscere il mondo osservando e memorizzando ogni dettaglio accessibile. Nel contesto della ricerca online, questo significa che l’AI si nutre di miliardi di pagine web, articoli, libri e altri contenuti digitali per formulare le sue risposte.

La qualità e la varietà di questi dati di addestramento sono cruciali, poiché determinano in gran parte l’accuratezza e l’imparzialità dei risultati dell’AI. Una nozione più avanzata e strettamente correlata al tema dei bias è il concetto di “apprendimento per rinforzo” (Reinforcement Learning with Human Feedback – RLHF), che è un approccio utilizzato per allineare il comportamento dell’AI alle preferenze umane. Tuttavia, questo processo non è immune da bias; se il feedback umano stesso è influenzato da pregiudizi, questi verranno inevitabilmente trasmessi all’AI.

Di fronte a questa realtà, una domanda sorge spontanea: quale diventa il nostro ruolo nel processo di acquisizione della conoscenza? Se l’AI ci offre risposte immediate e confezionate, corriamo il rischio di diventare passivi recettori, perdendo l’abitudine e la curiosità di esplorare, confrontare e formare opinioni autonome. È un po’ come avere un assistente personale geniale ma potenzialmente influenzato, che ci racconta solo ciò che ritiene rilevante.

Questo non significa che l’AI sia intrinsecamente dannosa; al contrario, può essere uno strumento potentissimo per amplificare la nostra intelligenza e la nostra creatività. Ma per sfruttarla appieno, dobbiamo mantenere salda la nostra capacità di pensiero critico. In questo contesto, l’educazione al pensiero critico e l’apprendimento della verifica delle fonti diventano imprescindibili per ogni cittadino.

In definitiva, l’intelligenza artificiale può supportare il nostro processo decisionale, ma non dovrebbe mai sostituire la nostra facoltà di discernimento. La consapevolezza critica nell’impiego degli strumenti tecnologici si rivela essenziale al fine di assicurare un futuro informato e responsabile.

Pertanto, si delinea una sfida significativa: non tanto rimpiazzare l’intelligenza umana mediante quella artificiale quanto piuttosto ideare modalità ottimali per combinarle armoniosamente. Questa fusione darà vita a un’intelligenza ibrida, capace di sfruttare le virtù intrinseche ad entrambe le forme d’intelligenza. Un tale approccio necessiterà di costanti riflessioni, analizzando gli effetti sociali e cognitivi legati all’AI; richiederà inoltre uno sforzo deciso verso la trasparenza e il potenziamento delle competenze critiche indispensabili a orientarsi nel dinamico panorama informativo attuale.

Il Digital Services Act funge da significativo progresso nella regolamentazione della responsabilità delle piattaforme digitali; tuttavia, occorre sottolineare che l’onere finale circa una fruizione criticamente consapevole delle notizie grava inevitabilmente su ogni singolo individuo.