Siri: Un’occasione sprecata per Apple

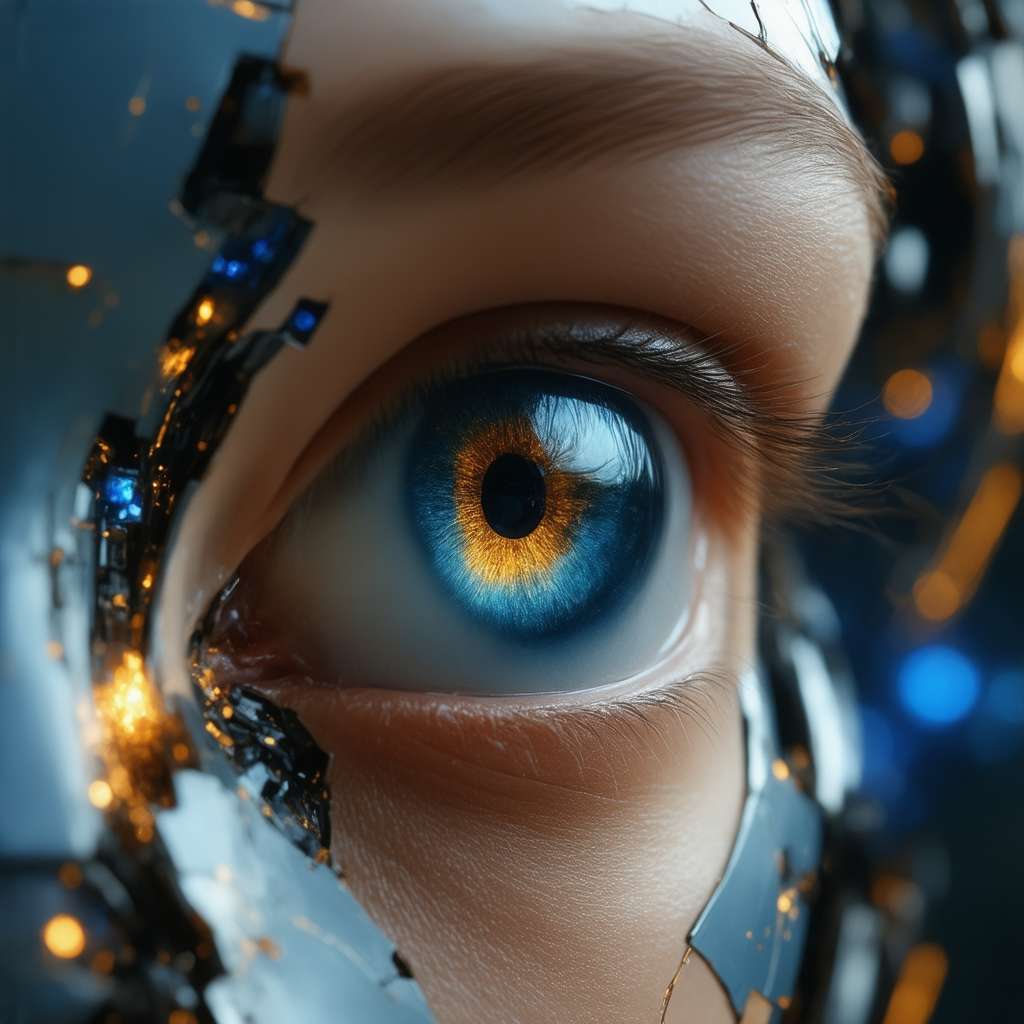

Nel panorama tecnologico in rapida evoluzione, l’intelligenza artificiale conversazionale sta assumendo un ruolo sempre più centrale. In questo contesto, Siri, l’assistente virtuale di Apple, si trova a un punto di svolta. Quella che un tempo era una tecnologia all’avanguardia, oggi appare in affanno, superata dalle soluzioni offerte dai concorrenti come Google, Amazon e OpenAI. Questa situazione solleva interrogativi cruciali sul futuro di Apple nel settore dell’IA e sull’impatto di tale ritardo sulla sua immagine di azienda innovativa.

L’assistente virtuale di Apple, un tempo all’avanguardia, pare che sia diventata un’occasione persa per l’azienda con sede a Cupertino. Mentre concorrenti come Google, Amazon e OpenAI avanzano a passi da gigante nel campo dell’intelligenza artificiale conversazionale, Siri arranca, e questo compromette la reputazione di Apple come leader nel settore dell’innovazione. La competizione nel mercato degli assistenti virtuali si fa sempre più intensa, e Apple deve affrontare sfide significative per mantenere la sua posizione. La crescente sofisticazione degli assistenti virtuali rivali sta mettendo in luce le debolezze di Siri, che deve affrontare nuove sfide per restare competitiva. L’evoluzione tecnologica impone a Apple di ripensare la sua strategia per Siri, al fine di recuperare il terreno perduto e riconquistare la leadership nel settore.

Siri è stata lanciata inizialmente nel 2011 come un’applicazione indipendente per iOS e fu acquisita da Apple l’anno successivo, venendo integrata profondamente nel sistema operativo mobile a partire da iOS 5. L’idea era quella di fornire agli utenti un modo semplice e intuitivo per interagire con i loro dispositivi, utilizzando la voce per eseguire compiti, ottenere informazioni e controllare le funzionalità del telefono. Siri ha rappresentato una vera e propria rivoluzione, aprendo la strada a un nuovo modo di concepire l’interazione uomo-macchina. Tuttavia, con il passare degli anni, l’evoluzione di Siri non ha tenuto il passo con quella dei suoi concorrenti, che hanno investito ingenti risorse nello sviluppo di nuove tecnologie e funzionalità. Questo ha portato a un progressivo distacco tra Siri e le aspettative degli utenti, che si sono trovati di fronte a un assistente virtuale sempre meno capace di soddisfare le loro esigenze. L’incapacità di Apple di mantenere Siri al passo con i tempi ha determinato un progressivo declino della sua popolarità e una conseguente perdita di terreno nei confronti dei concorrenti.

La situazione attuale è il risultato di una serie di fattori, tra cui una possibile mancanza di investimenti adeguati nello sviluppo dell’IA, problemi di leadership e una visione strategica poco chiara. Apple deve affrontare queste sfide per rilanciare Siri e riaffermare la sua leadership nel settore. Gli analisti del settore sono concordi nel ritenere che Apple debba intervenire tempestivamente per evitare un ulteriore declino di Siri. Le prossime mosse di Apple saranno decisive per il futuro di Siri e per la sua capacità di competere con i rivali. La pressione della concorrenza impone a Apple di accelerare lo sviluppo di nuove funzionalità e di migliorare le prestazioni di Siri. Il mercato dell’IA conversazionale è in continua evoluzione, e Apple deve essere pronta a rispondere alle nuove sfide per non perdere ulteriori quote di mercato. L’azienda dovrà dimostrare di essere in grado di innovare e di offrire agli utenti un’esperienza d’uso superiore rispetto a quella offerta dai concorrenti.

Siri contro il resto del mondo: Un’analisi impietosa

Il confronto tra Siri e le soluzioni offerte da Google (Google Assistant e Gemini), Amazon (Alexa) e OpenAI (ChatGPT) evidenzia le lacune dell’assistente virtuale di Apple. In termini di funzionalità, accuratezza e integrazione con altri servizi, Siri appare limitata e meno performante rispetto ai suoi rivali. Google Gemini, ad esempio, si sta rapidamente affermando come l’assistente virtuale più capace sul mercato, grazie alla sua vasta conoscenza, alla sua capacità di comprendere il linguaggio naturale e alla sua capillare diffusione su dispositivi Android. La sua integrazione con i telefoni Samsung rappresenta un ulteriore vantaggio competitivo, offrendo agli utenti un’esperienza d’uso più fluida e intuitiva. ChatGPT, invece, si distingue per la sua capacità di generare testi creativi e originali, aprendo nuove frontiere nel campo dell’IA conversazionale. Alexa, infine, si è affermata come leader nel settore della smart home, grazie alla sua integrazione con un’ampia gamma di dispositivi e servizi. La frammentazione dell’ecosistema di assistenti virtuali rende difficile per i consumatori scegliere la soluzione più adatta alle loro esigenze. Le aziende del settore sono impegnate in una competizione serrata per conquistare la leadership del mercato. L’innovazione tecnologica è il motore di questa competizione, e le aziende devono investire costantemente in ricerca e sviluppo per rimanere competitive.

Le limitazioni di Siri non si limitano alle funzionalità di base. Anche in compiti più complessi, come la comprensione del contesto e la gestione di conversazioni articolate, l’assistente virtuale di Apple mostra delle debolezze. Questo si traduce in un’esperienza d’uso frustrante per gli utenti, che spesso si trovano di fronte a risposte imprecise o incomplete. La difficoltà di Siri nel comprendere il linguaggio naturale è uno dei principali ostacoli al suo successo. L’assistente virtuale di Apple fatica a interpretare le sfumature del linguaggio umano, il che si traduce in errori di comprensione e risposte inappropriate. La mancanza di integrazione con servizi di terze parti limita ulteriormente le capacità di Siri. L’assistente virtuale di Apple non è in grado di accedere a un’ampia gamma di informazioni e servizi disponibili online, il che la rende meno utile per gli utenti. Le aziende concorrenti hanno investito ingenti risorse nello sviluppo di piattaforme aperte e flessibili, in grado di integrarsi con un’ampia gamma di servizi e dispositivi. Questo ha permesso loro di offrire agli utenti un’esperienza d’uso più completa e personalizzata. La chiusura dell’ecosistema Apple rappresenta un limite per lo sviluppo di Siri. L’azienda dovrebbe valutare la possibilità di aprire la sua piattaforma a sviluppatori di terze parti, al fine di ampliare le capacità di Siri e di renderla più competitiva.

La superiorità di Google Gemini, ad esempio, è attribuibile alla sua vasta conoscenza e alla sua capacità di apprendere e adattarsi rapidamente alle esigenze degli utenti. La sua integrazione con i telefoni Samsung rappresenta un vantaggio significativo, in quanto consente agli utenti di accedere all’assistente virtuale direttamente dal sistema operativo. ChatGPT, invece, si distingue per la sua capacità di generare testi creativi e originali, aprendo nuove frontiere nel campo dell’IA conversazionale. La sua capacità di comprendere il contesto e di rispondere in modo appropriato alle domande degli utenti la rende uno strumento prezioso per la comunicazione e la creazione di contenuti. Alexa, infine, si è affermata come leader nel settore della smart home, grazie alla sua integrazione con un’ampia gamma di dispositivi e servizi. La sua capacità di controllare la domotica e di fornire informazioni in tempo reale la rende uno strumento indispensabile per la gestione della casa intelligente. La competizione nel mercato degli assistenti virtuali si fa sempre più intensa, e le aziende devono investire costantemente in ricerca e sviluppo per rimanere competitive. L’innovazione tecnologica è il motore di questa competizione, e le aziende devono essere pronte a rispondere alle nuove sfide per non perdere ulteriori quote di mercato.

Apple si trova quindi di fronte a un bivio: continuare a investire in Siri, cercando di colmare il divario con i concorrenti, o concentrarsi su altre aree di sviluppo dell’IA. La decisione che prenderà avrà un impatto significativo sul suo futuro nel settore dell’intelligenza artificiale. Gli analisti del settore sono divisi sulla strategia che Apple dovrebbe adottare. Alcuni ritengono che l’azienda debba concentrarsi sul miglioramento delle prestazioni di Siri, mentre altri suggeriscono di esplorare nuove aree di sviluppo dell’IA, come la guida autonoma e la robotica. La decisione finale spetta ad Apple, che dovrà valutare attentamente i pro e i contro di ogni strategia prima di prendere una decisione definitiva. L’azienda dovrà tenere conto delle sue risorse, delle sue competenze e delle sue ambizioni nel settore dell’intelligenza artificiale. La competizione nel mercato dell’IA è sempre più intensa, e Apple deve essere pronta a rispondere alle nuove sfide per non perdere ulteriori quote di mercato.

Le radici dell’insuccesso: Un’analisi approfondita

Le ragioni del declino di Siri sono molteplici e complesse. Una possibile causa è la mancanza di investimenti adeguati nello sviluppo dell’IA. Apple, pur essendo una delle aziende più ricche del mondo, potrebbe non aver dedicato risorse sufficienti al miglioramento delle capacità di comprensione del linguaggio naturale e all’implementazione di nuove funzionalità. Questo ha portato a un progressivo distacco tra Siri e le aspettative degli utenti, che si sono trovati di fronte a un assistente virtuale sempre meno capace di soddisfare le loro esigenze. La competizione nel mercato dell’IA richiede ingenti investimenti in ricerca e sviluppo, e Apple deve essere pronta a sostenere questi costi per rimanere competitiva. Le aziende concorrenti hanno investito ingenti risorse nello sviluppo di nuove tecnologie e funzionalità, e Apple deve fare altrettanto per non perdere ulteriori quote di mercato. L’azienda dovrà dimostrare di essere in grado di innovare e di offrire agli utenti un’esperienza d’uso superiore rispetto a quella offerta dai concorrenti.

Un altro fattore che potrebbe aver contribuito all’insuccesso di Siri sono i problemi di leadership e una visione strategica poco chiara. La mancanza di una guida forte e di una direzione definita nello sviluppo di Siri potrebbe aver portato a una dispersione di sforzi e a una mancanza di coordinamento tra i diversi team di sviluppo. La competizione nel mercato dell’IA richiede una leadership forte e una visione strategica chiara, in grado di guidare gli sforzi di sviluppo e di garantire il coordinamento tra i diversi team. Apple deve affrontare queste sfide per rilanciare Siri e riaffermare la sua leadership nel settore. Gli analisti del settore sono concordi nel ritenere che Apple debba rafforzare la sua leadership nel settore dell’IA e definire una visione strategica chiara per lo sviluppo di Siri. Le prossime mosse di Apple saranno decisive per il futuro di Siri e per la sua capacità di competere con i rivali. La pressione della concorrenza impone a Apple di accelerare lo sviluppo di nuove funzionalità e di migliorare le prestazioni di Siri. Il mercato dell’IA conversazionale è in continua evoluzione, e Apple deve essere pronta a rispondere alle nuove sfide per non perdere ulteriori quote di mercato.

Le difficoltà nell’integrare Siri con l’ecosistema Apple rappresentano un ulteriore ostacolo al suo sviluppo. L’ambiente chiuso di Apple potrebbe limitare la flessibilità e l’adattabilità dell’assistente virtuale, impedendole di accedere a dati e servizi esterni necessari per fornire risposte complete e accurate. La competizione nel mercato dell’IA richiede una piattaforma aperta e flessibile, in grado di integrarsi con un’ampia gamma di servizi e dispositivi. Apple deve valutare la possibilità di aprire la sua piattaforma a sviluppatori di terze parti, al fine di ampliare le capacità di Siri e di renderla più competitiva. Le aziende concorrenti hanno investito ingenti risorse nello sviluppo di piattaforme aperte e flessibili, in grado di integrarsi con un’ampia gamma di servizi e dispositivi. Questo ha permesso loro di offrire agli utenti un’esperienza d’uso più completa e personalizzata. La chiusura dell’ecosistema Apple rappresenta un limite per lo sviluppo di Siri. L’azienda dovrebbe valutare la possibilità di aprire la sua piattaforma a sviluppatori di terze parti, al fine di ampliare le capacità di Siri e di renderla più competitiva.

Un ulteriore fattore che contribuisce all’insuccesso di Siri potrebbe essere la difficoltà di Apple nell’unificare le diverse versioni dell’assistente. La coesistenza di una versione più obsoleta, destinata a compiti semplici, e di una versione più intelligente, progettata per conversazioni complesse, potrebbe creare problemi di integrazione e confusione per gli utenti. La competizione nel mercato dell’IA richiede una piattaforma unificata e coerente, in grado di offrire agli utenti un’esperienza d’uso fluida e intuitiva. Apple deve affrontare questa sfida per rilanciare Siri e riaffermare la sua leadership nel settore. Gli analisti del settore sono concordi nel ritenere che Apple debba unificare le diverse versioni di Siri e offrire agli utenti un’esperienza d’uso coerente e intuitiva. Le prossime mosse di Apple saranno decisive per il futuro di Siri e per la sua capacità di competere con i rivali. La pressione della concorrenza impone a Apple di accelerare lo sviluppo di nuove funzionalità e di migliorare le prestazioni di Siri. Il mercato dell’IA conversazionale è in continua evoluzione, e Apple deve essere pronta a rispondere alle nuove sfide per non perdere ulteriori quote di mercato.

Apple dovrà quindi affrontare tutte queste sfide e criticità per rilanciare Siri e recuperare il terreno perduto nei confronti dei concorrenti. La competizione nel mercato dell’IA è sempre più intensa, e l’azienda deve essere pronta a rispondere alle nuove sfide per non perdere ulteriori quote di mercato. La decisione che prenderà avrà un impatto significativo sul suo futuro nel settore dell’intelligenza artificiale. Gli analisti del settore sono divisi sulla strategia che Apple dovrebbe adottare. Alcuni ritengono che l’azienda debba concentrarsi sul miglioramento delle prestazioni di Siri, mentre altri suggeriscono di esplorare nuove aree di sviluppo dell’IA, come la guida autonoma e la robotica. La decisione finale spetta ad Apple, che dovrà valutare attentamente i pro e i contro di ogni strategia prima di prendere una decisione definitiva. L’azienda dovrà tenere conto delle sue risorse, delle sue competenze e delle sue ambizioni nel settore dell’intelligenza artificiale. La competizione nel mercato dell’IA è sempre più intensa, e Apple deve essere pronta a rispondere alle nuove sfide per non perdere ulteriori quote di mercato.

Impatto sulla reputazione e strategie future

Le performance deludenti di Siri non rappresentano solamente una questione tecnologica, bensì costituiscono un rischio concreto per la reputazione di Apple. In un’epoca in cui l’intelligenza artificiale assume un ruolo sempre più centrale, la percezione di un’azienda come leader nel settore dell’innovazione è strettamente legata alla qualità del proprio assistente virtuale. Un Siri obsoleto rischia seriamente di compromettere l’immagine di Apple agli occhi dei consumatori e degli investitori, influenzando negativamente le decisioni di acquisto e minando la fiducia nel marchio. Le ripercussioni di un assistente virtuale inadeguato si estendono ben oltre la semplice esperienza d’uso, intaccando la percezione complessiva dell’azienda come pioniere tecnologico. La fiducia dei consumatori, un elemento fondamentale per il successo di Apple, potrebbe essere compromessa dalla persistente incapacità di Siri di competere con le soluzioni offerte dai concorrenti. Gli investitori, a loro volta, potrebbero nutrire dubbi sulla capacità di Apple di mantenere la propria leadership nel settore dell’innovazione, con conseguenze negative sul valore delle azioni e sulla capacità dell’azienda di attrarre capitali. In un mercato sempre più competitivo, la reputazione di Apple come azienda all’avanguardia è un asset prezioso, che deve essere preservato e coltivato con attenzione. La persistente incapacità di Siri di competere con le soluzioni offerte dai concorrenti rappresenta una minaccia concreta per questo asset, che potrebbe avere ripercussioni negative sul futuro dell’azienda.

Nonostante le difficoltà incontrate, Apple conserva intatte le proprie potenzialità per invertire la rotta. Per raggiungere questo obiettivo, si rende necessario un cambiamento strategico radicale, che preveda un aumento significativo degli investimenti in ricerca e sviluppo, una leadership più incisiva e una maggiore apertura verso l’esterno. L’azienda deve focalizzarsi sullo sviluppo di un’intelligenza artificiale più potente e versatile, in grado di rivaleggiare con le soluzioni proposte da Google, Amazon e OpenAI. Tale processo potrebbe includere l’adozione di modelli di linguaggio più avanzati, il miglioramento della comprensione del contesto e l’integrazione con un numero crescente di servizi di terze parti. La recente notizia secondo cui Apple starebbe lavorando a un concorrente di ChatGPT e Gemini potrebbe rappresentare un segnale incoraggiante, ma è fondamentale che tale progetto si traduca in un prodotto concreto e competitivo, capace di soddisfare le aspettative degli utenti e di rilanciare l’immagine di Apple come leader nel settore dell’intelligenza artificiale. Il successo di tale iniziativa dipenderà dalla capacità di Apple di superare le sfide tecnologiche e organizzative che si presentano, e di creare un prodotto innovativo e all’avanguardia, in grado di competere con le soluzioni offerte dai concorrenti. La posta in gioco è alta, e Apple deve dimostrare di essere all’altezza della sfida per riconquistare la leadership nel settore dell’intelligenza artificiale.

Secondo alcune fonti, il lancio della nuova versione di Siri sarebbe stato rinviato a causa della presenza di bug e di problemi di instabilità, sollevando interrogativi sulla capacità di Apple di rispettare le scadenze prefissate e di fornire un prodotto di elevata qualità. Tale ritardo potrebbe essere attribuito anche alla difficoltà di proteggere Siri da attacchi di tipo “prompt injection”, i quali potrebbero compromettere la sicurezza dei dati degli utenti. La competizione nel mercato dell’intelligenza artificiale è sempre più accesa, e Apple deve affrontare queste sfide per non perdere ulteriori quote di mercato. La decisione di rinviare il lancio della nuova versione di Siri potrebbe essere interpretata come un segno di cautela da parte di Apple, che preferisce evitare di rilasciare un prodotto imperfetto, piuttosto che compromettere la propria reputazione. Tuttavia, tale ritardo potrebbe anche rappresentare un’opportunità per i concorrenti di consolidare la propria posizione nel mercato, rendendo ancora più difficile per Apple recuperare il terreno perduto. L’azienda dovrà dimostrare di essere in grado di superare queste difficoltà e di rilasciare un prodotto innovativo e all’avanguardia, in grado di competere con le soluzioni offerte dai concorrenti.

Il futuro di Apple nel mercato dell’intelligenza artificiale conversazionale si presenta quindi incerto e ricco di sfide. La capacità dell’azienda di rilanciare Siri e di colmare il divario con i concorrenti determinerà il suo successo nel lungo periodo. La decisione che Apple prenderà avrà un impatto significativo sul suo futuro nel settore dell’intelligenza artificiale. Gli analisti del settore sono divisi sulla strategia che Apple dovrebbe adottare. Alcuni ritengono che l’azienda debba concentrarsi sul miglioramento delle prestazioni di Siri, mentre altri suggeriscono di esplorare nuove aree di sviluppo dell’IA, come la guida autonoma e la robotica. La decisione finale spetta ad Apple, che dovrà valutare attentamente i pro e i contro di ogni strategia prima di prendere una decisione definitiva. L’azienda dovrà tenere conto delle sue risorse, delle sue competenze e delle sue ambizioni nel settore dell’intelligenza artificiale. La competizione nel mercato dell’IA è sempre più intensa, e Apple deve essere pronta a rispondere alle nuove sfide per non perdere ulteriori quote di mercato.

Un punto di svolta cruciale per il futuro

Il destino di Apple nel competitivo scenario dell’IA conversazionale è appeso a un filo sottile. Se l’azienda non saprà imprimere una svolta decisiva a Siri, colmando il divario con i concorrenti, rischierà di vanificare un’opportunità fondamentale e di rimanere indietro in un’area tecnologica destinata a plasmare il futuro. Il rilancio di Siri non è solamente una questione di prestigio tecnologico, bensì una necessità strategica imprescindibile per garantire la competitività di Apple nel lungo periodo. L’azienda dovrà dimostrare di essere in grado di innovare e di offrire agli utenti un’esperienza d’uso superiore rispetto a quella offerta dai concorrenti, per non perdere ulteriori quote di mercato e per mantenere la propria leadership nel settore dell’innovazione. La posta in gioco è alta, e Apple deve dimostrare di essere all’altezza della sfida per riconquistare la leadership nel settore dell’intelligenza artificiale. Il successo di tale iniziativa dipenderà dalla capacità di Apple di superare le sfide tecnologiche e organizzative che si presentano, e di creare un prodotto innovativo e all’avanguardia, in grado di competere con le soluzioni offerte dai concorrenti. La decisione che Apple prenderà avrà un impatto significativo sul suo futuro nel settore dell’intelligenza artificiale. Gli analisti del settore sono divisi sulla strategia che Apple dovrebbe adottare. Alcuni ritengono che l’azienda debba concentrarsi sul miglioramento delle prestazioni di Siri, mentre altri suggeriscono di esplorare nuove aree di sviluppo dell’IA, come la guida autonoma e la robotica. La decisione finale spetta ad Apple, che dovrà valutare attentamente i pro e i contro di ogni strategia prima di prendere una decisione definitiva. L’azienda dovrà tenere conto delle sue risorse, delle sue competenze e delle sue ambizioni nel settore dell’intelligenza artificiale. La competizione nel mercato dell’IA è sempre più intensa, e Apple deve essere pronta a rispondere alle nuove sfide per non perdere ulteriori quote di mercato.

In fondo, è come se Siri fosse un modello di linguaggio addestrato su un insieme di dati limitato. Un modello di linguaggio è un algoritmo di intelligenza artificiale che impara a prevedere la successione di parole in una frase. Più dati vengono utilizzati per addestrare il modello, più accurate saranno le sue previsioni. Allo stesso modo, Siri ha bisogno di essere addestrata su un insieme di dati più ampio e diversificato per poter comprendere meglio le richieste degli utenti e fornire risposte più accurate. Una nozione più avanzata è quella del “transfer learning”, dove un modello pre-addestrato su un vasto dataset viene poi raffinato su un dataset più piccolo e specifico per il compito desiderato. Forse Apple potrebbe sfruttare questa tecnica per migliorare le prestazioni di Siri, utilizzando un modello pre-addestrato su un dataset di grandi dimensioni e poi adattandolo alle esigenze specifiche degli utenti Apple. Riflettiamo: in un mondo in cui l’IA è sempre più presente, quale ruolo vogliamo che abbiano gli assistenti virtuali nella nostra vita? Vogliamo che siano semplici strumenti per eseguire compiti, o vogliamo che siano dei veri e propri compagni di conversazione in grado di comprenderci e di aiutarci a prendere decisioni? La risposta a questa domanda determinerà il futuro dell’IA conversazionale e il ruolo che aziende come Apple avranno in questo settore.