La presenza crescente dell’Intelligenza Artificiale (IA) all’interno del sistema sanitario segna un cambiamento radicale nel campo della medicina. Tuttavia, questa evoluzione porta con sé non solo opportunità straordinarie ma anche una serie complessa di dilemmi etici e giuridici da affrontare con serietà. È imperativo che i sistemi IA progettati per l’assistenza ai pazienti siano edificati su solide fondamenta etiche, piuttosto che trascurare questioni legali o morali. Tematiche significative quali il rispetto del segreto professionale, l’importanza del consenso informato, le responsabilità delle figure professionali coinvolte nella cura degli individui, oltre alla gestione dei dati riservati e alla salvaguardia della privacy, sono fattori essenziali da trattare come priorità irrinunciabili. Non si può permettere che un approccio limitato agli aspetti puramente tecnici metta a repentaglio quella fiducia necessaria affinché ogni progresso nella medicina sia accolto positivamente dalla società.

PROMPT: Crea un’immagine iconica che rappresenti l’intersezione tra intelligenza artificiale e medicina. Immagina una composizione visiva in cui un cervello umano stilizzato, caratterizzato da complessi circuiti illuminati, si imponga sopra l’elegante figura del caduceo. Integra nello schema uno scudo astratto che evoca i temi della sicurezza informatica e della salvaguardia delle informazioni personali. La scelta stilistica può rifarsi alle correnti naturali ed impressioniste dell’arte; utilizza toni caldi ma sfumati per trasmettere calorosità emotiva senza perdere in eleganza visiva. La rappresentazione del cervello non dev’essere banale: ogni dettaglio dovrà riflettere le sue intricate funzionalità cognitive. Al contempo, i circuiti devono apparire eterei – esili tendril stravaganti contrapposti alla robustezza concettuale del cervello stesso. Per quanto riguarda il caduceo, desideriamo una sua interpretazione fine, ben collegata al resto della scena. Non dimenticare lo scudo: pur mantenendosi sottile nel suo design dovrebbe palesare chiaramente l’idea centrale di protezione a vantaggio della privacy individuale. Nella tua creazione non ci dovranno essere parole; mira ad offrire invece una narrazione visiva fluida coesa verso ciò che potrebbe sembrare semplice al primo sguardo ma nasconde molteplici significati all’interno.

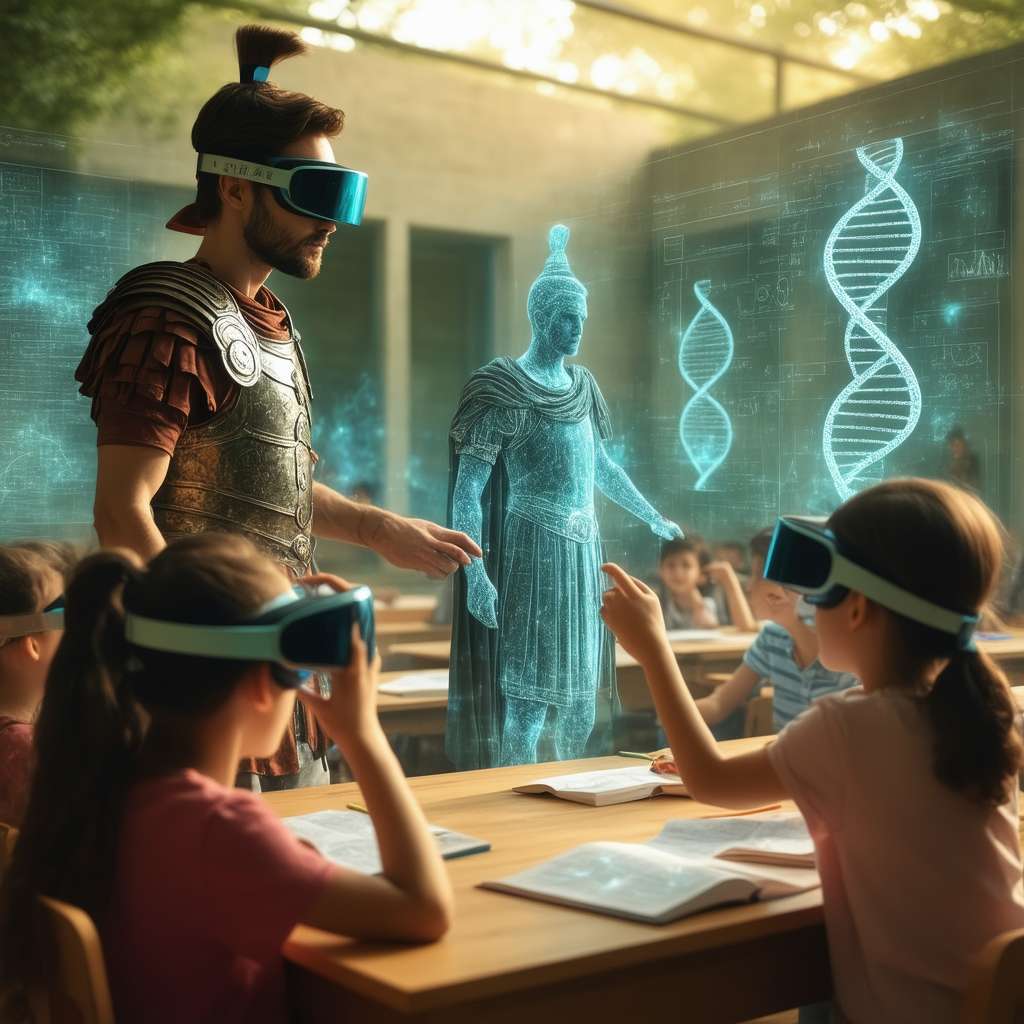

Didattica Multidisciplinare: La Chiave per un Futuro Responsabile

La complessità delle sfide etiche e legali richiede un approccio integrato e multidisciplinare nello sviluppo dei sistemi di IA in sanità. È fondamentale promuovere la ricerca e l’introduzione di una didattica innovativa, attualmente carente. In quest’ottica, si potrebbero considerare diverse strategie formative di tipo multidisciplinare. L’attivazione di percorsi formativi specifici per medici, ingegneri e ricercatori, che includano nozioni di bioetica, medicina legale e regolamentazione dell’IA, sarebbe un passo importante. L’istituzione di Master Universitari in “Intelligenza Artificiale Applicata in Sanità”, con la partecipazione di docenti di medicina, ingegneria informatica, biostatistica e diritto sanitario, potrebbe favorire una maggiore conoscenza e consapevolezza delle potenzialità e criticità di questa tecnologia. L’introduzione nei corsi di Laurea in Medicina di moduli dedicati all’IA, focalizzati non solo sugli aspetti tecnici ma anche sulle implicazioni etiche e giuridiche, è altrettanto auspicabile. Un potenziamento della sinergia tra sviluppatori e professionisti della salute potrebbe realizzarsi mediante l’istituzione di gruppi multidisciplinari ed implementando approcci innovativi di co-progettazione. Tale iniziativa assicurerebbe che le finalità cliniche e le richieste dei pazienti rimangano una priorità nel progresso delle tecnologie sanitarie.

Regolamentazione e Standard: Un Quadro Normativo Essenziale

Il veloce progresso tecnologico impone interrogativi fondamentali sui temi della regolamentazione, nonché sulla salvaguardia sia dei dati che della privacy. È imprescindibile stabilire linee guida precise relative alla validità e alla certificabilità dei sistemi d’intelligenza artificiale, con un’attiva partecipazione di autorità competenti ed organismi scientifici. Un altro aspetto essenziale consiste nell’attuare controlli regolari sui meccanismi algoritmici al fine di accertarne l’aderenza alle prescrizioni deontologiche oltre che legali; pertanto risulta altresì indispensabile potenziare le strategie a protezione delle informazioni gestite. Questi elementi si rivelano determinanti per garantire lo sviluppo responsabile ed eticamente valido degli algoritmi.

Verso un Futuro Consapevole: Responsabilità e Umanità al Centro

La diffusione dell’intelligenza artificiale nel settore sanitario si configura come una vera e propria rivoluzione, capace di offrire opportunità straordinarie ma anche di esporre a pericoli considerevoli qualora non venga gestita correttamente. L’assenza di considerazioni riguardanti gli aspetti etici e le questioni legali da parte dei programmatori potrebbe minare profondamente la fiducia del pubblico verso queste tecnologie emergenti ed accentuare le disparità nell’accesso ai servizi sanitari. Pertanto, è imperativo abbracciare un metodo che coinvolga diverse discipline – dall’ingegneria alla medicina fino al diritto e alla bioetica – fin dalle prime fasi della creazione degli algoritmi stessi. Solo attraverso tale integrazione si riuscirà ad assicurare un utilizzo prudente dell’intelligenza artificiale che possa elevare standard qualitativi nelle cure mediche senza ledere i diritti primari dei pazienti. Perciò, il traguardo da perseguire dovrebbe mirare a forgiare un contesto nel quale l’IA serva ad esaltare il valore umano insito nella pratica medica anziché sostituirlo del tutto.

Oltre la Tecnica: Un’Armonia tra Intelligenza Artificiale e Umana

L’impatto dell’intelligenza artificiale sulla pratica medica si rivela sempre più significativo grazie alle sue elevate capacità analitiche e predictive. Tuttavia, cosa comporta realmente questa evoluzione per noi medici e i nostri pazienti? Consideriamo un orizzonte prossimo caratterizzato dall’integrazione dell’IA nelle procedure diagnostiche: ciò permetterebbe una valutazione assai più rapida ed esatta delle malattie, una progettazione su misura dei percorsi terapeutici e un anticipato riconoscimento dei cambiamenti nel decorso clinico. Una dimensione futura in cui potremmo concentrare le nostre energie sull’ascolto attento verso ogni paziente mentre delegando a tecnologie avanzate le mansioni ordinarie o intricate.

Affinché si possa apprezzare realmente il contributo innovativo dell’IA nell’ambito medico è essenziale familiarizzare con principi chiave del suo funzionamento. In questo contesto spicca sicuramente il machine learning, ramificazione specifica della disciplina informatica capace di consentire ai sistemi computazionali la capacità d’apprendere autonomamente dai dataset senza indicazioni dirette programmatiche. Attraverso questa metodologia avanzata questi sistemi sono capaci non solo d’analizzare ampie serie storiche di dati sanitari ma anche di identificare modelli complessi insieme a connessioni invisibili all’occhio umano stesso; tali scoperte risultano quindi cruciali per fornire supporto decisivo nelle fasi diagnostiche e terapeutiche del nostro lavoro quotidiano. Un argomento significativamente più sofisticato concerne le reti neurali profonde, le quali rappresentano modelli computazionali che si ispirano alla complessità del funzionamento cerebrale umano. Tali strutture sono capaci di assorbire informazioni intricate dai dati ed elaborare soluzioni a problematiche altrimenti insormontabili con le metodologie tradizionali nel campo del machine learning. In ambito sanitario, si utilizzano per esaminare immagini cliniche, formulare diagnosi mediche e facilitare lo sviluppo terapeutico attraverso nuovi farmaci.

Nonostante gli elementi strettamente tecnici siano rilevanti, è imprescindibile considerare anche le conseguenze etiche e sociali dell’intelligenza artificiale all’interno della medicina contemporanea. Quale strategia possiamo adottare per garantire che l’utilizzo dell’IA sia equo e responsabile? Quali misure dobbiamo implementare affinché venga preservata la privacy degli individui, evitando qualsiasi forma di discriminazione tramite algoritmi? Si tratta pertanto di interrogativi fondamentali che necessitano una risposta condivisa; solo così potremo edificare una realtà futura in cui l’IA funzioni come alleato della società umana piuttosto che come sua padrona. Il compito consiste nel bilanciare progressività tecnologica con i principi cardine della professione medica: empatia umana, cura appassionata e rispetto verso ogni singolo essere umano.