Un cambiamento epocale si staglia nel futuro del mondo del lavoro, stimolato non solo dall’inesorabile avanzata dell’intelligenza artificiale (AI), ma anche da dinamiche demografiche e progressi tecnologici in continua evoluzione. Il Future of Jobs Report 2025, elaborato dal World Economic Forum (WEF), offre un’analisi dettagliata della situazione attuale: mentre l’automazione minaccia la sicurezza di alcune professioni consolidate, allo stesso tempo crea nuove opportunità per chi sarà pronto ad adattarsi e ad acquisire le competenze richieste nel mercato emergente.

L’Impatto dell’AI: Tra Perdita di Posti di Lavoro e Nuove Opportunità

Le proiezioni del WEF suggeriscono che, entro la fine del decennio, l’AI genererà circa 170 milioni di nuovi posti di lavoro. Queste posizioni saranno principalmente connesse all’analisi di grandi quantità di dati, all’ingegneria finanziaria tecnologica e all’apprendimento automatico. Tuttavia, l’introduzione dell’automazione potrebbe comportare l’eliminazione di circa 92 milioni di posizioni nello stesso periodo, colpendo in particolare le mansioni di ufficio e quelle amministrative.

Questa dualità genera una sensazione di inquietudine generalizzata tra i lavoratori, denominata “Fobo” (Fear of Becoming Obsolete), alimentata dalla paura di essere rimpiazzati dalle macchine. Un’indagine condotta da Gallup ha messo in luce un aumento nella percentuale di impiegati preoccupati per il sorpasso da parte della tecnologia, passando dal 15% nel 2021 al 22% nel 2025.

La Riqualificazione come Chiave per il Futuro

Per affrontare questa problematica, è cruciale investire nell’aggiornamento professionale continuo dei lavoratori. Le aziende stanno avviando programmi di upskilling e reskilling con l’obiettivo di preparare il personale alle nuove sfide. Tra gli esempi si trovano piattaforme di formazione interne con corsi specifici sull’AI generativa e pratiche come il “reverse mentoring”, in cui i dipendenti più giovani assistono i colleghi con maggiore esperienza nell’uso delle tecnologie innovative.

L’OCSE stima che entro il 2030, il 63% della forza lavoro dovrà aggiornare le proprie abilità almeno una volta ogni cinque anni. La capacità di imparare costantemente è diventata un requisito essenziale per preservare la propria posizione nel mercato del lavoro.

Parallelamente alle competenze tecniche, le soft skill assumono un’importanza sempre maggiore. *La capacità di ragionamento analitico, l’abilità di gestire problematiche complesse, l’ingegno creativo e l’acutezza emotiva sono qualità sempre più valorizzate. Il “Future of Jobs Report 2025” evidenzia che, sebbene le competenze tecnologiche siano di fondamentale importanza, quelle trasversali svolgono un ruolo essenziale nel garantire l’adattabilità dei lavoratori.

Dinamiche Demografiche e Disuguaglianze

Le trasformazioni nella struttura demografica hanno un impatto significativo sul contesto lavorativo globale. Da un lato, l’invecchiamento progressivo delle popolazioni nelle nazioni sviluppate determina una diminuzione della disponibilità di forza lavoro; dall’altro, nei paesi con economie in via di sviluppo si osserva un aumento significativo tra i giovani.

Come evidenziato dalle stime fornite dal WEF, si prevede che nel prossimo futuro – precisamente entro il 2035 – ben il 40% dei lavoratori europei supererà la soglia dei 50 anni, contrariamente all’Africa dove si attenderà una condizione opposta con oltre il 60% degli individui al di sotto dei 25 anni. Tale disparità generazionale comporterà ripercussioni significative nel contesto occupazionale.

Sebbene la digitalizzazione rappresenti uno strumento prezioso per affrontare tali sfide demografiche e limitare gli squilibri già presenti, diviene indispensabile monitorarne gli effetti affinché non aggravino le disparità socio-economiche. Pertanto, è fondamentale investire nell’implementazione di infrastrutture tecnologiche adeguate e nell’attivazione di programmi formativi specifici che permettano a tutti i membri della società di accedere alle nuove opportunità generate dalla rivoluzione digitale.

Navigare l’Incertezza: Un Imperativo per il Futuro del Lavoro

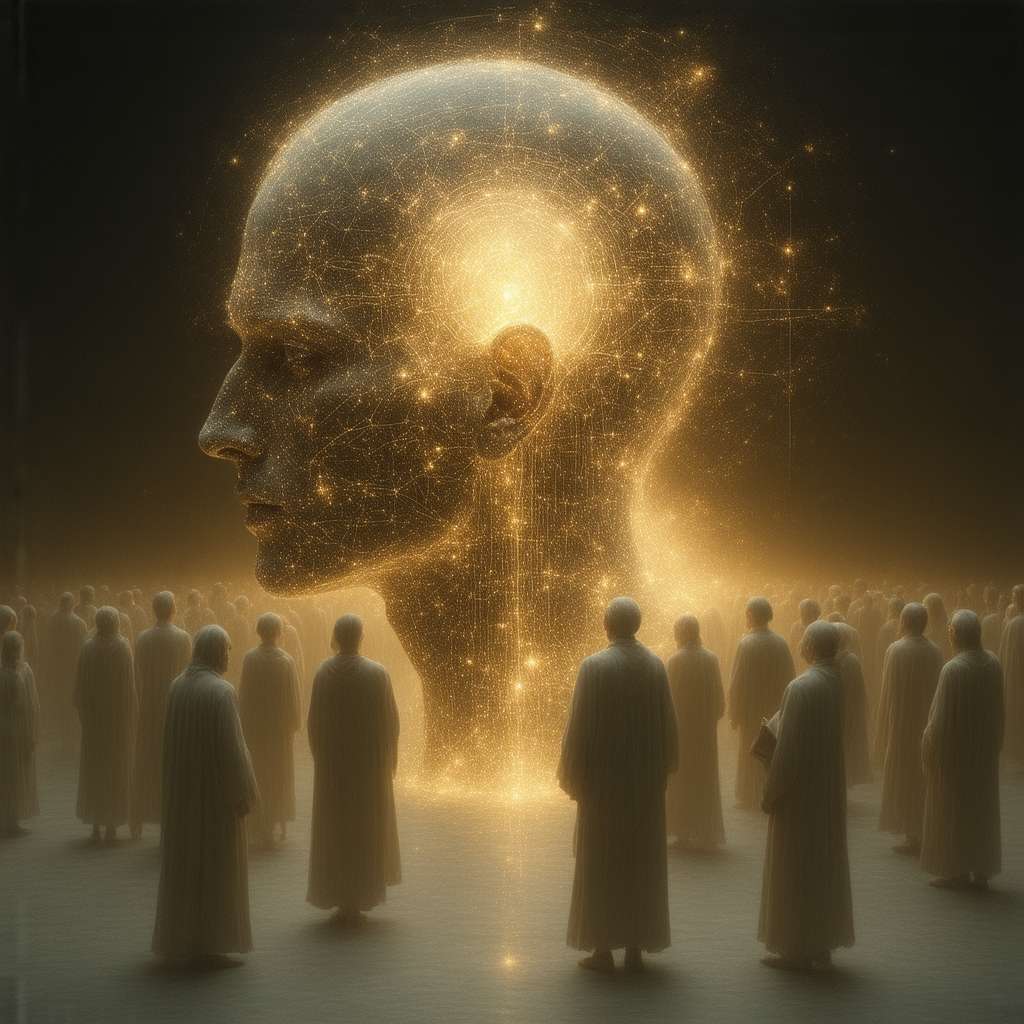

L’orizzonte professionale è avvolto nell’incertezza; tuttavia, vi è una certezza che si fa strada: l’importanza cruciale della riqualificazione e dell’adattamento. Affinché possa svilupparsi un contesto fruttuoso durante questa era di cambiamenti radicali, è fondamentale che esista una sinergia tra aziende, istituzioni governative e individui. Ciò garantirà a ogni persona la chance necessaria per apprendere quelle competenze vitali richieste per navigare tra sfide impreviste e opportunità emergenti. In quest’ottica, diventa evidente come la facoltà di apprendimento continuo, insieme alla predisposizione all’adattamento e all’innovazione, sarà determinante nel delineare i successi futuri nel mondo lavorativo.

Verso un Nuovo Umanesimo Tecnologico: La Centralità dell’Individuo nell’Era dell’AI

In tale scenario caratterizzato da cambiamenti profondi e incessanti, risulta vitale non trascurare mai l’importanza dell’individuo nel suo complesso. Sebbene l’intelligenza artificiale emerga come uno strumento dalle potenzialità notevoli, essa deve costantemente operare nell’interesse della collettività anziché esserne dominata. Appare necessario dar vita a una forma rinnovata di umanesimo tecnologico, dove si verifica una simbiotica fusione tra competenze umane e innovazioni tecniche; ciò porterà alla costruzione di future modalità occupazionali maggiormente inclusive e ecologicamente responsabili.

Riflettiamo insieme per un attimo su queste informazioni che ci sono state presentate: quest’articolo discute dettagliatamente del lavoro in continua evoluzione odierno, ponendo sotto i riflettori il crescente protagonismo dell’intelligenza artificiale al suo interno. Una nozione chiave relativa all’AI pertinente a tale argomento è quella del machine learning. Essa definisce la capacità intrinseca delle macchine nella loro interazione con i dati senza necessitare di indicazioni programmatiche esplicite; questo comporta che tali sistemi siano abilitati ad eseguire mansioni ripetitive con efficienza ed elasticità nell’affrontare novità emergenti sul mercato del lavoro – scenario dove vecchi ruoli possono cadere in disuso ma nuovi percorsi professionali possono fiorire simultaneamente. Non limitatevi a considerare solo quanto già esaminato. Un tema emergente con crescente rilevanza è l’AI etica. Ci si riferisce alla necessità di progettare sistemi di intelligenza artificiale caratterizzati da trasparenza, responsabilità, e allineati ai principi fondamentali dell’umanità. Con la continua automazione degli ambienti lavorativi, risulta cruciale assicurarsi che l’intelligenza artificiale non produca discriminazioni né alimenti disparità sociali; deve invece essere indirizzata verso obiettivi volti al bene collettivo*.

Incoraggio ciascuno di voi ad approfondire la preparazione verso questo orizzonte in evoluzione. Che competenze sarete pronti ad apprendere? In quale modo potrete partecipare attivamente alla costruzione di un contesto lavorativo più giusto e sostenibile? Le risposte sono nelle vostre mani.