I dispositivi indossabili, arricchiti dall’intelligenza artificiale, stanno mutando in modo sostanziale l’ambiente di lavoro. La loro ampia adozione solleva domande cruciali riguardo sia al miglioramento della security, sia alla gestione del diritto alla privacy dei soggetti impiegati nelle attività aziendali.

Questi strumenti tecnologici sono in grado di monitorare costantemente le condizioni fisiche e psichiche dei dipendenti. Ciò nonostante, sorgono preoccupazioni tangibili in relazione ai confini tra una protezione accettabile e una lesione ingiustificata della sfera privata dei lavoratori.

Mentre alcuni affermano che l’utilizzo esteso dei dispositivi indossabili incrementi l’efficienza produttiva e funga da protezione in contesti a elevato rischio, i critici manifestano forti apprensioni per i possibili utilizzi illeciti derivanti dalla mancanza di una regolamentazione sull’uso dei dati; questa tecnologia, se adoperata in maniera errata, potrebbe trasformarsi in un meccanismo legale destinato a sottoporre i dipendenti a forme continue di controllo!

Dibattito fra Privacy e Salvaguardia Professionale

- Cura della Salute: In ambito professionale, si punta a scongiurare incidenti tramite metodologie d’avanguardia;

- Cattura dell’Intimità: Anche con le migliori premesse, si può presentare il rischio di violare i diritti individuali;

Di fronte a tale complessità, è essenziale meditare sullo scopo principale nell’integrare questo avanzamento tecnologico nelle moderne strutture aziendali!

L’avvento degli ai wearables nel mondo del lavoro

Nell’era odierna, contraddistinta da una rapida progressione tecnologica, l’intelligenza artificiale è sempre più integrata in diversi settori della vita quotidiana. Tra le innovazioni più importanti che generano un ampio dibattito, emerge l’ingresso degli AI wearables nel campo della sicurezza sul lavoro. Questi dispositivi indossabili, provvisti di sensori avanzati e alimentati da algoritmi all’avanguardia IA, promettono non solo un’evoluzione nel monitoraggio delle condizioni lavorative, ma sollevano anche questioni fondamentali riguardo alla privacy individuale, agli aspetti legati alla sorveglianza e ai rischi associati a potenziali utilizzi discriminatori delle informazioni raccolte.

Gli AI wearables rappresentano, dunque, una frontiera innovativa nella protezione del personale impiegato, rendendo possibile il tracciamento istantaneo dello stato fisico, movimenti, postura e esposizione a sostanze nocive. Tuttavia, una diffusione allargata impone una valutazione oculata dei profili di rischio e dei benefici, unitamente all’istituzione di norme definitive che garantiscano i diritti essenziali dei lavoratori, preservandone la dignità.

Il progresso della tecnologia applicata agli AI wearables è inarrestabile; ci troviamo di fronte a sensori sempre più miniaturizzati e algoritmi dotati di una sofisticazione crescente. I dispositivi sviluppati oggi possiedono una sorprendente capacità nel raccogliere un’ampia gamma di informazioni che include:

-

Postura e movimenti: I dispositivi, forniti di sensori appositamente progettati, analizzano le posizioni del corpo; essi riconoscono posture scorrette, schemi comportamentali ripetitivi o episodi di caduta, contribuendo così a evidenziare eventuali rischi associati a lesioni muscolo-scheletriche. Questo aspetto è particolarmente rilevante nei settori industriali dell’edilizia, nell’agricoltura consapevole delle sue peculiarità fisiologiche, così come nella logistica, dove il personale è spesso sottoposto a un’intensità fisica significativa.

- I livelli di stress: Diverse soluzioni biometriche tracciano parametri vitali, fra cui il battito cardiaco e la temperatura corporea, nonché altre metriche indicative dello stato d’animo sotto pressione.

Grazie all’analisi dei dati acquisiti dal corpo umano, è possibile emettere avvisi sui segnali precursori di affaticamento o sull’insorgenza del sovraccarico psico-fisico.

Questa caratteristica appare decisiva negli ambienti lavorativi estremamente esigenti – come quelli degli ospedali, nelle centrali energetiche moderne o nei complessi produttivi – dove gli individui subiscono sfide giornaliere legate ai turni lunghi e alle alte responsabilità.

Esposizione a sostanze pericolose: il monitoraggio attraverso sensori chimici consente l’individuazione della presenza di gas tossici, polveri sottili oppure radiazioni. Questi strumenti avvisano gli addetti ai lavori riguardo ai possibili rischi ambientali. La loro implementazione risulta imprescindibile in ambiti come l’industria chimica, mineraria e nella gestione dei rifiuti; qui gli impiegati sono spesso soggetti a contatti con elementi nocivi che possono mettere seriamente a repentaglio la loro salute.

I dati ottenuti vengono sottoposti a un’analisi continua condotta da sofisticati algoritmi basati su I. A., capaci d’identificare anomalie ed eventi rischiosi; tali sistemi emettono quindi notifiche tempestive agli operatori o ai responsabili del sito. Un simile meccanismo d’allerta anticipata riveste grande importanza nella prevenzione sia degli incidenti che degli infortuni sul lavoro; grazie ad esso è possibile costruire uno spazio operativo molto più sicuro.

Inoltre, gli AI wearables stanno espandendosi anche perché possono essere integrati efficacemente con una pluralità di altre misure anti-infortunistiche: ciò include telecamere, strumentazioni sul campo ambientale oltreché sistemi volti al controllo dell’accesso nelle varie aree aziendali.

L’integrazione proposta offre la possibilità di realizzare un sistema che sia totale e sinergico, capace non solo di sorvegliare l’ambiente lavorativo, ma anche di reagire in maniera efficace nel momento in cui si verifichi un’emergenza.

I benefici concreti e le applicazioni reali

L’integrazione degli AI wearables offre numerosi vantaggi pratici che meritano attenzione. Innanzitutto, la loro funzione nel diminuire gli incidenti occupazionali; ciò è possibile grazie all’abilità di analizzare in tempo reale sia le condizioni circostanti sia i parametri fisici degli operatori stessi. Attraverso l’analisi predittiva – alimentata da un insieme robusto di dati storici ed attuali – è fattibile prevedere possibili minacce e agire strategicamente prima che possano sfociare in situazioni compromettenti.

Un altro aspetto positivo riguarda il potenziamento della sicurezza sanitaria dei dipendenti. Gli AI wearables, infatti, riescono a captare alterazioni significative nei segni vitali, quali la frequenza cardiaca o la temperatura corporea; questo permette interventi tempestivi dinanzi ai primi indizi di affaticamento fisico o pericoli imminenti. Allo stesso tempo, tali strumenti tecnologici hanno la capacità d’individuare esposizioni a materiali nocivi, notificando il personale su probabili condizioni ambientali rischiose.

La funzionalità dei AI wearables non si limita alla prevenzione delle problematiche, ma abbraccia anche aspetti legati all’ottimizzazione delle performance operative.

L’ ‘analisi dei dati’, unitamente alla loro raccolta sistematica, consente una profonda ottimizzazione nei processi lavorativi; si riescono così a identificare potenziali aree da migliorare, mentre i dipendenti ricevono indicazioni personalizzate riguardo alle proprie performance.

A tal proposito, emerge chiaramente l’esperienza significativa che coinvolge AIRBUS, noto protagonista del comparto aeronautico. Per sostenere il processo d’assemblaggio dei sedili passeggeri, AIRBUS ha integrato degli smart glasses che guidano gli operatori con istruzioni visive contestualizzate, accompagnate da strumenti interattivi, quali scanner per codici a barre oltre a funzionalità basate sulla realtà aumentata. Questi gadget moderni forniscono istantaneamente le informazioni necessarie al fine di contrassegnare correttamente il pianale dell’aereo, minimizzando ogni possibile errore umano. L’incredibile risultato ottenuto? Una straordinaria crescita della produttività pari al 500%, accanto a un indice d’errore praticamente nullo. Tale studio dimostra chiaramente come gli AI wearables diano una spinta rilevante all’affidabilità nelle operazioni, diminuendo altresì la loro complessità intrinseca, contribuendo pertanto alla creazione di spazi lavorativi decisamente più sicuri ed efficienti.

Un’altra applicazione interessante degli AI wearables è rappresentata dalla “maglietta smart” sviluppata da ACEA, azienda italiana attiva nel settore dei servizi pubblici. Questa maglietta, dotata di sensori per monitorare i parametri bio-vitali e ambientali dei lavoratori, funziona come un holter non invasivo e potrebbe portare a una prevenzione più efficace degli incidenti dovuti a stanchezza o disattenzione, oltre all’identificazione precoce di patologie. Questo progetto, che coinvolge oltre 400 lavoratori, rappresenta un passo significativo verso un nuovo concetto di tutela e prevenzione sul lavoro.

L’adozione degli AI wearables può anche contribuire a migliorare la formazione dei lavoratori. Grazie alla realtà aumentata e alla realtà virtuale, è possibile creare simulazioni realistiche di situazioni di rischio, consentendo ai lavoratori di apprendere le procedure di sicurezza in un ambiente sicuro e controllato. Un approccio formativo caratterizzato da immersione profonda può elevare la cognizione riguardo ai pericoli, potenziando nel contempo la prontezza dei dipendenti nell’affrontare situazioni critiche.

Rischi etici e legali: la sottile linea tra protezione e sorveglianza

Pur evidenziando molteplici benefici associati agli AI wearables, emergono con forza questioni etiche e giuridiche rilevanti che meritano profonda attenzione. In particolare, l’idea della sorveglianza incessante accompagnata da una raccolta massiva di dati privati comporta seri rischi legati all’uso potenzialmente discriminatorio delle informazioni stesse; tali problematiche impongono un’analisi accurata, così come lo sviluppo di normative appropriate.

Tra i timori principali si annovera certamente quello riguardante l’invasività sulla privacy individuale dei dipendenti. I dispositivi indossabili basati su intelligenza artificiale sono in grado di accumulare diverse categorie d’informazioni sensibili – sanitarie sì, ma anche relative ai comportamenti quotidiani – inserendo quindi le persone in database che potrebbero trasformarsi in strumenti per scopi inusuali o impropri: dal controllo delle performance alle decisioni nella gestione del personale, fino alla creazione di profili dettagliati degli operatori stessi.

Inoltre, sussiste una grave inquietudine relativa al concetto stesso della vigilanza continua. Questo tipo persistente d’osservazione può generare ambienti lavorativi oppressivi ed ansiogeni, con ricadute significative sull’autonomia professionale degli individui coinvolti nonché sulla loro libertà espressiva. Inoltre, la sorveglianza costante potrebbe minare la fiducia tra lavoratori e datori di lavoro, creando un clima di sospetto e di diffidenza.

Il potenziale utilizzo discriminatorio dei dati raccolti rappresenta un altro rischio da non sottovalutare. Se i dati sugli AI wearables vengono utilizzati per valutare le prestazioni dei lavoratori, identificare dipendenti “a rischio” o prendere decisioni discriminatorie, si potrebbe creare una situazione di ingiustizia e di disuguaglianza. Ad esempio, un lavoratore potrebbe essere penalizzato per aver mostrato segni di stress o affaticamento, anche se questi non hanno influito sulla sua capacità di svolgere il lavoro.

Il quadro normativo italiano ed europeo in materia di AI wearables e sicurezza sul lavoro è ancora in fase di sviluppo. Il GDPR (Regolamento Generale sulla Protezione dei Dati) stabilisce principi fondamentali per la protezione dei dati personali, ma la loro applicazione specifica al contesto degli AI wearables richiede un’interpretazione attenta e una regolamentazione più dettagliata. Mi scuso, ma sembra che non ci sia un testo ricevuto per l’elaborazione. Ti invito a fornire il contenuto desiderato affinché io possa procedere con la richiesta. La necessità di un approccio responsabile implica l’adozione di criteri quali la trasparenza, il consenso, la limitazione, la sicurezza ed etica nel contesto della tecnologia.

Verso un futuro del lavoro più sicuro e sostenibile

I dispositivi AI wearables, considerati come innovativi strumenti tecnologici destinati a migliorare la protezione nei luoghi di lavoro, richiedono tuttavia una strategia d’adozione che sia informata e prudente. Risulta essenziale stabilire una simmetria tra i benefici auspicabili e le insidie etiche o giuridiche ad esse correlate; in tal modo è possibile garantire che questi strumenti siano orientati al benessere umano piuttosto che al contrario.

Principi cardine quali trasparenza, consenso esplicito da parte degli utenti e limitazioni all’utilizzo della tecnologia stessa nella sfera lavorativa affinché venga usata in maniera controllata sono indispensabili per assicurare impieghi responsabili degli AI wearables. Per costruire prospettive occupazionali future contraddistinte da maggiore sicurezza ed equità sociale risulterà necessario attuare dialoghi proficui insieme a normative appropriate.

Non bisogna dimenticare poi come gli AI wearables non possano essere considerati soluzioni definitive ai problemi esistenti nel campo della sicurezza professionale. Infatti, tali tecnologie necessitano di essere parte integrante di strategie più ampie dedicate alla prevenzione; ciò include iniziative formative rivolte ai lavoratori stessi, oltre alla valutazione accurata delle situazioni rischiose unitamente all’applicazione rigorosa delle relative procedure protettive.

Il testo è già leggibile e non necessita di correzioni.

Considerazioni finali: il ruolo dell’intelligenza artificiale e la responsabilità umana

La comparsa degli AI wearables all’interno del panorama lavorativo ci induce a considerare seriamente l’impatto dell’intelligenza artificiale sulle dinamiche professionali e sull’assunzione delle responsabilità da parte dell’individuo. Tali dispositivi offrono vantaggi tangibili per quanto riguarda la sicurezza e l’efficienza lavorativa; tuttavia, emergono interrogativi pertinenti legati a questioni di privacy, monitoraggio attento dei dipendenti e all’uso potenzialmente discriminatorio delle informazioni acquisite. Pertanto, è imprescindibile affrontare queste problematiche con un punto di vista etico ben definito, assicurandosi che la tecnologia serva le esigenze umane anziché dominarle.

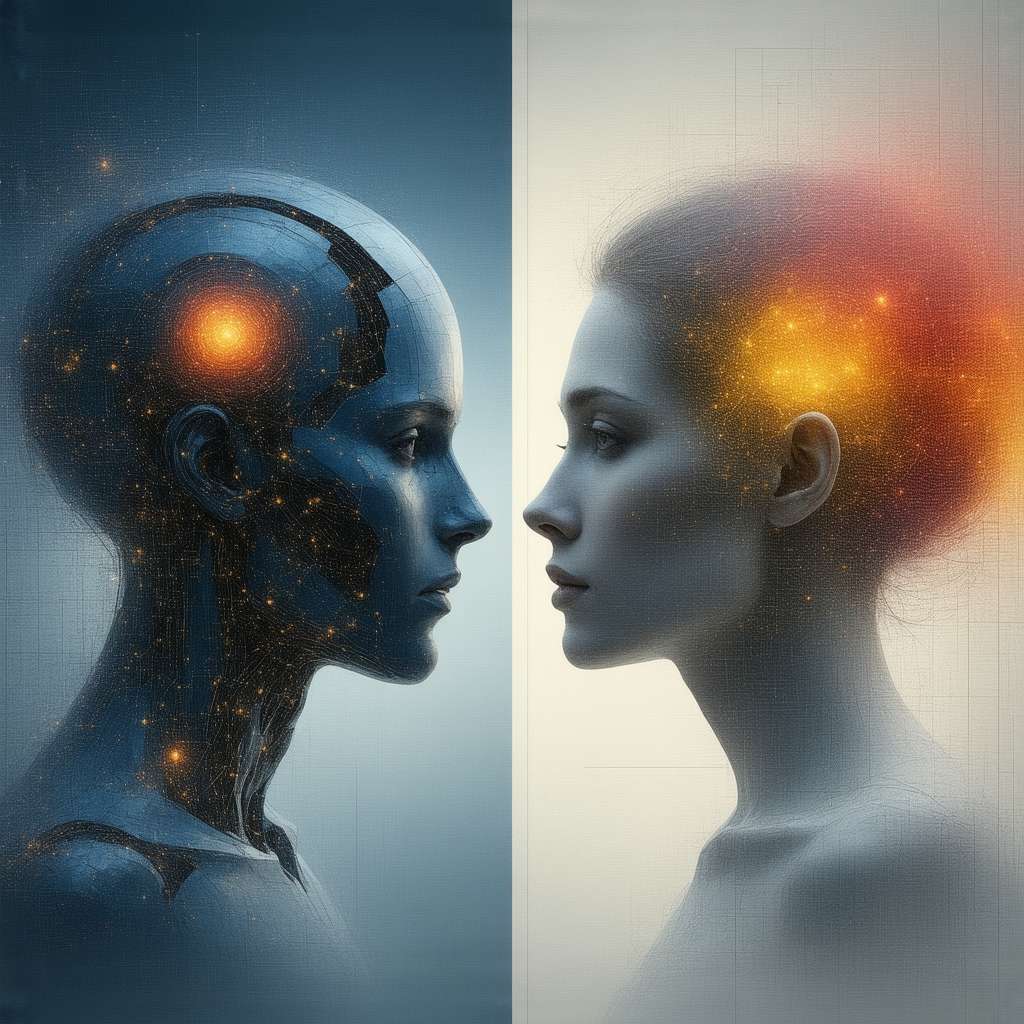

Affinché si possa penetrare nel meccanismo operativo degli AI wearables, diventa cruciale acquisire familiarità con alcune nozioni basilari relative all’intelligenza artificiale stessa. In particolare, spicca il concetto di machine learning, attraverso cui i sistemi informatici sono capaci d’imparare autonomamente dai dati ricevuti senza richiedere una programmazione diretta. Nel caso specifico degli AI wearables, tale metodologia trova applicazione nell’analisi dei dati estratti dai sensori volti a individuare anomalie o condizioni rischiose.

Ad esempio, un algoritmo di machine learning potrebbe imparare a riconoscere i segni di affaticamento di un lavoratore, analizzando i dati relativi alla frequenza cardiaca, alla temperatura corporea e ai movimenti.

Un concetto di intelligenza artificiale più avanzato, applicabile al tema degli AI wearables, è il deep learning. Questa tecnica, basata su reti neurali artificiali con molti strati (da cui il termine “deep”), consente ai computer di apprendere pattern complessi e di prendere decisioni più accurate. Nel contesto degli AI wearables, il deep learning potrebbe essere utilizzato per analizzare i dati provenienti da molteplici sensori e per prevedere il rischio di incidenti con maggiore precisione. Ad esempio, un algoritmo di deep learning potrebbe combinare i dati relativi alla postura, ai movimenti, ai livelli di stress e all’esposizione a sostanze pericolose per valutare il rischio di infortunio di un lavoratore in un determinato ambiente di lavoro.

L’introduzione delle tecnologie basate sull’intelligenza artificiale porta con sé interrogativi cruciali: chi assume la responsabilità per le scelte effettuate dagli algoritmi? Si tratta del datore di lavoro, dello sviluppatore software o dei dipendenti stessi? Fornire una risposta definitiva a questo quesito è complesso ed esige un’analisi approfondita sotto gli aspetti etici e normativi. Risulta essenziale garantire che le scelte effettuate tramite algoritmo siano chiare, accessibili alla comprensione degli individui coinvolti e oggetto della possibilità d’impugnazione; è necessario altresì tutelare il diritto dei lavoratori ad accedere ai propri dati personali nonché a contestarne l’uso.

Infine, gli AI wearables, sebbene si presentino come strumenti innovativi per aumentare la sicurezza negli ambienti lavorativi, richiedono comunque un’attuazione ponderata e informata. Dobbiamo ricercare quella via mediana fra opportunità offerte dalla tecnologia stessa rispetto agli eventuali rischi sia giuridici sia etici; solo in questo modo possiamo assicurarci che l’evoluzione tecnologica restituirà benefici all’uomo piuttosto che relegarlo in secondo piano. Solo così potremo ambire a uno scenario professionale più saldo, equo, dando tanto valore alla dimensione umana nel contesto occupazionale.

Cari lettori, mi auguro che questa analisi abbia saputo offrirvi una visione esauriente riguardo agli AI wearables* in relazione alla sicurezza nell’ambito lavorativo. Abbiamo evidenziato come tale innovazione porti con sé significativi benefici; tuttavia, essa pone anche questioni etiche e legali di rilevante importanza. Pertanto è essenziale confrontarsi con questi temi in modo riflessivo e informato; solo così possiamo assicurarci che le tecnologie rimangano strumenti utili per l’umanità anziché finire per dominare il nostro operato quotidiano. Non dimenticate: la tutela della sicurezza sui luoghi di lavoro costituisce un diritto imprescindibile per ogni individuo impegnato nel mondo professionale ed è nostro compito assicurarne la salvaguardia.

—– Questo programma, che coinvolge oltre 400 addetti, costituisce una pietra miliare verso una rinnovata concezione di protezione e profilassi nell’ambito lavorativo.

—–

Questo schema, che include un contingente di oltre quattrocento professionisti, traccia un segno distintivo verso una rinnovata filosofia di salvaguardia e prevenzione nel contesto lavorativo.