Ecco l’articolo riformulato, con le frasi richieste pesantemente parafrasate:

Tra Opportunità e Sfide Legali

Il settore audiovisivo sta vivendo una trasformazione epocale grazie all’avvento dell’intelligenza artificiale (IA). Questo cambiamento, tuttavia, solleva interrogativi cruciali riguardo alla tutela del diritto d’autore, alla paternità delle opere e al futuro del lavoro creativo. Recenti indagini e dibattiti evidenziano come i professionisti del settore riconoscano le potenzialità dell’IA come strumento di supporto, ma allo stesso tempo ne temano i rischi, in particolare la sostituzione del lavoro umano e l’uso non autorizzato di opere preesistenti per l’addestramento dei modelli.

Il Sondaggio Shock: La Voce degli Autori Italiani

Un sondaggio condotto tra 363 professionisti italiani del settore audiovisivo, tra cui sceneggiatori, adattatori e registi, ha rivelato una diffusa preoccupazione per l’impatto dell’IA. I risultati, presentati durante la rassegna “Da Venezia a Roma e nel Lazio”, offrono una fotografia chiara del rapporto tra IA e audiovisivo in Italia. Il timore principale è che l’IA possa sostituire il lavoro degli autori, erodendo la creatività umana e la qualità delle opere. Un altro punto critico riguarda l’utilizzo non autorizzato di opere preesistenti per l’addestramento dei modelli di IA, una pratica che solleva seri problemi di diritto d’autore. La mancanza di trasparenza nei processi generativi dell’IA è un ulteriore motivo di preoccupazione, poiché rende difficile tracciare l’origine delle opere e proteggere la paternità intellettuale.

La Reazione delle Istituzioni e degli Autori: Verso un Quadro Normativo Chiaro

Di fronte a queste sfide, le istituzioni e le associazioni di autori si stanno mobilitando per definire un quadro normativo chiaro e tutelare il diritto d’autore. La SIAE (Società Italiana degli Autori ed Editori) ha lanciato un grido d’allarme, sottolineando il rischio di una perdita di 22 miliardi di euro nei prossimi cinque anni per gli autori di musica e audiovisivo a causa dell’IA. La SIAE chiede che la futura legge sull’IA preveda la possibilità per gli autori di impedire preventivamente l’utilizzo delle proprie opere per l’addestramento delle macchine e una maggiore trasparenza sui processi di addestramento. In un passo significativo, il Senato ha introdotto una modifica alla normativa sul diritto d’autore legata all’IA, sancendo che la protezione legale può estendersi a un’opera co-creata con l’intelligenza artificiale solo se essa deriva da un contributo intellettuale distintamente umano. Questa legge rappresenta un primo passo importante, ma molti aspetti dovranno essere precisati con atti successivi.

Il Futuro dell’Audiovisivo: Un Ecosistema Equo e Trasparente

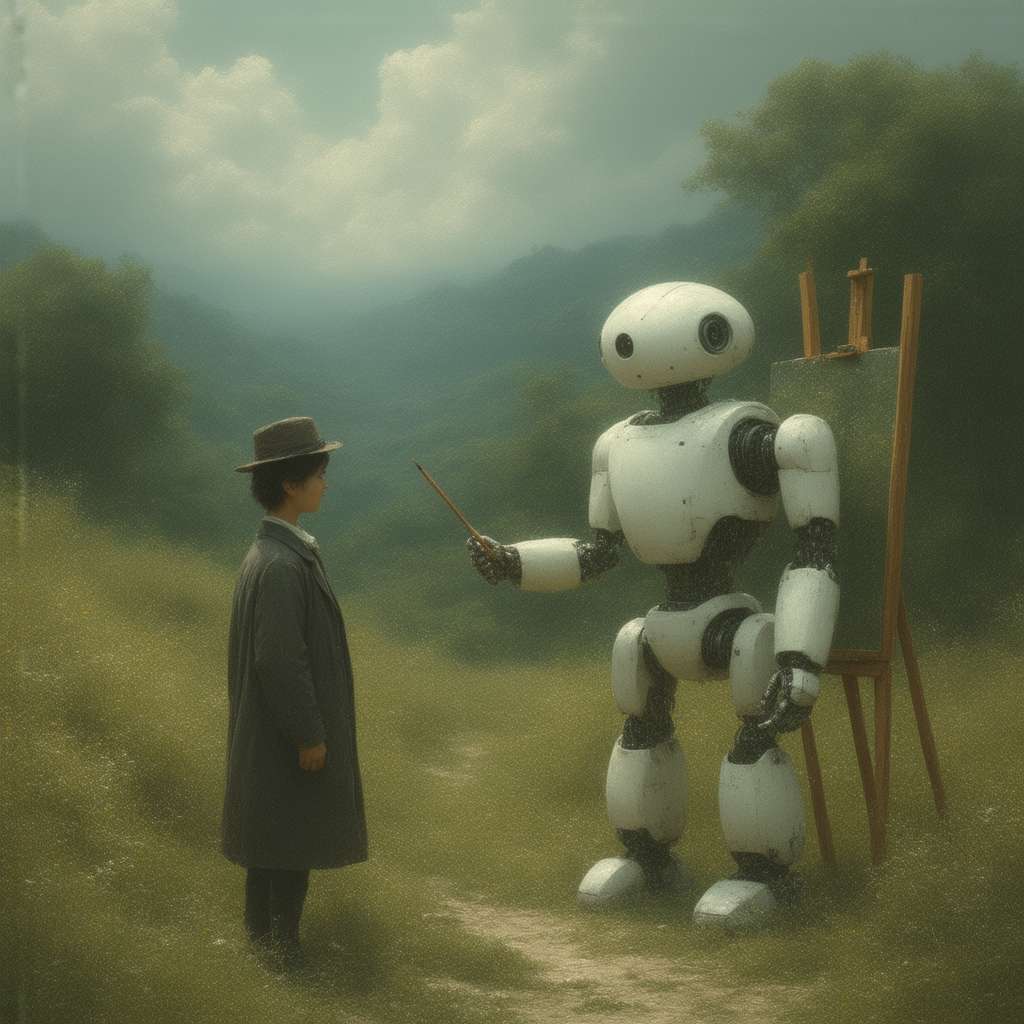

Il futuro del settore audiovisivo dipenderà dalla capacità di creare un ecosistema in cui l’IA sia uno strumento al servizio della creatività umana, e non un sostituto. Questo richiede un approccio antropocentrico, che metta al centro l’ingegno umano e la sua capacità di gestire la tecnica. Come ha affermato il presidente della Commissione Cultura della Camera, Federico Mollicone, l’innovazione deve essere messa al servizio della creatività, non in sua sostituzione. L’obiettivo primario è plasmare un contesto audiovisivo più giusto, concorrenziale e limpido, dove la tecnologia supporti, anziché rimpiazzare, la genialità umana. L’intelligenza artificiale presenta prospettive immense, ma al contempo solleva preoccupazioni concrete in merito alla salvaguardia della produzione creativa, dei professionisti e delle libertà fondamentali. È fondamentale definire regole concrete e criteri che consentano di distinguere tra creatività umana e processi algoritmici, evitando che algoritmi cancellino opere d’arte, piattaforme sfruttino la creatività senza compensi e si creino squilibri nei rapporti professionali.

Verso un Nuovo Rinascimento Digitale: Armonia tra Uomo e Macchina

La convergenza tra intelligenza artificiale e creatività umana non deve essere vista come una minaccia, bensì come un’opportunità per un nuovo rinascimento digitale. Un’era in cui la tecnologia amplifica le capacità espressive dell’uomo, consentendo la creazione di opere innovative e coinvolgenti. Tuttavia, per realizzare questa visione, è essenziale un approccio etico e responsabile, che metta al centro il rispetto del diritto d’autore, la tutela del lavoro creativo e la promozione di un ecosistema culturale equo e sostenibile. Solo così potremo garantire che l’IA diventi un motore di progresso per l’arte e la cultura, e non uno strumento di impoverimento e omologazione.

Amici lettori, riflettiamo un attimo. Avete mai sentito parlare di machine learning? È una branca dell’intelligenza artificiale che permette ai computer di imparare dai dati senza essere esplicitamente programmati. Nel contesto dell’articolo, il machine learning viene utilizzato per addestrare i modelli di IA che generano contenuti audiovisivi. Ma cosa succede se questi modelli vengono addestrati con opere protette da copyright senza il consenso degli autori? Ecco che entra in gioco la necessità di un quadro normativo chiaro e di un approccio etico all’utilizzo dell’IA.

E se vi dicessi che esiste un concetto ancora più avanzato, chiamato transfer learning? Questa tecnica permette di trasferire le conoscenze acquisite da un modello di IA in un determinato dominio a un altro dominio, accelerando il processo di apprendimento e migliorando le prestazioni. Immaginate di addestrare un modello di IA per riconoscere i volti umani e poi trasferire queste conoscenze a un modello che deve riconoscere i volti degli animali. Il secondo modello imparerà molto più velocemente grazie al transfer learning. Nel settore audiovisivo, il transfer learning potrebbe essere utilizzato per creare effetti speciali più realistici o per generare dialoghi più naturali. Ma anche in questo caso, è fondamentale garantire che i dati utilizzati per l’addestramento siano ottenuti in modo lecito e che i diritti d’autore siano rispettati.

La sfida che ci attende è quella di trovare un equilibrio tra innovazione tecnologica e tutela della creatività umana. Un equilibrio che richiede un dialogo aperto e costruttivo tra autori, istituzioni e industria, e un impegno comune per un futuro in cui l’IA sia uno strumento al servizio dell’arte e della cultura.