Ecco l’articolo completo con le frasi riformulate:

https://bulletdemoext.bullet-network.com/wp-content/uploads/2024/12/0’Analisi Approfondita tra Intelligibilità, Etica e Comprensibilità

L’intelligenza artificiale (IA) sta rapidamente evolvendo, permeando ogni aspetto della nostra società, dall’economia alla sanità, dalla finanza alla giustizia. Questa trasformazione solleva interrogativi fondamentali sulla natura dell’intelligenza, sulla sua comprensibilità e sulle implicazioni etiche del suo utilizzo. https://bulletdemoext.bullet-network.com/wp-content/uploads/2024/12/0 aspetto cruciale è la necessità di rendere l’IA intelligibile, ovvero capace di condividere concetti con gli esseri umani, specialmente quando i sistemi automatizzati prendono decisioni che influenzano significativamente la vita delle persone.

https://bulletdemoext.bullet-network.com/wp-content/uploads/2024/12/0 recente studio del MIT ha evidenziato come la comprensibilità dell’IA sia un parametro essenziale per valutarne l’efficacia concreta. A differenza degli approcci basati su “spiegazioni locali” che si concentrano su singoli dati di ingresso, il metodo sviluppato dal MIT si focalizza sull’intero set di dati, evidenziando quelli più rilevanti per interpretare le decisioni della macchina. L’utente gioca un ruolo centrale, verificando se le regole definite a partire dai dati evidenziati sono effettivamente applicabili e comprensibili.

Il nodo cruciale risiede nell’arduo compito di estrarre un significato semantico chiaro dalle complesse architetture delle reti neurali. Il significato intrinseco delle produzioni dell’IA è condizionato da elementi esterni, quali il contesto in cui è stata addestrata, le finalità dei suoi ideatori e lo scopo complessivo del sistema. Questa problematica è stata chiarita dall’esempio di Lucie, a cui un sistema automatico ha assegnato un punteggio di credito. Sebbene si possieda ogni dettaglio tecnico del procedimento, rimane arduo afferrare il motivo di quel punteggio e le sue ripercussioni concrete per la sua situazione.

Spiegabilità vs. Interpretabilità: https://bulletdemoext.bullet-network.com/wp-content/uploads/2024/12/0 Dilemma Chiave

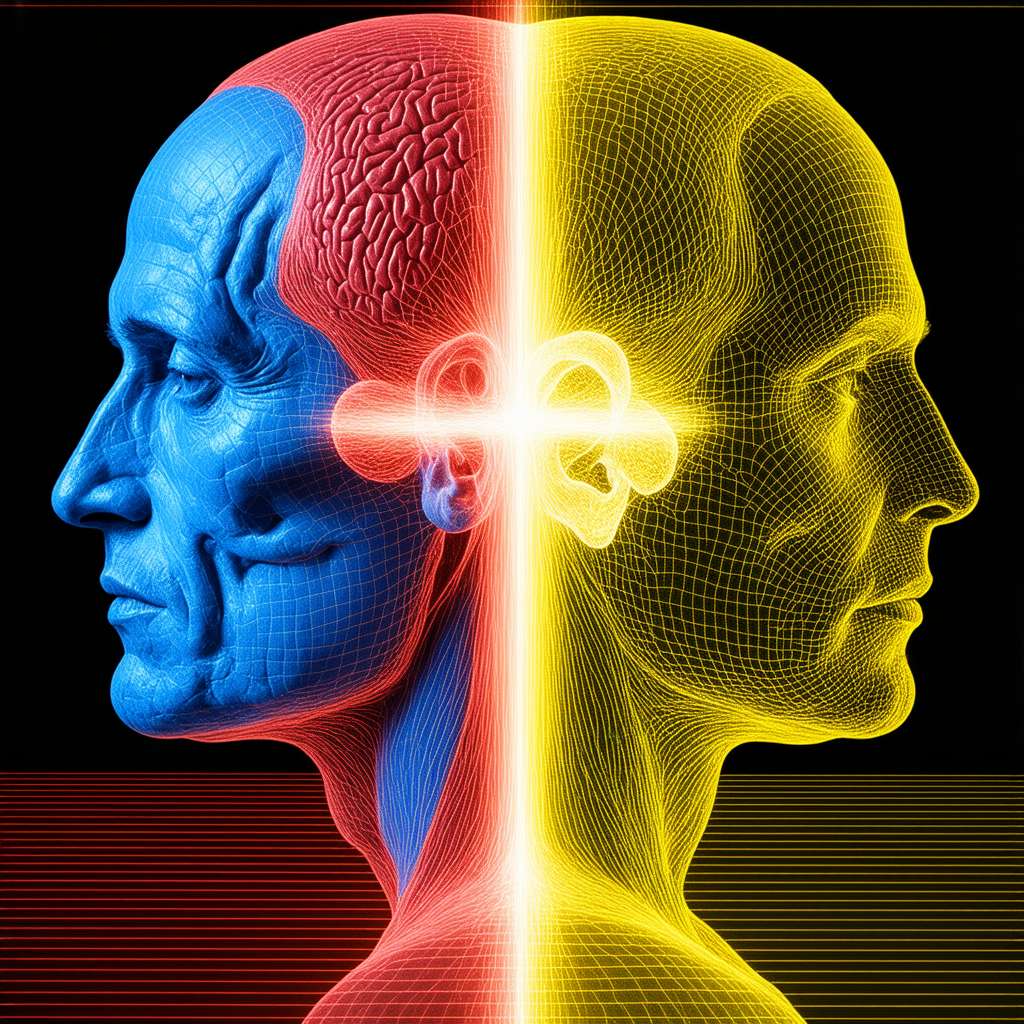

La spiegabilità e l’interpretabilità dell’IA sono due concetti distinti ma interconnessi. L’interpretabilità permette di comprendere i modelli di IA in modo semplice e trasparente, indipendentemente dal livello di esperienza dell’utente. La spiegabilità, invece, si applica ai modelli “black box”, consentendo ai data scientist e agli sviluppatori di fornire una spiegazione del perché i modelli si comportano in un determinato modo. In sostanza, l’interpretabilità si concentra sulla rappresentazione, mentre la spiegabilità si riferisce a un insieme più ampio di considerazioni che rendono un sistema di IA comprensibile agli utenti umani.

https://bulletdemoext.bullet-network.com/wp-content/uploads/2024/12/0 esempio classico di questa distinzione è rappresentato dai modelli di regressione nell’apprendimento automatico. I modelli trasparenti, come gli alberi decisionali, offrono una serie di decisioni esplicite che un umano può facilmente seguire. Per contro, i modelli “a scatola nera” possono contenere un’analisi statistica delle parole collegate a un determinato risultato, come l’approvazione di un prestito. In questo caso, l’interpretazione necessita di un procedimento separato per stabilire ciò che il sistema sta ricercando e quale peso attribuisce a specifiche parole.

La Commissione Europea ha riconosciuto l’importanza della spiegabilità dell’IA, includendola tra i principi chiave per un approccio europeo all’intelligenza artificiale. Il criterio decisionale di un sistema di IA deve essere controllabile, comprensibile e intellegibile per gli esseri umani. Questo principio si affianca ad altri fondamentali come la beneficenza, la non maleficenza, l’autonomia e la giustizia.

L’Etica dell’Intelligenza Artificiale: Principi e Rischi

L’etica dell’Intelligenza Artificiale (IA) è un ramo della filosofia che indaga le conseguenze economiche, sociali e culturali derivanti dallo sviluppo e dalla diffusione dei sistemi di intelligenza artificiale. Contrariamente a quanto si possa pensare, l’IA non possiede una propria coscienza, quindi non può essere “etica” in sé. Piuttosto, è necessario parlare di persone o aziende etiche che utilizzano l’IA in modo responsabile.

Luciano Floridi, filosofo ed esperto di etica dell’informazione, ha individuato 4+1 principi fondamentali per lo sviluppo etico dell’IA, basati sulla bioetica: beneficenza, non maleficenza, autonomia, giustizia ed esplicabilità. Questa ultima direttiva, la “spiegabilità”, è considerata un fattore abilitante per l’IA, in quanto ingloba sia la comprensibilità (rispondendo alla domanda “Come funziona?”) sia la responsabilità (rispondendo all’interrogativo “Chi è il responsabile del suo funzionamento?”).

Nonostante i benefici potenziali, l’IA presenta anche rischi significativi. L’uso dell’IA da parte dei cybercriminali, la propaganda e la disinformazione, le violazioni della privacy, i bias e le discriminazioni, e la difficoltà di individuare le responsabilità in caso di danni sono solo alcune delle preoccupazioni che emergono. Per mitigare questi rischi, è fondamentale adottare un approccio “etica by design”, includendo il rispetto dei principi etici nella definizione dei processi e delle procedure aziendali.

Verso un Futuro Responsabile: Governare l’Innovazione

La coesistenza tra uomo e macchina, in un ambiente di lavoro misto, richiede che le macchine “imparino” a collaborare con l’uomo nel rispetto della dignità umana. Paolo Benanti, teologo morale, suggerisce che le macchine cognitive dovrebbero essere in grado di apprendere almeno quattro elementi fondamentali: intuizione, intelligibilità dell’azione, adattabilità e adeguamento degli obiettivi. Questi elementi, se implementati correttamente, possono garantire che le macchine non solo non nuocciano all’uomo, ma sappiano tutelare la sua dignità e creatività.

Per integrare queste proprietà in sicurezza, sono necessari algoritmi di verifica indipendenti, capaci di misurare e certificare le doti di intuizione, intelligibilità, adattabilità e coerenza degli scopi. Questi algoritmi di valutazione devono essere concepiti autonomamente e affidati a organismi di certificazione terzi, che agiscano come garanti dell’intero processo. A sua volta, il governo è chiamato a definire un quadro operativo che sappia convertire la dimensione valoriale in strutture di standardizzazione, certificazione e supervisione, salvaguardando così la persona e il suo valore negli ambienti di lavoro ibridi.

In conclusione, l’intelligenza artificiale rappresenta una sfida etica e tecnologica complessa, che richiede un approccio multidisciplinare e una riflessione continua. Rendere l’IA intelligibile, comprensibile e responsabile è fondamentale per garantire che questa potente tecnologia sia utilizzata a beneficio dell’umanità, nel rispetto dei valori fondamentali della dignità, dell’autonomia e della giustizia.

Intelligenza Artificiale: https://bulletdemoext.bullet-network.com/wp-content/uploads/2024/12/0 Nuovo Rinascimento Umanistico?

L’intelligenza artificiale, con la sua capacità di elaborare dati e apprendere autonomamente, ci pone di fronte a una sfida cruciale: come integrare questa tecnologia nel tessuto della nostra società senza compromettere i valori che ci definiscono come umani? La risposta, forse, risiede in un nuovo rinascimento umanistico, in cui la tecnologia non è vista come un fine, ma come un mezzo per ampliare le nostre capacità, per promuovere la conoscenza e per migliorare la qualità della vita.

In questo contesto, è fondamentale comprendere alcuni concetti chiave dell’intelligenza artificiale. Ad esempio, il machine learning, una branca dell’IA, si basa sull’idea che le macchine possono imparare dai dati senza essere esplicitamente programmate. Questo processo di apprendimento può essere supervisionato, non supervisionato o per rinforzo, a seconda del tipo di dati e dell’obiettivo da raggiungere.

https://bulletdemoext.bullet-network.com/wp-content/uploads/2024/12/0 concetto più avanzato è quello delle reti neurali profonde (deep learning), che simulano il funzionamento del cervello umano attraverso strati di nodi interconnessi. Queste reti sono in grado di apprendere rappresentazioni complesse dei dati, consentendo di risolvere problemi che erano impensabili solo pochi anni fa. Tuttavia, la complessità di queste reti rende difficile comprendere il processo decisionale, sollevando interrogativi sulla trasparenza e sulla responsabilità.

La sfida, quindi, è quella di sviluppare un’IA che sia non solo potente ed efficiente, ma anche etica, trasparente e comprensibile. https://bulletdemoext.bullet-network.com/wp-content/uploads/2024/12/0’IA che sia al servizio dell’umanità, e non viceversa. Questo richiede un impegno congiunto da parte di ricercatori, sviluppatori, politici e cittadini, per definire un quadro normativo e etico che guidi lo sviluppo e l’utilizzo dell’IA in modo responsabile e sostenibile.

Immagina un futuro in cui l’IA non è più vista come una scatola nera, ma come uno strumento trasparente e comprensibile, in grado di ampliare le nostre capacità cognitive e di aiutarci a risolvere i problemi più complessi del nostro tempo. https://bulletdemoext.bullet-network.com/wp-content/uploads/2024/12/0 futuro in cui l’IA è al servizio dell’umanità, e non viceversa. Questo è il futuro che possiamo costruire, se siamo disposti a impegnarci e a riflettere sulle implicazioni etiche e sociali di questa potente tecnologia.