La riscossa cinese nell’intelligenza artificiale e la sfida al dominio occidentale

Il panorama globale dell’intelligenza artificiale sta vivendo un momento di grandissimo fermento, con la Cina che si

impone sempre più come un attore di primaria importanza, mettendo in discussione la leadership detenuta finora dai paesi

occidentali. Questa ascesa non è casuale, ma il frutto di una pianificazione strategica a lungo termine e di investimenti

massicci. Già nel 2017, con il documento programmatico “Next Generation AI Development Plan”, la Cina ha delineato

chiaramente l’obiettivo di diventare la nazione leader nel campo dell’intelligenza artificiale entro il 2030.

Investimenti Cinesi in IA: La Cina ha messo a segno progressi straordinari per superare i 140 miliardi di dollari entro il

2030, con l’industria dell’IA e settori correlati che potrebbero raggiungere 1,4 trilioni di dollari. [Agenda Digitale, 2025]

Questo ambizioso traguardo è sostenuto da una visione onnicomprensiva che abbraccia diversi aspetti: dalla visione

strategica a livello nazionale alla creazione di un ecosistema favorevole all’innovazione. La governance gioca un ruolo

fondamentale, con normative adattive che cercano un equilibrio tra la spinta all’innovazione e le esigenze di sicurezza e

controllo. Politiche come i “Next Generation Al Governance Principles” del 2019 e il “AI Code of Ethics” del 2021

testimoniano l’attenzione del governo cinese verso un impiego responsabile dell’IA, sebbene le critiche riguardo la

censura e il controllo sui dati rimangano un elemento di dibattito internazionale.

Un fattore cruciale che abilita questa rapida crescita è rappresentato dagli investimenti in infrastrutture. La Cina ha

puntato fortemente sullo sviluppo di reti 5G estese, data center ad alta capacità e robuste strutture di cloud computing.

Queste infrastrutture forniscono la base tecnologica necessaria per addestrare e implementare modelli di intelligenza

artificiale su larga scala, un requisito fondamentale per competere a livello globale.

Inoltre, la disponibilità di dati rappresenta un vantaggio significativo per la Cina. In virtù della sua posizione come

nazione con la più alta concentrazione di utenti online globalmente, la Cina produce una mole considerevole di dati.

Questa abbondanza crea condizioni ideali per lo sviluppo e l’ottimizzazione di modelli innovativi. Le proiezioni indicano

che la massa annua dei dati in Cina passerà dai 24 zettabyte registrati nel 2022 fino a raggiungere i 77 zettabyte entro il

2027. [ISPI, 2025] Questa abbondanza di dati, combinata con la capacità di utilizzarli in processi di machine learning,

conferisce alla Cina un potenziale di sviluppo notevole.

Crescita dei dati: La Cina prevede di triplicare la produzione annuale di dati entro il 2027, confermando la capacità di

alimentare modelli IA avanzati. [Agenda Digitale, 2025]

Il settore energetico, sebbene la domanda di energia per l’IA sia consistente, vede la Cina all’avanguardia nelle energie

rinnovabili, continuando a investire in nuove applicazioni e sfruttando la vastità del proprio territorio. Negli ultimi tempi,

si è assistito a un notevole aumento degli sforzi governativi, mirati a potenziare l’efficienza energetica durante il

processo di addestramento dei modelli. Questa iniziativa fa affidamento su risorse di tipo rinnovabile. [DeepSeek, 2025]

Infine, un elemento distintivo della strategia cinese è l’enfasi sulla formazione del talento. Centinaia di università offrono

specializzazioni in intelligenza artificiale, e una parte significativa dei migliori ricercatori mondiali in questo campo ha

sede in Cina. Istituzioni come la Tsinghua University giocano un ruolo chiave nel promuovere l’innovazione e

l’imprenditorialità.

Questa combinazione di fattori ha portato alla nascita di aziende “campioni nazionali” nel settore dell’IA, selezionate e

supportate dal governo. Inizialmente erano 15 e comprendevano nomi altisonanti come Baidu, Tencent, Alibaba,

SenseTime e iFlutek, ognuna focalizzata su aree specifiche. Negli anni, la lista si è ampliata includendo aziende come

Huawei, Pingan, Hikvision, JD.com, Megvii, Qihoo 360, TAL Education Group e Xiaomi, a riprova dell’importanza

crescente del settore nell’economia cinese.

Le tigri dell’IA cinese e la sfida ai modelli occidentali

Oltre ai “campioni nazionali”, negli ultimi anni è emersa una nuova ondata di startup cinesi nel campo dell’intelligenza

artificiale generativa, soprannominate “tigri dell’IA”. Queste aziende stanno guadagnando rapidamente terreno, sfidando

direttamente i modelli sviluppati dai colossi tecnologici occidentali come OpenAI e Google.

Esempi delle ‘tigri dell’IA’:

- Zhipu AI: Riconosciuta come la più importante startup di IA generativa, con un focus sull’intelligenza artificiale

generale (AGI).

- Baichuan AI: Famosa per i suoi progressi nei modelli linguistici di grandi dimensioni (LLM).

- Moonshot AI: Conosciuta per l’elaborazione di testi lunghi con il chatbot Kimi.

- DeepSeek: Nota per il suo approccio open-source nel concorrere nel mercato dell’IA.

Il successo della startup DeepSeek ha catturato l’attenzione globale, tant’è che ha sorpassato altre app, diventando l’app

gratuita più scaricata negli Stati Uniti. [EconomyUp, 2025] Questa impennata ha portato a un calo significativo dei titoli di

aziende come Nvidia, evidenziando la potenzialità dirompente delle aziende di IA cinesi nel mercato tecnologico.

[DeepSeek, 2025]

DeepSeek si è fatta notare non solo per le sue prestazioni, ma anche per il suo approccio open-source, che la differenzia

dai modelli tradizionali, permettendole di essere accessibile e adattabile. [ISPI, 2025] Ciò rappresenta una sfida significativa

per le aziende occidentali che hanno tradizionalmente adottato modelli di business chiusi. L’impresa ha evidenziato la

possibilità di sviluppare modelli estremamente efficaci anche in presenza di risorse contenute. [Wired, 2025]

Un’azienda che sta facendo passi da gigante e che merita una menzione particolare è Alibaba. Il colosso dell’e-commerce

ha recentemente presentato la famiglia di modelli Qwen3, che l’azienda dichiara essere in grado di competere con le

migliori soluzioni di Google e OpenAI. La disponibilità di gran parte di questi modelli con licenza open source su

piattaforme come Hugging Face e GitHub testimonia la volontà di Alibaba di contribuire all’ecosistema open.

I modelli Qwen3 presentano caratteristiche tecniche avanzate, inclusa la capacità di “ragionare” su problemi complessi e

di supportare un elevato numero di lingue (ben 119). L’addestramento su un dataset vastissimo di quasi 36 trilioni di token

ha contribuito a migliorare significativamente le loro capacità rispetto alle versioni precedenti. [Agenda Digitale, 2025]

La competizione USA-Cina e le sue implicazioni geopolitiche

La crescente competizione tra Stati Uniti e Cina nel campo dell’intelligenza artificiale va ben oltre la sfera tecnologica ed

economica, assumendo connotazioni geopolitiche di primaria importanza. Questa rivalità è ormai definita da alcuni come

una vera e propria “guerra fredda” dell’intelligenza artificiale, con ripercussioni significative sull’equilibrio di potere

globale.

Gli Stati Uniti, consapevoli del rischio di perdere il loro primato tecnologico, stanno adottando una strategia basata sia sul

mantenimento di un vantaggio attraverso l’innovazione accelerata, sia su misure difensive volte a ostacolare lo sviluppo

cinese. Controlli sulle esportazioni, restrizioni agli investimenti e sanzioni mirate, come quelle imposte a Huawei, sono

strumenti utilizzati da Washington per limitare l’accesso della Cina a tecnologie critiche, in particolare ai semiconduttori

avanzati prodotti da aziende come Nvidia e AMD.

Strategia USA: Gli Stati Uniti mirano a congelare la produzione di chip in Cina, limitando così la capacità di

quest’ultima di addestrare modelli di intelligenza artificiale sempre più avanzati. [Online Sim, 2025]

Questo approccio, sebbene mitigato da recenti sviluppi, ha portato a una reazione energica da parte della Cina, la quale sta

spingendo per l’autosufficienza tecnologica e per migliorare l’innovazione attraverso investimenti significativi. Il “Big

Fund”, ad esempio, è stato lanciato con un investimento di 47,5 miliardi di dollari per potenziare il settore dei

semiconduttori, (DeepSeek, 2025]

La competizione si estende anche alla costruzione delle infrastrutture necessarie per supportare l’IA, in particolare i data

center ad alta intensità energetica. Sia gli Stati Uniti che la Cina stanno cercando di espandere la propria presenza in

questo settore, con investimenti in regioni strategiche come il Medio Oriente e l’Asia. Questa “corsa ai data center”

sottolinea ulteriormente la dimensione globale della rivalità nell’IA.

Le implicazioni geopolitiche di questa competizione sono molteplici. Da un lato, si assiste a un potenziale

disaccoppiamento degli ecosistemi globali dell’IA in due sfere di influenza distinte, una guidata dagli Stati Uniti e l’altra

dalla Cina. Questo potrebbe portare a una riduzione dell’interoperabilità e dello scambio di conoscenze a livello globale.

Dall’altro lato, la competizione potrebbe stimolare un’accelerazione nell’innovazione, con ciascuna parte impegnata a

superare l’altra nello sviluppo di nuove architetture e capacità di IA.

Interazioni Geopolitiche: La rivalità nell’IA ha anche risvolti militari, con entrambi i paesi che vedono l’intelligenza.

artificiale come un un elemento fondamentale per la modernizzazione delle proprie forze armate.

La Cina, in particolare, sta promuovendo una strategia di “fusione militare-civile” per garantire che le innovazioni

tecnologiche, inclusa l’IA, contribuiscano sia allo sviluppo economico che alla sicurezza nazionale.

Applicazioni pratiche e il futuro dell’IA cinese

I progressi compiuti dalla Cina nell’intelligenza artificiale si traducono in una vasta gamma di applicazioni pratiche che

stanno rivoluzionando diversi settori industriali e la vita quotidiana dei cittadini. L’IA non è più un concetto astratto, ma

una tecnologia concretamente impiegata per migliorare l’efficienza, l’innovazione e la competitività.

| Settore |

Applicazione Esempio |

| Produzione Industriale |

Piattaforma COSMOPlat di Haier, sistemi di ispezione visiva di GAC Honda. |

| Automotive e Trasporto Autonomo |

Apollo Go di Baidu per ride-hailing autonomi. |

| Vendita al Dettaglio |

Modello ‘New Retail’ da JD. com e ANTA. |

| Sanità |

Piattaforma di IA di GE Healthcare e ospedale virtuale della Tsinghua University. |

| Servizi Pubblici |

Progetto City Brain di Alibaba a Hangzhou. |

Queste applicazioni pratiche dimostrano che la Cina sta non solo investendo nella ricerca e nello sviluppo dell’intelligenza

artificiale, ma sta anche implementando attivamente la tecnologia in vari settori, ottenendo risultati tangibili. L’ampia

adozione dell’IA generativa, come evidenziato dai sondaggi che mostrano un tasso di utilizzo significativamente più alto

in Cina rispetto ad altri paesi, sottolinea ulteriormente questa tendenza.

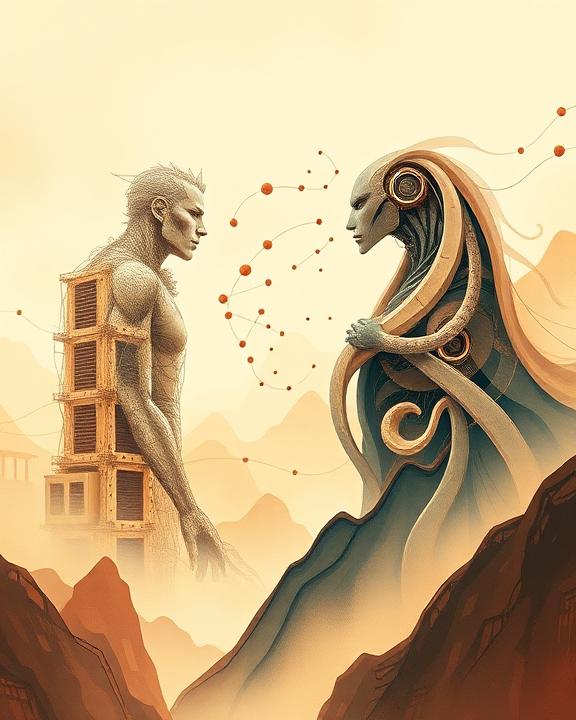

Riflessioni sull’evoluzione dell’intelligenza artificiale e il ruolo della Cina

L’intensa attività nel campo dell’intelligenza artificiale in Cina, caratterizzata da investimenti strategici, una rapida

innovazione e un’ampia adozione in diversi settori, ci invita a una riflessione più profonda sul futuro di questa tecnologia

e sul suo impatto a livello globale. Il “momento Sputnik” dell’IA, evocato in seguito all’emergere di modelli cinesi

competitivi, ci ricorda che il progresso tecnologico può avvenire in luoghi inaspettati e con velocità sorprendenti.

Una nozione fondamentale da tenere a mente è quella del machine learning, la base su cui si fonda gran parte

dell’intelligenza artificiale moderna, in particolare quella generativa. Il machine learning è un processo attraverso il quale i

sistemi di intelligenza artificiale apprendono dai dati senza essere esplicitamente programmati, [ISPI, 2025] Maggiore è la

quantità di dati di alta qualità disponibili per l’addestramento, migliori saranno le prestazioni del modello. In questo senso,

l’enorme volume di dati generati in Cina grazie alla sua vasta popolazione e all’elevato grado di digitalizzazione

rappresenta un vantaggio competitivo tangibile.

Spingendoci su un concetto più avanzato, possiamo considerare l’importanza delle architetture dei modelli e delle

strategie di ottimizzazione. L’introduzione da parte di Alibaba di modelli “ibridi” in Qwen3, capaci di bilanciare la

velocità di risposta con la capacità di “ragionare” su problemi complessi, e l’adozione dell’architettura “mixture of

experts” (MoE) per una maggiore efficienza computazionale, dimostrano come la ricerca e lo sviluppo stiano evolvendo

rapidamente, [DeepSeek, 2025)

Questa competizione e l’emergere di approcci diversi al di fuori del tradizionale epicentro occidentale ci spingono a

interrogarci sul futuro dell’innovazione e sulla possibilità di una vera e propria diversificazione nel campo dell’IA. Se da

un lato il rischio di una frammentazione degli ecosistemi e di una ridotta interoperabilità è reale, dall’altro la competizione

può stimolare un’accelerazione nel trovare soluzioni innovative e nel superare gli ostacoli tecnici.

La questione del controllo e della regolamentazione dell’intelligenza artificiale rimane centrale. Mentre la Cina

implementa normative per un uso responsabile dell’IA, le preoccupazioni riguardo la censura e la sorveglianza rimangono.

Questa dicotomia pone sfide etiche e sociali significative per il futuro globale dell’IA. La speranza è che, nonostante la

forte competizione geopolitica, si possano trovare spazi di collaborazione internazionale, specialmente su temi che

riguardano il bene pubblico e la sicurezza globale.

Vivere in questi “tempi interessanti”, per citare una frase che sembra attagliarsi perfettamente a questa fase di rapida

evoluzione dell’IA, ci impone di rimanere vigili, informati e pronti ad adattarci a un futuro che, grazie all’intelligenza

artificiale e alla sua corsa globale, si preannuncia sempre più dinamico e imprevedibile.